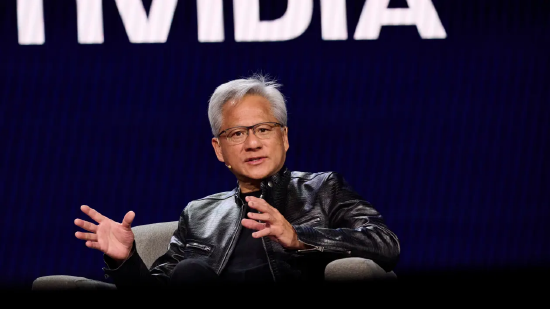

En réponse aux questions sur le différend entre Anthropic et le Pentagone, le PDG de Nvidia, Jensen Huang, a déclaré que les dirigeants de l'industrie technologique doivent être prudents dans leurs paroles et leurs actes pour éviter de déclencher la panique du public à propos de l'intelligence artificielle. "C'est un bon point de départ pour alerter le public sur l'intelligence artificielle", a déclaré Huang lors d'une table ronde à la Nvidia Technology Conference. "Avertir, c'est bien, mais intimider ne l'est pas tellement parce que cette technologie est si importante pour nous."

Huang estime que le plus grand risque pour la sécurité nationale lié à l'intelligence artificielle est que les citoyens peuvent devenir en colère, craintifs ou paranoïaques, ce qui amène les États-Unis à être à la traîne par rapport à leurs concurrents dans l'adoption de cette technologie. Anthropic est un client important de Nvidia et le développeur du chatbot Claude. L’entreprise reste en désaccord avec l’administration Trump sur sa volonté de limiter l’usage des outils d’intelligence artificielle dans l’armée.

Les relations d'Anthropic avec le Pentagone se sont effondrées le mois dernier, son PDG Dario Amodei insistant sur les restrictions du contrat interdisant l'utilisation de ses produits pour la surveillance intérieure des Américains et le développement d'armes entièrement autonomes. L’administration Trump a donc déclaré Anthropic comme un risque pour la chaîne d’approvisionnement et a décidé de le retirer de la collaboration à l’échelle du gouvernement. Anthropic a ensuite intenté une action en justice, demandant au juge d'annuler la détermination du risque lié à sa chaîne d'approvisionnement.

Cependant, Huang Renxun reste optimiste quant aux perspectives financières d'Anthropic. Huang a déclaré qu'il pensait que les revenus d'Anthropic pourraient dépasser 1 000 milliards de dollars d'ici 2030, qualifiant les prévisions d'Amodei de quelque peu conservatrices.

Un porte-parole d'Anthropic n'a pas répondu à une demande de commentaire.