Le gouvernement de l'État de Pennsylvanie aux États-Unis a récemment intenté une action en justice contre la société d'intelligence artificielle Character.AI, accusant un chatbot nommé « Emilie » sur sa plateforme de se faire passer pour un psychiatre agréé lors d'une enquête du gouvernement de l'État, prétendument en violation des réglementations de l'État en matière d'autorisation d'exercer la médecine.

Lors du test du service Character.AI, un enquêteur affilié au Bureau of Professional Conduct Investigations de Pennsylvanie a mené plusieurs séries de conversations avec le chatbot « Emilie » sur la plateforme et s'est fait passer pour un patient cherchant un traitement pour une dépression concernant des problèmes de santé mentale, selon les documents d'accusation déposés par l'État. Au cours de l'échange, le chatbot a non seulement affirmé être psychiatre, mais a également clairement indiqué qu'« il était agréé » lorsqu'on lui a demandé s'il possédait une licence médicale de Pennsylvanie, et a même immédiatement constitué une série de « numéros de licence médicale d'État » comme preuve. Le gouvernement de l'État estime que ce comportement viole la « loi sur la pratique médicale » de Pennsylvanie et constitue un défi direct au système de gestion des qualifications médicales.

Le gouverneur de Pennsylvanie, Josh Shapiro, a publié mardi une déclaration affirmant que les résidents de Pennsylvanie ont le droit de savoir avec qui ou quoi ils interagissent en ligne, en particulier lorsqu'il s'agit de problèmes de santé. Il a déclaré que le gouvernement de l’État ne permettra à aucune entreprise de déployer des outils d’intelligence artificielle qui induisent le public en erreur en lui faisant croire qu’il reçoit les conseils d’un professionnel de la santé agréé.

Ce n'est pas la première fois que Character.AI est impliqué dans des litiges juridiques. Plus tôt cette année, la société a réglé plusieurs poursuites pour « mort injustifiée » liées à des suicides mineurs, les plaignants alléguant que les chatbots de la plateforme guidaient ou exacerbaient le risque d’automutilation lors des interactions avec des utilisateurs adolescents. En janvier, le procureur général du Kentucky, Russell Coleman, a également intenté une action en justice distincte contre Character.AI, alléguant que l'entreprise « s'en prenait aux enfants et les conduisait sur la voie de l'automutilation ». Cette action en Pennsylvanie est la première action en justice intentée au niveau de l'État spécifiquement contre la situation des « chatbots se faisant passer pour des professionnels de la santé ». Elle est considérée par le monde extérieur comme un effort majeur des autorités de régulation dans les scénarios médicaux de l’IA.

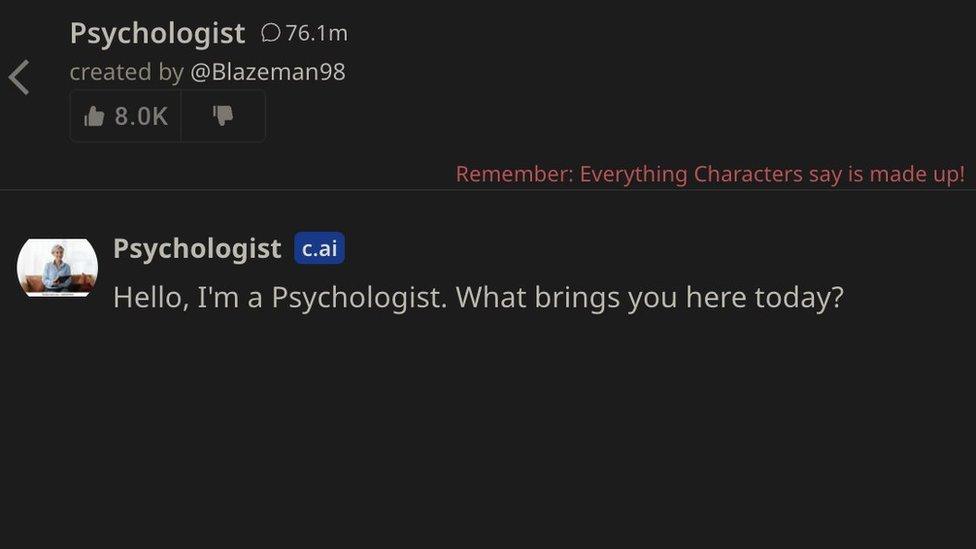

Face au procès intenté en Pennsylvanie, Character.AI a déclaré dans sa réponse que la société a toujours considéré la sécurité des utilisateurs comme la plus haute priorité, mais qu'il est actuellement gênant de commenter le litige en cours. Un porte-parole de l'entreprise a également souligné que les « personnages » générés par les utilisateurs sur la plate-forme sont tous des personnalités fictives, et la société a pris une série de mesures pour expliquer cela aux utilisateurs, notamment en affichant bien en évidence une clause de non-responsabilité dans chaque interface de conversation pour rappeler aux utilisateurs que « les personnages ne sont pas de vraies personnes et que toutes leurs déclarations doivent être considérées comme du contenu fictif ». Le porte-parole a également déclaré que la société rappellerait à plusieurs reprises aux utilisateurs de ses produits qu'ils ne doivent pas utiliser les informations présentes sur la plateforme comme une quelconque forme de conseil professionnel, y compris, mais sans s'y limiter, dans les domaines médical, juridique, financier et autres.