GPT Image2 rafraîchit l'ensemble du réseau, mais pourquoi l'effet est-il si bon ? Le responsable de la recherche, Chen Boyuan, a révélé : L'architecture sous-jacente a été entièrement reconstruite. Mais il a refusé de répondre s'il utilisait un modèle de diffusion ou une technologie autorégressive, et l'a simplement décrit mystérieusement comme un « modèle universel » ou un « GPT dans le domaine de l'image ».

Un tweet de Chen Boyuan a également révélé qu'il n'avait fallu que quatre mois pour obtenir une amélioration aussi importante par rapport à l'image GPT 1.5 fin décembre de l'année dernière.

Pour une réalisation aussi révolutionnaire, l’équipe de base ne compte que 13 personnes.

Gabriel Goh, le chef de toute l'équipe, a posté une photo de famille des membres de l'équipe AI.

Certains internautes dans la zone de commentaires ont déploré : Pourquoi sont-ils tous asiatiques ?

Chen Boyuan : De l'ignorance de Python à celui de responsable de la recherche

Quelle est exactement l’architecture de GPT Image 2 ?

OpenAI ne sera peut-être pas annoncé avant longtemps, mais certaines traces peuvent être observées dans l'expérience académique des membres de l'équipe principale.

Chen Boyuan est le responsable de la recherche de l'équipe. Lui et un autre membre Kiwhan Song avaient le même mentor Vincent Sitzmann lorsqu'ils étudiaient pour leur doctorat. au MIT.

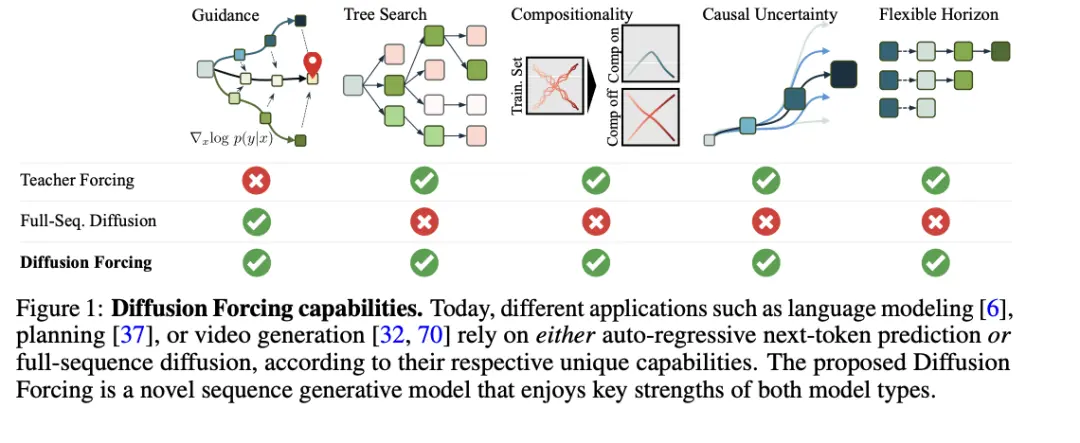

Son chef-d'œuvre Diffusion Forcing: Next-token Prediction Meets Full-Sequence Diffusion au cours de son doctorat a été sélectionné pour NeurIPS 2024.

Cette étude propose le Diffusion Forcing, un nouveau paradigme de formation à la génération de séquences qui combine la diffusion indépendante du niveau de bruit jeton par jeton avec la prédiction causale du prochain jeton, intégrant la génération de longueur variable du modèle autorégressif et les avantages de guidage à longue portée du modèle de diffusion de séquence complète.

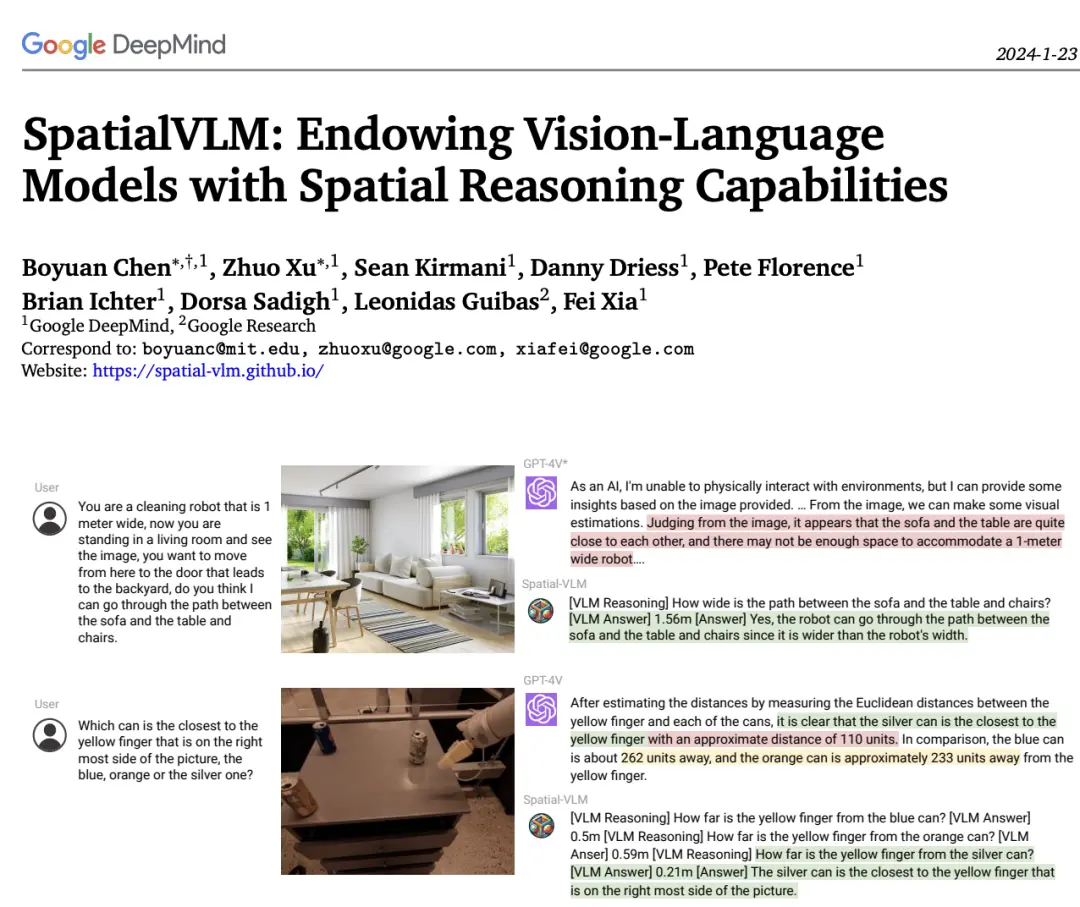

Lors de son stage chez Google, il a également publié SpatialVLM en tant que co-auteur.

En construisant automatiquement un ensemble de données VQA de raisonnement spatial 3D à l'échelle Internet (10 millions d'images, 2 milliards de paires QA), le modèle de langage visuel est doté de capacités de raisonnement spatial quantitatif/qualitatif, et des valeurs précises telles que la distance métrique, la taille et l'orientation peuvent être générées à partir d'une seule image 2D.

Cette recherche applique le raisonnement spatial en chaîne de pensée au domaine de l’intelligence incarnée.

Au cours de son stage chez Google, la technologie de mise au point pédagogique qu'il a développée a ensuite été adoptée par Gemini 2.0.

Lorsqu'il a participé à un camp d'été de recherche scientifique au lycée, il n'a pas compris la syntaxe de base de Python. Xia Fei, chercheur principal chez Google DeepMind qu'il a rencontré à cette époque, lui a fait découvrir le monde de l'IA.

Xia Fei l'a invité à deux reprises à effectuer des stages de haute qualité chez DeepMind. Ces expériences ont permis à Chen Boyuan d'accumuler une expérience en ingénierie dans la formation de modèles à grande échelle et lui ont également fourni une perspective précieuse pour comprendre les exigences en matière de données des systèmes multimodaux.

Après avoir obtenu un doctorat, Chen Boyuan a rejoint OpenAI en juin 2025 et est rapidement devenu l'un des cinq membres principaux de la génération d'images GPT. Il était responsable de toute la formation du modèle de génération d'images GPT et était également membre de l'équipe de génération vidéo Sora.

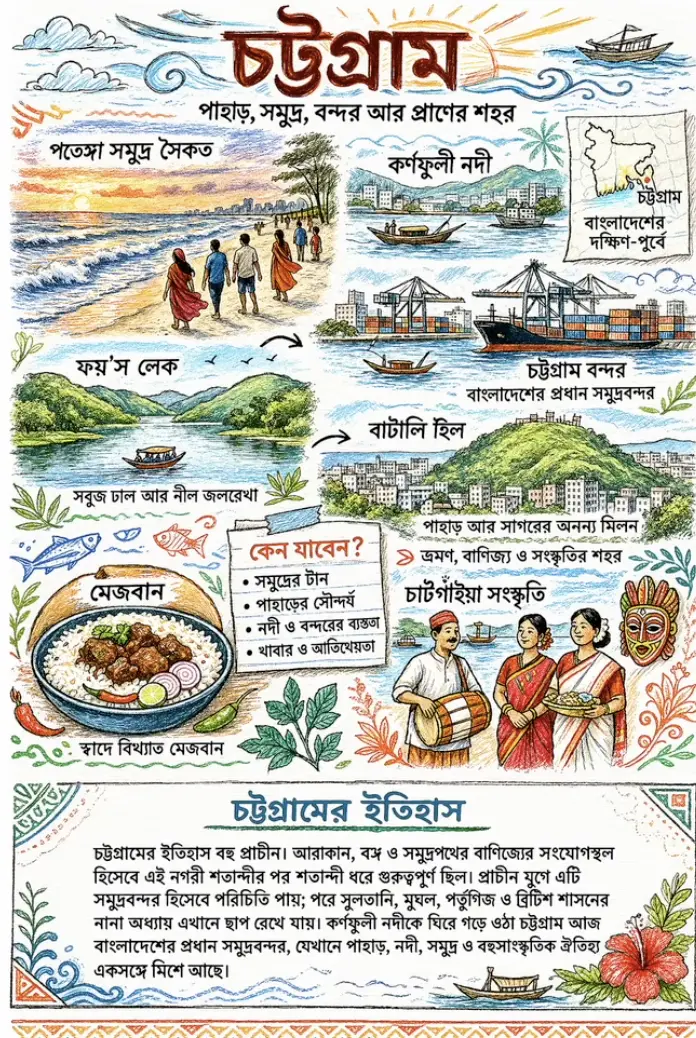

Lors de la manifestation, il a réalisé une affiche pour sa ville natale de Wuxi. Ensuite, j'ai réalisé des affiches coréennes pour mes coéquipiers de Séoul et des affiches bengali pour mes coéquipiers du Bangladesh. Le rendu du texte dans chacun est précis.

Jianfeng Wang, Université des sciences et technologies de Chine : Laissez Shengtu AI comprendre la connaissance du monde

Jianfeng Wang, titulaire d'un doctorat. de l'Université des sciences et technologies de Chine, est responsable d'une autre capacité étonnante au sein de l'équipe GPT Image 2 : suivre des instructions et comprendre le monde.

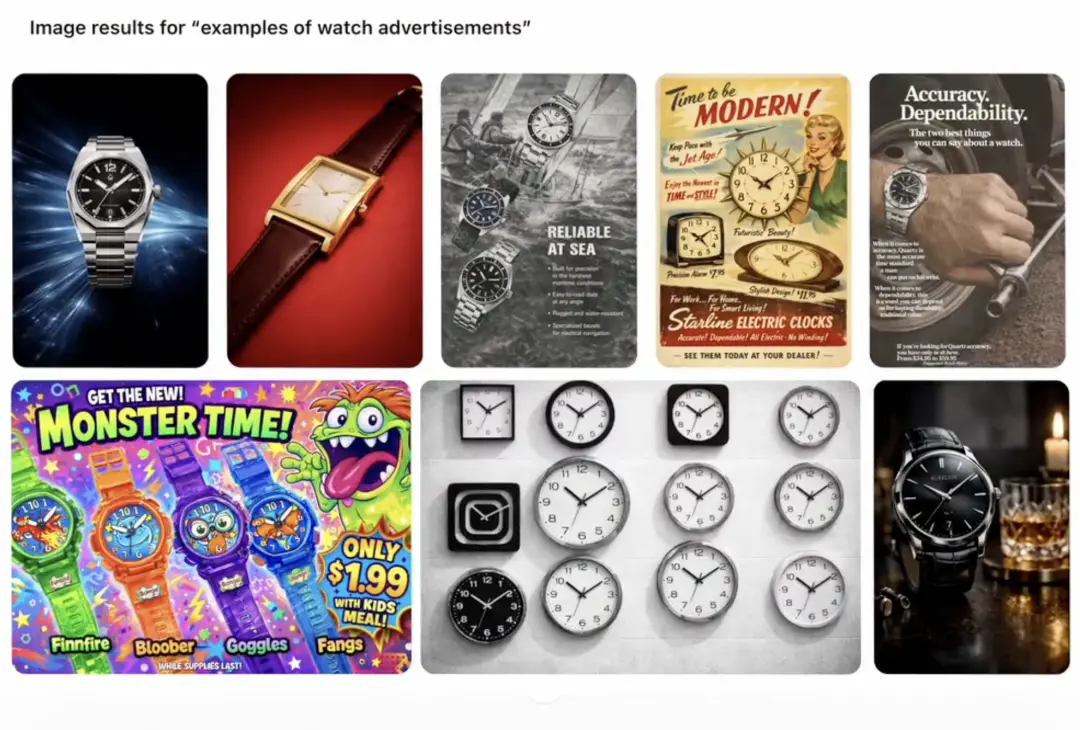

L'horloge éternelle dessinée par l'ancien modèle indique toujours 10h10, ce qui est dérivé d'images publicitaires d'horloge sur Internet, dont presque toutes sont 10h10.

En effet, les fabricants de montres ont mené des expériences avec des psychologues et pensent que cela contribuera à stimuler la volonté des consommateurs d'acheter des montres.

Il a demandé au nouveau modèle de dessiner 2h25, 3h30, 9h10 et 7h45, le tout avec précision.

Ceci est juste un apéritif.

Disposition spatiale plus complexe avec une pomme au centre, une tasse à droite, un livre en haut, une caméra à gauche et un ballon de basket en bas. Les modèles sont tous exécutés avec précision.

Avant de rejoindre OpenAI, il a travaillé chez Microsoft pendant près de 9 ans. Chez Microsoft, j'ai collaboré avec l'équipe OpenAI sur DALLE-3.

Il a publié de nombreux articles universitaires dans le domaine de la vision par ordinateur, et ses recherches peuvent couvrir la classification d'images, la détection de cibles, la segmentation sémantique et l'apprentissage des représentations visuelles.

La capacité à comprendre la connaissance du monde a été considérablement améliorée et le contenu sémantique et la structure fonctionnelle des objets ont été correctement compris.

JianFeng Wang a déclaré à la fin de la vidéo de démonstration : GPT Image 2 élimine l'écart entre votre intention et la sortie du modèle.

Faites vraiment ce que vous voulez et le modèle vous donnera ce que vous voulez.

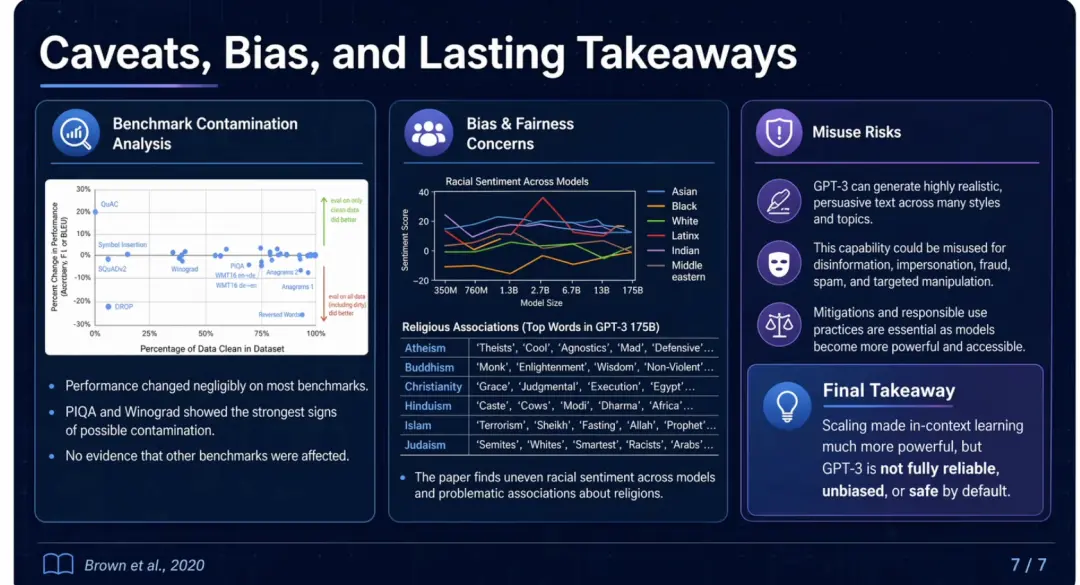

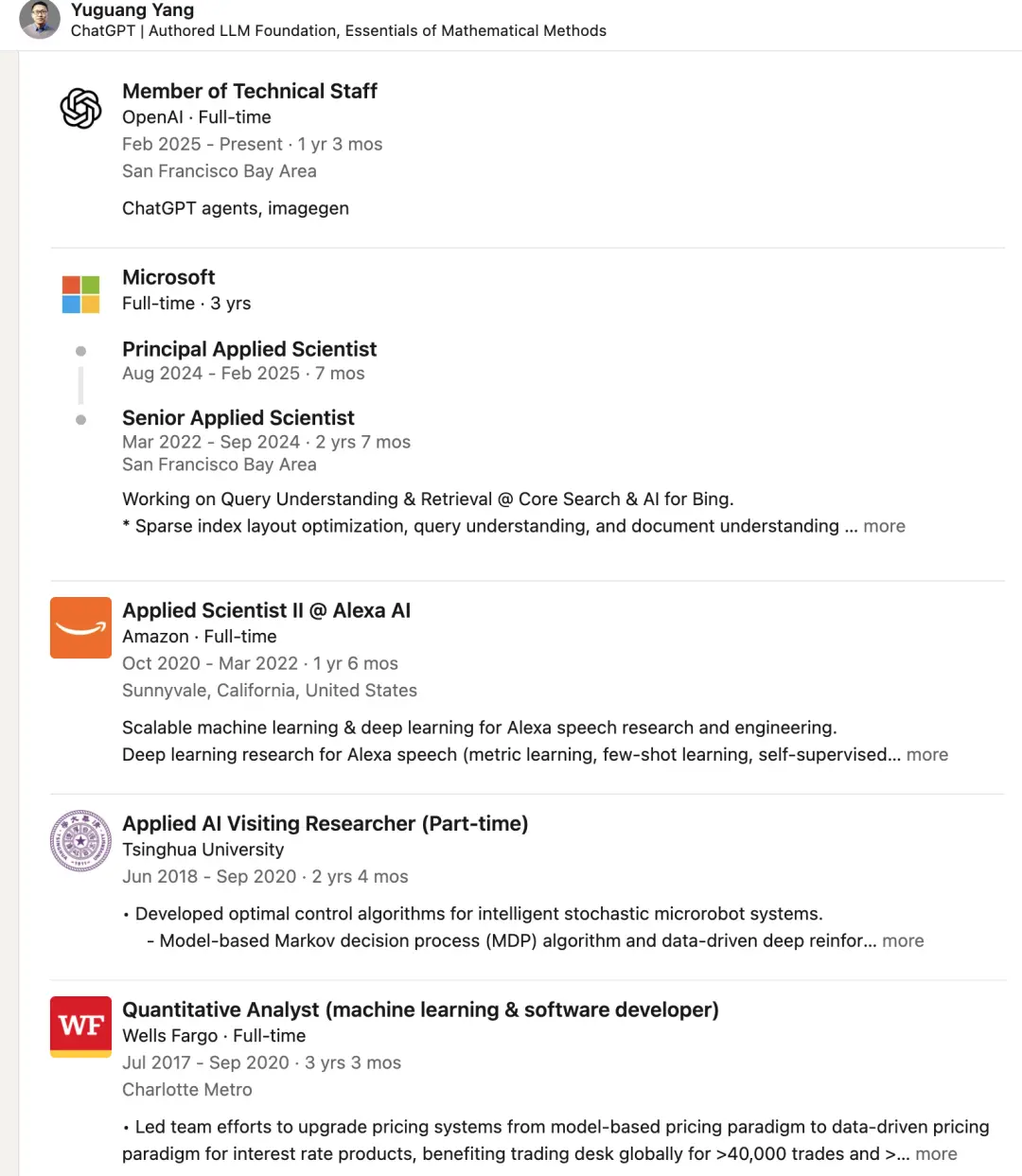

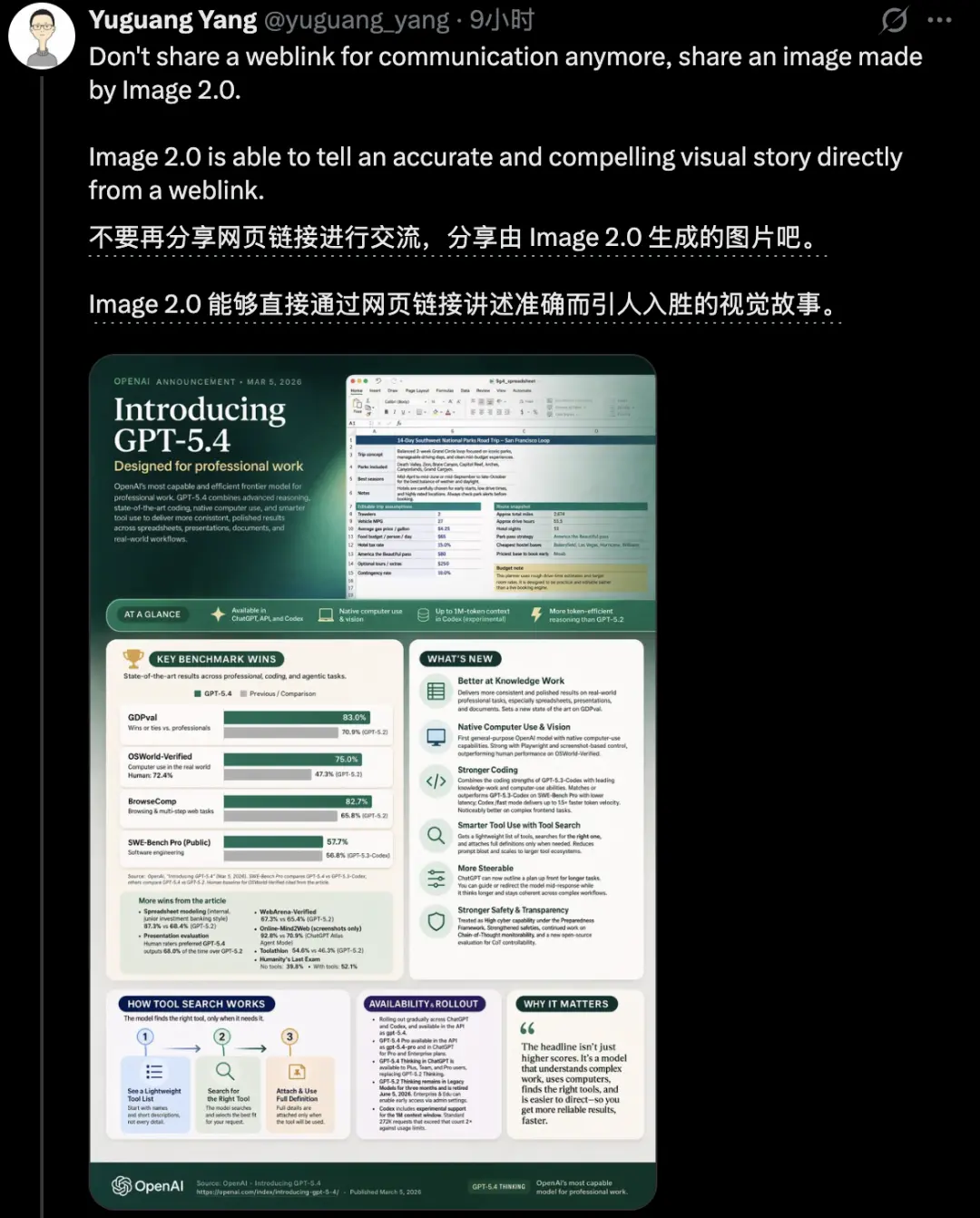

Yuguang Yang : génération de graphiques d'informations complexes de haute précision

Yuguang Yang a démontré la génération d'infographies et de PPT lors de l'événement de lancement de GPT Image 2.

Faites glisser l'intégralité du document GPT-3 de 75 pages dans ChatGPT et générez automatiquement 7 diapositives.

Son expérience peut être considérée comme la plus riche parmi les membres de l'équipe. Chaque emploi qu'il accepte est transfrontalier, mais ils sont tous axés sur l'apprentissage automatique.

Il a étudié l'ingénierie au Collège Zhu Kezhen de l'Université du Zhejiang pour son diplôme de premier cycle, et a étudié la physique chimique computationnelle et l'apprentissage automatique pendant son doctorat. à l'Université Johns Hopkins.

Son premier emploi à temps plein était celui d'analyste quantitatif. Tout en travaillant comme chercheur invité à l’Université Tsinghua, Yaniu a travaillé sur des algorithmes d’apprentissage par renforcement et de contrôle pour les nanorobots.

Plus tard, il a effectué des recherches vocales sur Alexa sur Amazon.

J'ai également travaillé sur la compréhension et la récupération des requêtes de recherche Bing, ainsi que sur la compréhension des documents chez Microsoft.

Après avoir rejoint OpenAI début 2025, en plus de la génération d'images, il a également participé au projet d'agent ChatGPT.

Il a présenté la capacité de génération d'infographies de GPT Image 2 sur son compte personnel, ce qui peut faire gagner beaucoup de temps aux chercheurs scientifiques.

Je rappelle également à plusieurs reprises à tout le monde que lorsque vous créez des infographies, n'oubliez pas de choisir le mode réflexion.

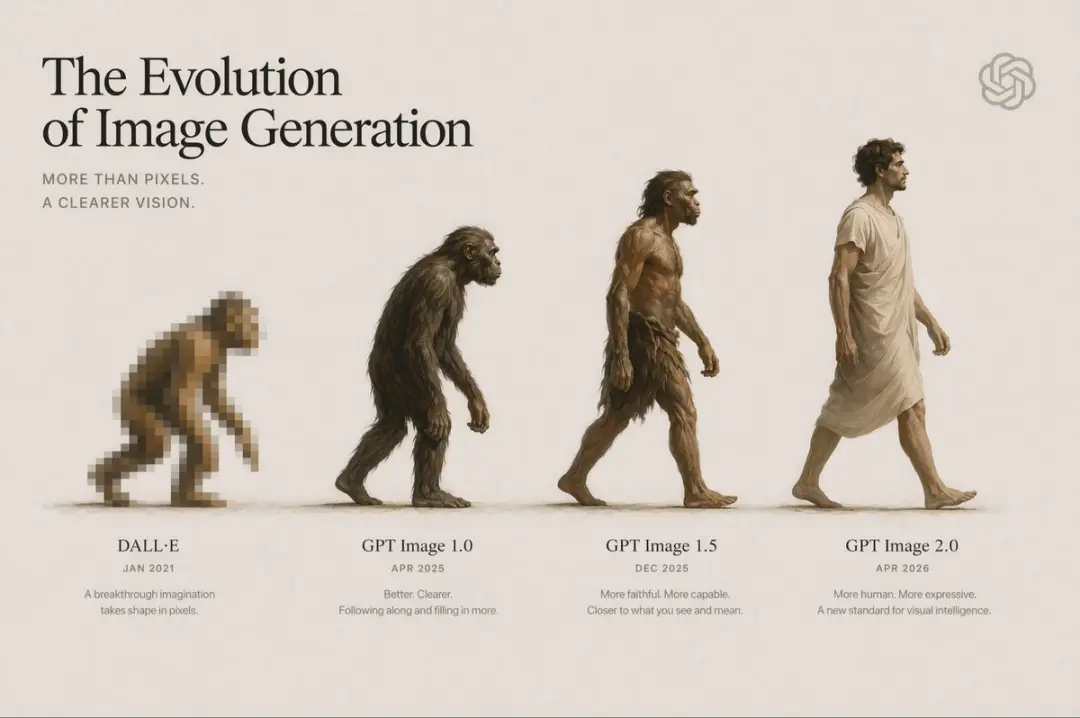

Du DALL-E au GPT Image 2.0

Grâce à l'auto-présentation du membre de l'équipe Kenji Hata, nous avons appris que GPT Image 1.0 est la partie génération d'images de GPT-4o.

Il y a une personne qui a participé à toute la série de recherches multimodales OpenAI depuis DALL-E.

Il s'agit de Gabriel Goh, le leader de l'équipe GPT Image 2.0.

Depuis qu'il a rejoint OpenAI en 2019, ses premières recherches ont été plus théoriques, axées sur l'interprétabilité, l'optimisation convexe, etc.

A partir du DALL-E, je me suis progressivement tourné vers la génération d'images.

En voyant le résumé des recherches d'un autre membre de l'équipe, Weixin Liang, les connaissances techniques de GPT Image 2 ont été révélées.

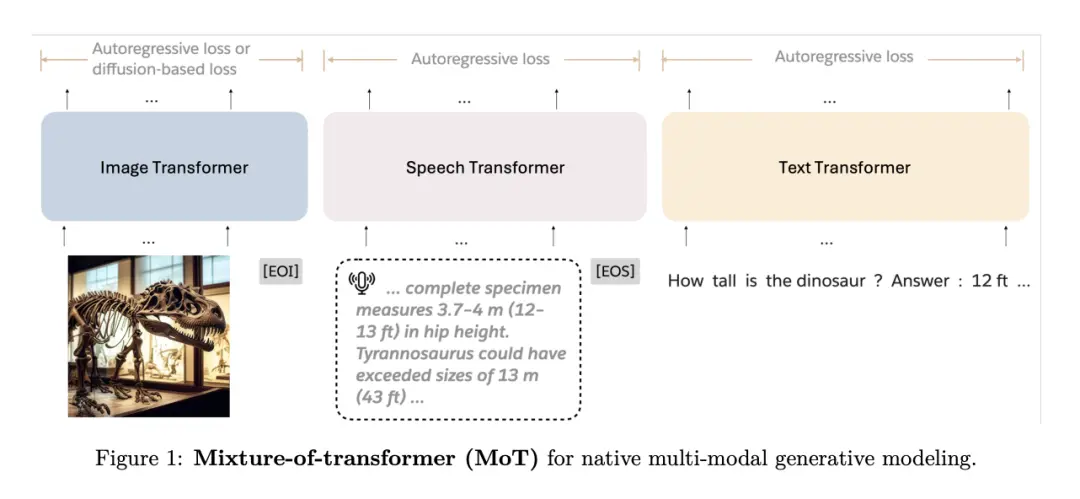

Son travail représentatif au cours de son stage chez Meta, Mixture-of-Transformers, a introduit le découplage modal MoE et l'attention découplée, réduisant considérablement le coût de calcul de la pré-formation des modèles multimodaux.

Il a obtenu un doctorat de Stanford et un diplôme de premier cycle du Zhu Kezhen College de l'Université du Zhejiang, mais il était plusieurs années plus tard que Yuguang Yang.

Weixin Liang, comme Chen Boyuan, ont tous deux 25 ans de doctorat. et a rejoint OpenAI juste après l'obtention de son diplôme et est rapidement devenu un membre essentiel de l'équipe.

Les autres membres de l'équipe GPT Image 2.0 incluent :

Ayaan Haque, qui travaillait auparavant chez Luma AI, a participé à la formation de Dream Machine, le modèle de base de génération vidéo de Luma.

Bing Liang travaille chez Google depuis plus de cinq ans, participant à Imagen3, Veo et Gemini Multimodal. En 2025, il s'est tourné vers OpenAI pour effectuer des recherches sur la génération d'images.

Mengchao Zhong est un ancien élève de l'Université Jiao Tong de Shanghai, titulaire d'un baccalauréat et d'une maîtrise de la Texas A&M University. Il a travaillé comme ingénieur logiciel chez Pinterest et Airtable, et est responsable de l'ingénierie de produits multimodaux chez OpenAI.

Dibya Bhattacharjee, Université de Yale, médaille de bronze IPhO en 2015, score le plus élevé au monde en mathématiques et biologie de niveau A CIE.

Kiwhan Song a été le dernier à nous rejoindre en octobre 2025. En plus de faire des recherches, il est également le maître des mots rapides de l'équipe. La plupart des photos officielles de la manifestation que vous voyez sont de lui.

…

Depuis le premier DALL-E jusqu'à l'image GPT 2.0 d'aujourd'hui, cette équipe a résolu les problèmes les uns après les autres. Vous pouvez dessiner clairement, dessiner magnifiquement et dessiner avec précision.

Bien que le flux de talents d'OpenAI ait été important ces dernières années, OpenAI reste une entreprise qui peut continuer à attirer des talents aux personnalités diverses, ne limite pas les majors, accueille la recherche transfrontalière et croit en la recherche émergente ascendante.

Partant d'une petite équipe, après des percées, l'entreprise consacre plus de ressources jusqu'à changer le monde.

Encore une chose

Il était une fois la génération d’images GPT-4o qui a pris d’assaut le monde en imitant les avatars de style Ghibli.

Désormais, les membres de l'équipe de GPT Image 2.0 ont tous changé leurs avatars pour ce style de cou étrange.

Alors, quels sont les indices de ce style de peinture ? Les membres de l'équipe ont également été annoncés

Use my photo only for identity. Redraw me as a very simple surreal Japanese sticker-style caricature: long thin neck, small deadpan face, minimal black outline, flat light coloring, almost no shading, very few facial details, simplified hair shape, lots of white space, plain white background, slightly awkward and funny. Ultratall 1:3 image.

Liens de référence :

[1]https://x.com/gabeeegoooh/status/2046674385407512687?s=20

[2]https://venturebeat.com/technology/openais-chatgpt-images-2-0-is-here-and-it-does-multilingual-text-full-infographics-slides-maps-even-manga-seemingly-flawlessly