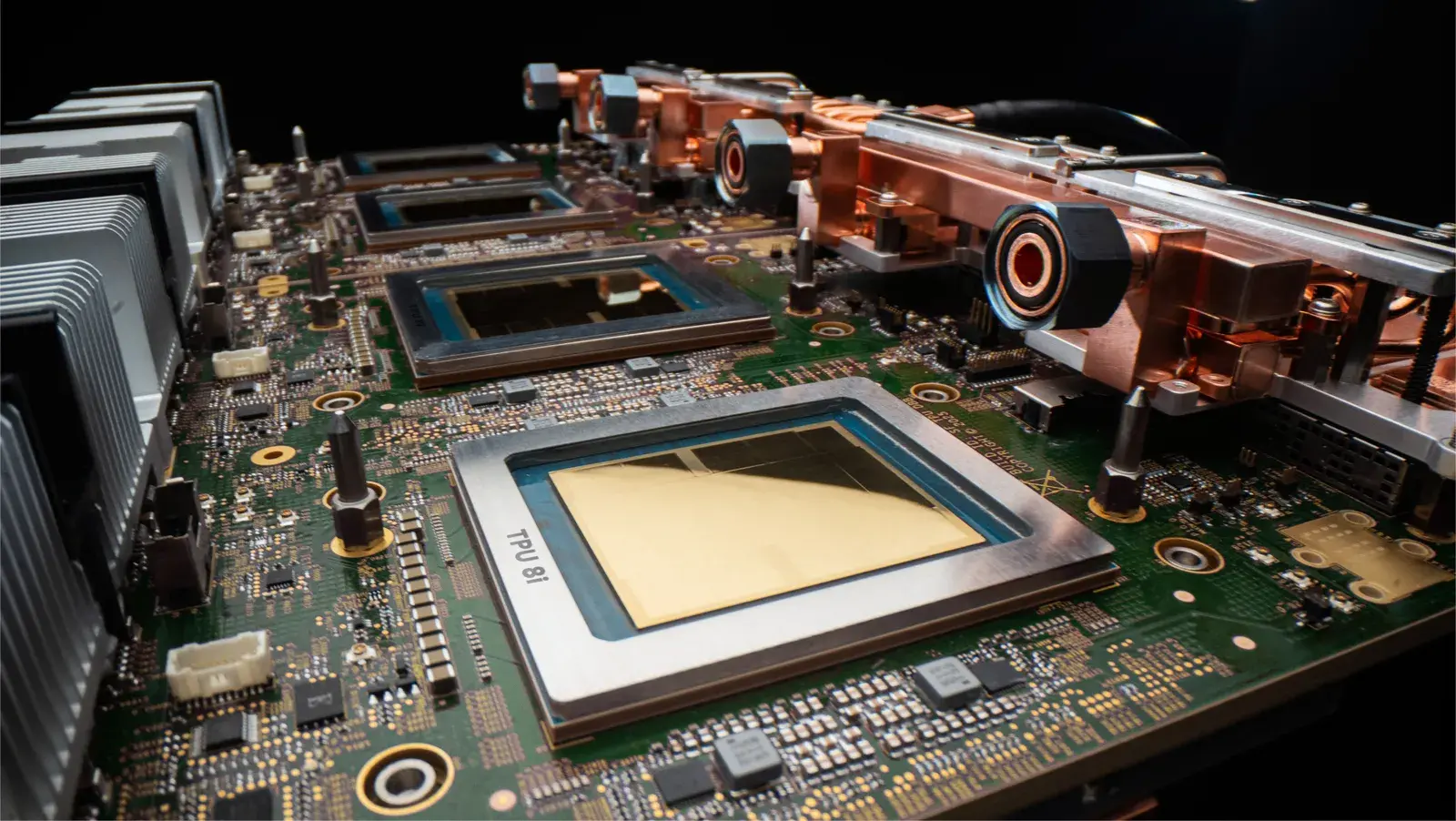

Selon les informations du 23 avril, mercredi, heure américaine, Google a officiellement annoncé que son unité de traitement tensoriel (TPU) de huitième génération avait inauguré un ajustement stratégique majeur : pour la première fois, elle séparerait les tâches de « formation » et d'« inférence » du modèle d'IA et les confierait à deux puces propriétaires indépendantes. Ces deux processeurs de nouvelle génération devraient arriver sur le marché plus tard cette année.

Cette décision marque un nouveau cycle de concurrence entre Google et Nvidia dans le domaine du matériel d'IA.

"Pourquoi s'orienter vers une spécialisation de la puissance de calcul ?" Amin Vahdat, vice-président senior et directeur de la technologie de l'IA et de l'infrastructure de Google, a déclaré dans un article de blog officiel. "Avec l'essor des agents IA, nous pensons que la fourniture de puces spécialement optimisées pour les besoins de formation et de raisonnement profitera à l'ensemble de l'écosystème technologique."

Actuellement, la vitesse d’inférence de l’IA devient le principal champ de bataille des grands fabricants. En mars, Nvidia a annoncé une nouvelle puce à venir qui permettrait aux modèles de répondre rapidement aux questions des utilisateurs, en grande partie grâce à la technologie acquise lors de l'acquisition de 20 milliards de dollars de la startup de puces Groq. Dans ce contexte, bien que Google reste le principal client de NVIDIA, il construit des solutions alternatives de puissance de calcul en fournissant des TPU aux sociétés de services cloud.

En fait, il est devenu un consensus dans l’industrie que les géants de la technologie construisent personnellement des cœurs et recherchent une puissance de calcul indépendante. Grâce à une personnalisation approfondie de l'architecture sous-jacente, les entreprises peuvent maximiser l'efficacité opérationnelle de scénarios d'application spécifiques. Du moteur neuronal qu'Apple a intégré aux iPhones au fil des ans, à la puce IA de deuxième génération de Microsoft itérée en janvier de cette année, en passant par la récente révélation de Meta selon laquelle elle travaille avec Broadcom pour développer une variété de processeurs IA, tous confirment cette tendance.

Dans ce « mouvement de création de noyaux », Google peut être considéré comme un pionnier. La société a commencé à déployer des processeurs d'IA auto-développés en 2015 et fournit des services de puissance de calcul à des clients externes via une plateforme cloud depuis 2018. À titre de comparaison, Amazon AWS a lancé des puces Inferentia dédiées à l'inférence et des processeurs Trainium dédiés à la formation en 2018 et 2020 respectivement.

Analystes de la banque d'investissement D.A. Davidson a estimé dans un rapport de septembre dernier que la valorisation combinée de l'activité TPU de Google et de la division DeepMind AI était d'environ 900 milliards de dollars.

Actuellement, Nvidia occupe toujours la domination absolue sur le marché de la puissance de calcul de l’IA. Google n'a pas directement comparé les produits similaires de Nvidia dans cette version, mais a divulgué ses propres données d'itération de performances : au même prix, les performances de la nouvelle puce d'entraînement sont 2,8 fois supérieures à celles du TPU de septième génération (nom de code Ironwood) sorti en novembre de l'année dernière, et les performances de la nouvelle puce d'inférence ont augmenté de 80 %.

Il est à noter que sur la feuille de route technique, l’industrie parie unanimement sur la mémoire vive statique (SRAM). Qu'il s'agisse du prochain LPU Groq 3 de Nvidia ou de la licorne à puce IA Cerebras, qui vient de soumettre sa demande d'introduction en bourse ce mois-ci, ils s'appuient tous fortement sur cette technologie. La nouvelle puce d'inférence TPU 8i lancée cette fois par Google suit également cette tendance. Sa capacité SRAM sur une seule puce atteint 384 Mo, soit trois fois celle de la génération précédente d'Ironwood.

Sundar Pichai, PDG d'Alphabet, a souligné dans un article de blog que l'objectif de conception de la nouvelle architecture est de « fournir un débit énorme (Throughput) et une faible latence (Latency), permettant ainsi à des millions d'agents d'IA de fonctionner simultanément avec une rentabilité extrêmement élevée ».

En termes d'applications pour terminaux, Google a révélé que la commercialisation de ses puces d'IA est en pleine expansion. Parmi eux, le teneur de marché Citadel Securities a développé un logiciel de recherche quantitative basé sur le TPU ; 17 laboratoires nationaux relevant du département américain de l'Énergie déploient pleinement des systèmes « AI Co-scientist » basés sur cette puce. De plus, la startup d’IA Anthropic s’est engagée à utiliser les ressources de puissance de calcul TPU de Google de plusieurs gigawatts.