Le 24 avril, la version préliminaire du nouveau modèle de série DeepSeek, DeepSeek-V4, a été officiellement lancée et open source simultanément. Selon les rapports, DeepSeek-V4 a un contexte ultra long d'un million de mots et est leader dans les domaines nationaux et open source en termes de capacités d'agent, de connaissance du monde et de performances de raisonnement.

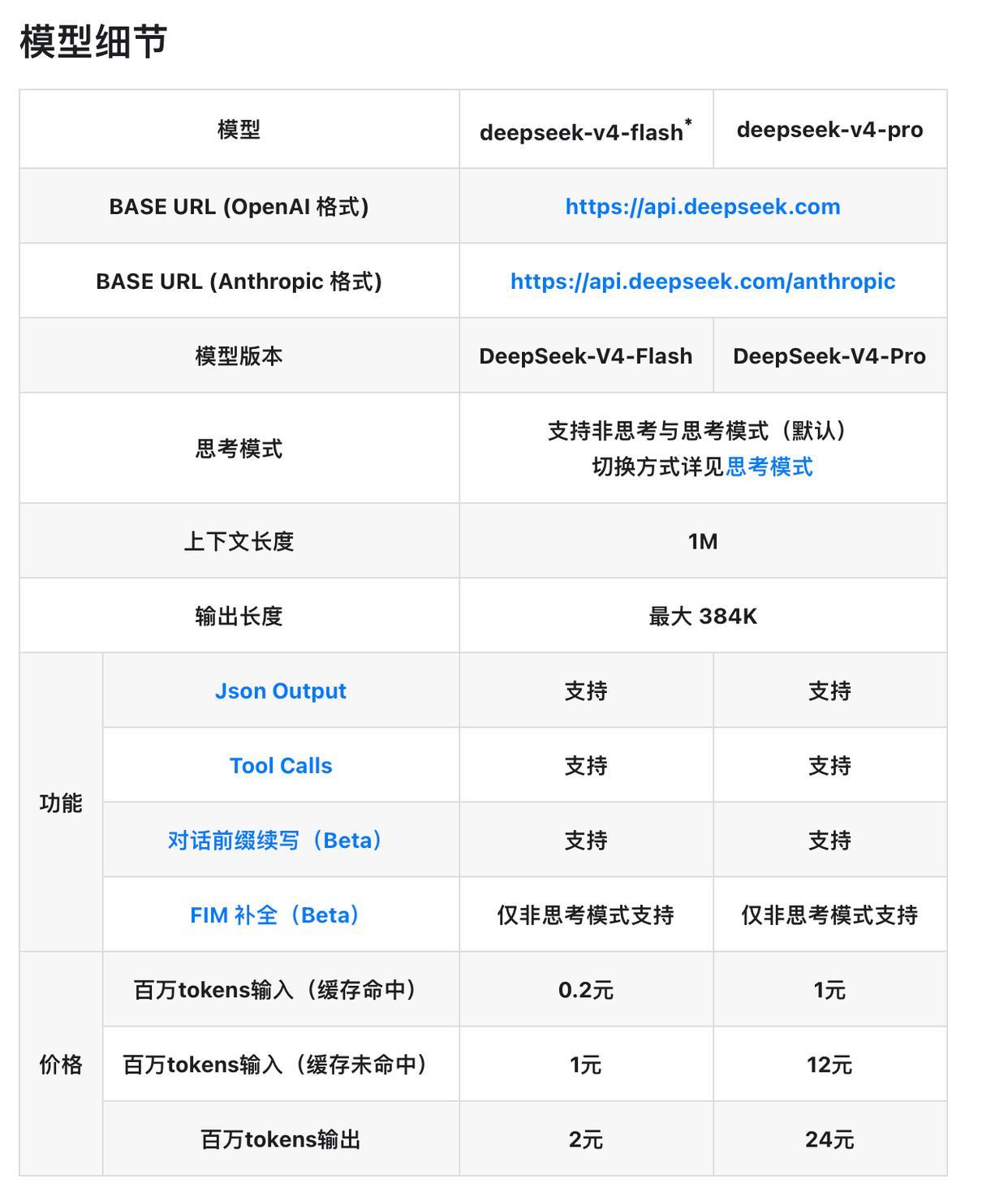

Connectez-vous désormais au site officiel chat.deepseek.com ou à l'application officielle pour parler du dernier DeepSeek-V4 et explorer la nouvelle expérience de la mémoire contextuelle ultra-longue de 1 M. Le service API a été mis à jour de manière synchrone et peut être appelé en modifiant le nom_modèle en deepseek-v4-pro ou deepseek-v4-flash.

De plus, DeepSeek-V4 a adapté et optimisé les produits Agent grand public tels que Claude Code, OpenClaw, OpenCode et CodeBuddy, améliorant ainsi ses performances dans des tâches telles que la génération de code et de documents. V4-Pro et V4-Flash prennent en charge une longueur de contexte de 1 million et fournissent à la fois un mode sans réflexion et un mode réflexion. Ce dernier peut définir le paramètre Reasoning_effort (high/max). Pour les scénarios d'agent complexes, la recommandation officielle est d'utiliser le mode réflexion et de régler l'intensité au maximum.