Cette fois, Ultraman ne s'est pas levé et n'a pas dit : "La première fois que j'en ai fait l'expérience, j'avais tellement peur que je me suis évanoui et je me suis effondré. À ce moment-là, c'était comme voir une bombe atomique exploser." Au lieu de cela, il a embauché un groupe de remplaçants (les premiers utilisateurs de test). Parmi eux se trouvait un ingénieur de Nvidia qui a brièvement perdu l'accès à GPT-5.5 après les premiers tests et a déclaré ceci :

Perdre GPT-5.5, c'est comme être amputé.

Parlons, créons des ennuis.

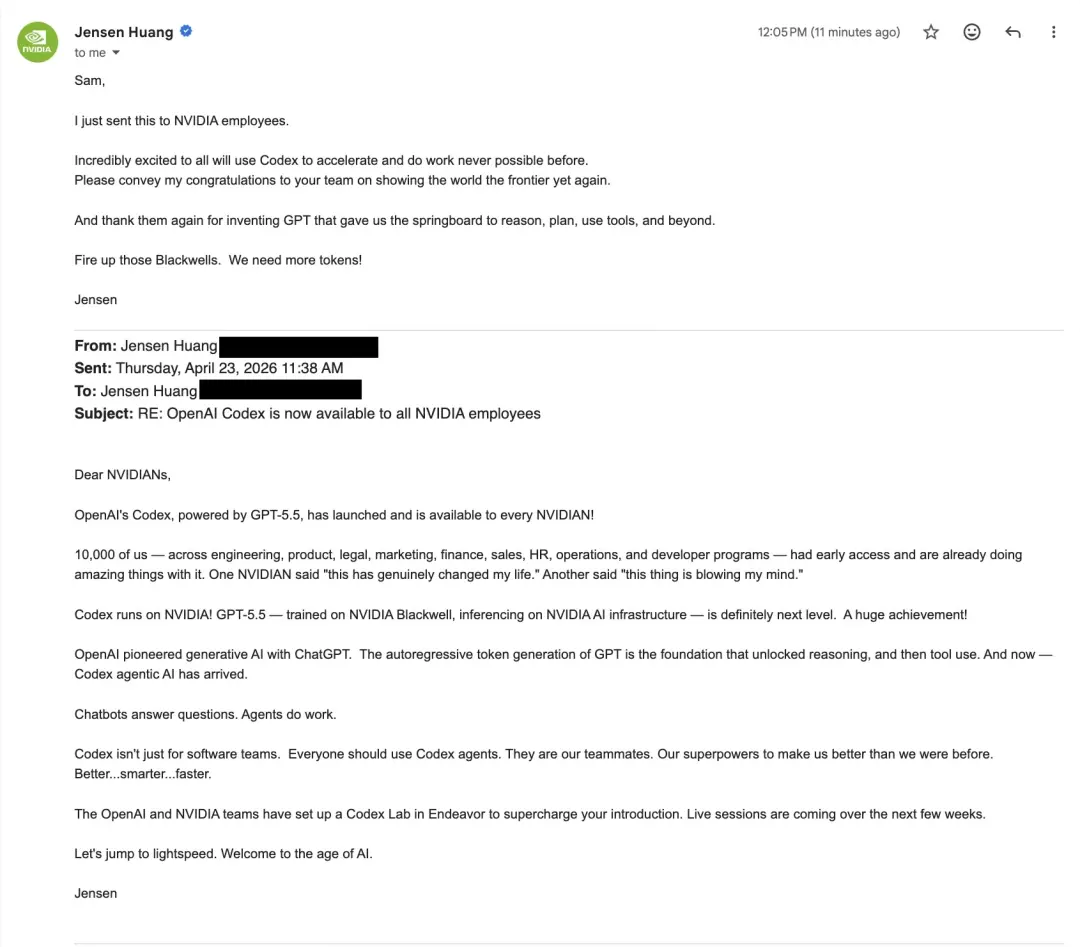

Cette coopération entre OpenAI et NVIDIA est sans précédent.

Premièrement, les systèmes GPT-5.5 et NVIDIA GB200 et GB300 NVL72 sont conçus conjointement. De la formation au déploiement, la relation entre modèle et matériel est bidirectionnelle depuis sa naissance.

Deuxièmement, pour promouvoir le Codex auprès de l'ensemble de la société NVIDIA, Ultraman a également publié un e-mail avec Lao Huang.

Examinons d'abord les résultats de la coopération.

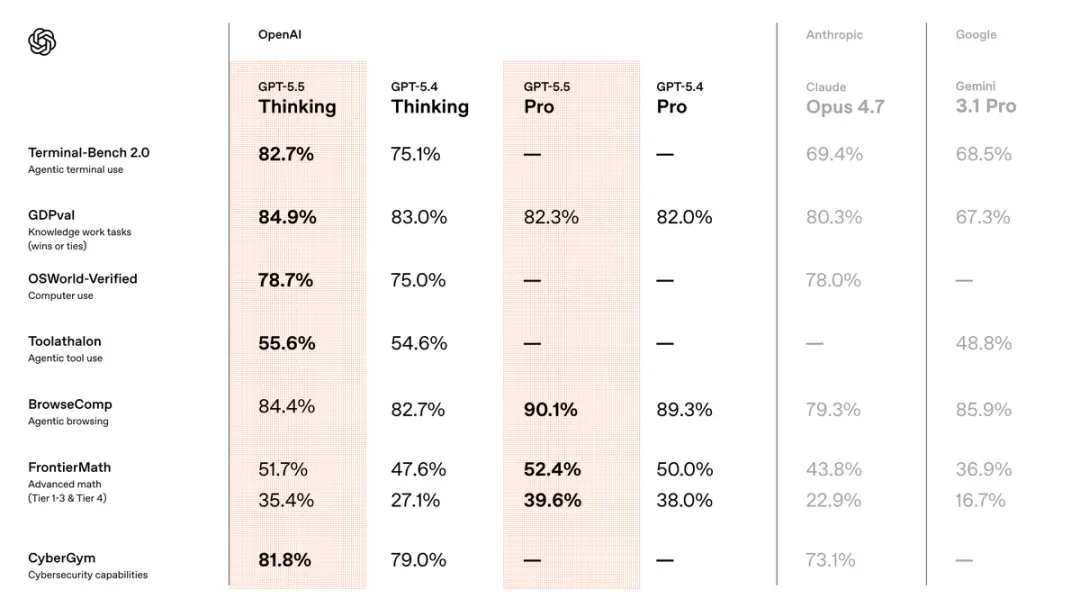

Par rapport à la version précédente GPT5.4, le nouveau modèle a pris la tête dans les trois domaines : le code, le travail de connaissances et la recherche scientifique.

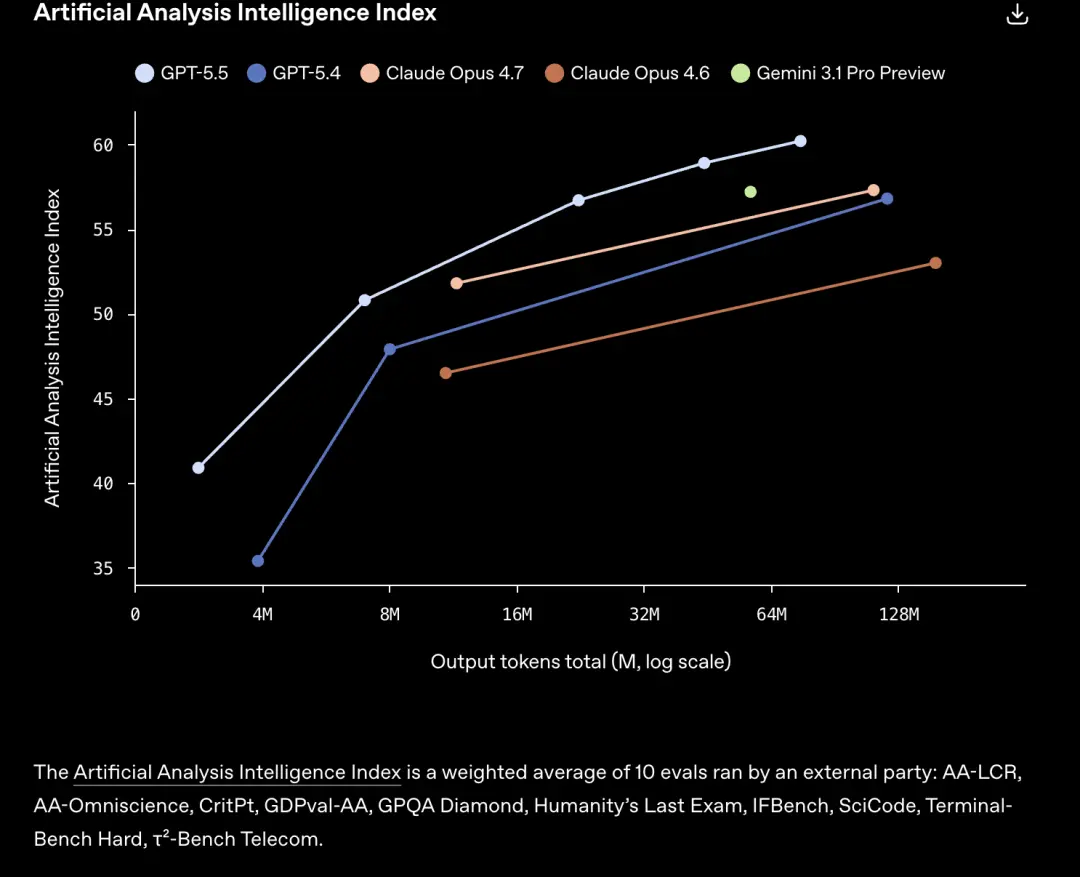

Test complet des résultats de l'indice d'intelligence d'analyse artificielle, il existe deux façons d'interpréter :

GPT-5.5 obtient le même score et consomme moins de jetons que Claude Opus 4.7 et d'autres modèles.

Ou en consommant le même jeton, GPT-5.5 peut effectuer plus de tâches.

Mais le plus surprenant n'est pas le score final.

Dans le passé, chaque mise à niveau de modèle, "plus forte" et "plus lente", était presque vendue dans un package.

C'est le prix de la loi de mise à l'échelle, un modèle plus grand, plus de paramètres et un temps de réflexion plus long. Lorsque les utilisateurs paient pour l’intelligence, ils paient également pour le retard.

GPT-5.5 enfreint cette loi d'airain.

Dans un environnement de production réel, sa latence jeton par jeton est équivalente à GPT-5.4, et moins de jetons sont nécessaires pour accomplir la même tâche que GPT5.4.

est plus efficace et plus puissant.

(mais le prix est doublé)

Au moment de mettre sous presse, la dernière version de la mise à jour du Codex peut déjà utiliser GPT-5.5.

La fenêtre contextuelle a également été mise à niveau à 400K

[GT32 GT]

Hacks de programmation

La programmation est le domaine dans lequel GPT-5.5 s'est le plus amélioré.

Lorsque vous utilisez le modèle de génération précédente, vous devez toujours décomposer soigneusement les tâches, les surveiller étape par étape et être prêt à corriger les écarts à tout moment.

GPT-5.5 est différent. Vous jetez les exigences et il se démonte, s'exécute et se vérifie. Il suffit de regarder les résultats.

OpenAI a présenté un jeu d'action 3D généré par GPT-5.5 sous Codex, exécuté directement sur la page Web.

inclut l'utilisation de TypeScript/Three.js pour implémenter le système de combat, les rencontres ennemies, les commentaires HUD et les textures d'environnement générées par GPT.

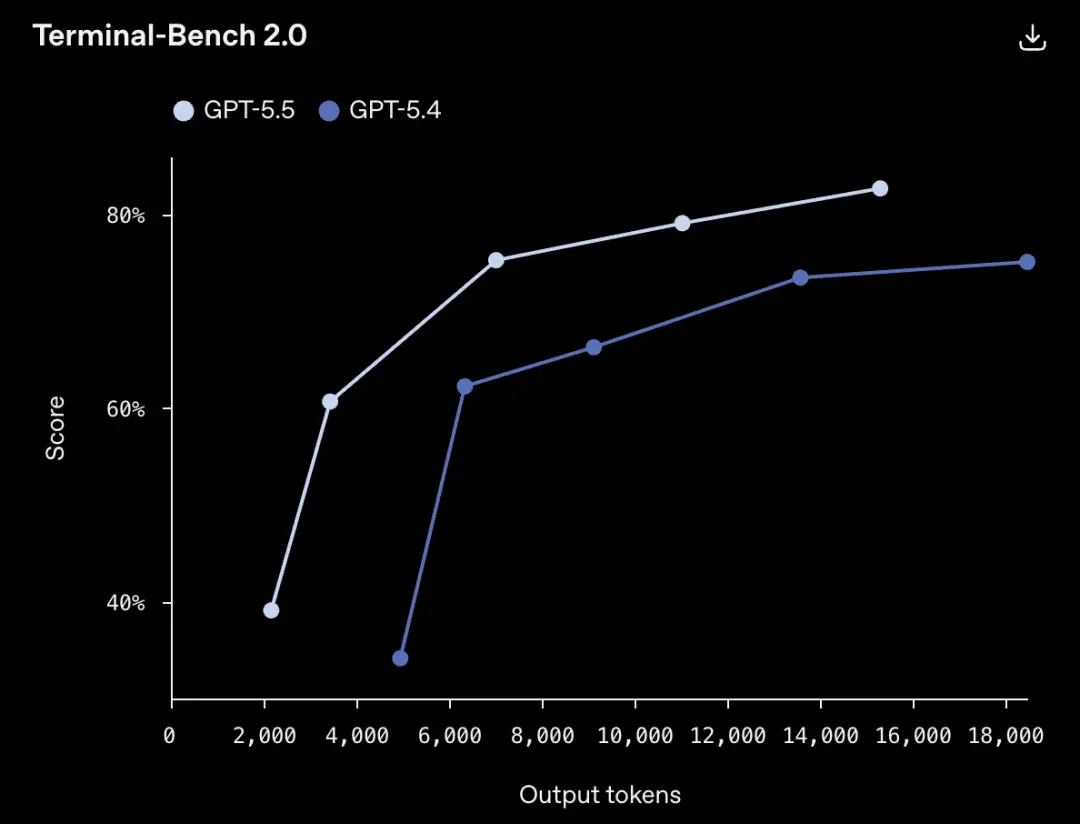

Terminal-Bench 2.0, un test hardcore qui mesure les flux de travail complexes en ligne de commande, GPT-5.5 a obtenu 82,7 %.

Le GPT-5.4 de la version précédente était de 75,1 %, et le concurrent actuel le plus puissant, Claude Opus 4.7, était de 69,4 %.

On peut comprendre que face à ce niveau de difficulté, près d'un tiers des modèles de la génération précédente resteraient bloqués, mais cette proportion est désormais tombée à moins d'un quart.

Ensuite, veuillez remplacer votre bouche :

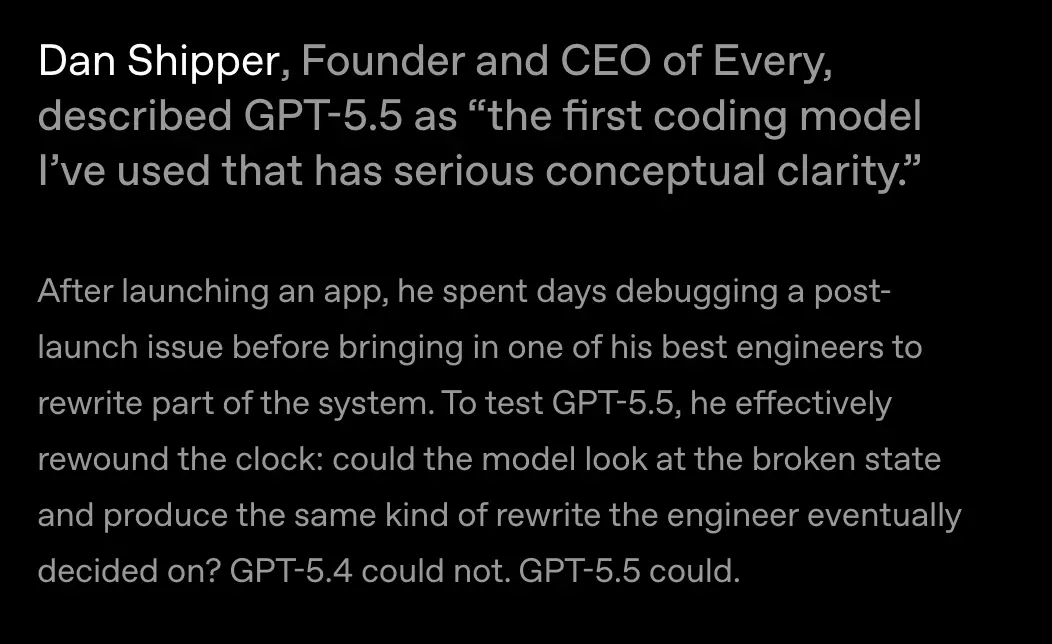

Le premier testeur Dan Shipper a fait une expérience. Il est PDG d’une startup et développeur actif de produits d’IA.

Il y avait un bug dans son application après son lancement, il a donc embauché un ingénieur de haut niveau pour la reconstruire. Les ingénieurs ont travaillé dur et ont finalement trouvé une solution.

Ensuite, Shipper revient en arrière : lancez le code du buggy au modèle et voyez s'il peut prendre indépendamment la même décision que l'ingénieur.

GPT-5.4 ne peut pas le faire. GPT-5.5 l'a fait.

Shipper a déclaré que c'était la première fois qu'il faisait l'expérience d'une véritable « clarté conceptuelle » dans un modèle de programmation.

ne répond pas à l'appel, mais comprend le problème et trouve comment le résoudre.

De plus en plus d'ingénieurs seniors rapportent la même chose : GPT-5.5 est nettement plus puissant que GPT-5.4 et Claude Opus 4.7 en termes de raisonnement et d'autonomie.

Il détecte les problèmes à l'avance et anticipe les besoins en matière de tests et de révision sans invite explicite.

La programmation n'est que le début. Le même saut de capacité s’étend à la fois au travail du savoir et à la recherche scientifique.

En plus de la programmation

Ce que GPT-5.5 fait dans le Codex est bien plus que simplement écrire des programmes. Générez des documents, organisez des formulaires et créez des PPT.

OpenAI a souligné à plusieurs reprises qu'il comprend mieux ce que vous voulez que la génération précédente.

Ce qui est plus important, c'est que utilisera ses propres outils pour vérifier si le résultat est correct. Vous me donnez une vague idée et cela peut vous aider à compléter le reste.

Il y a ici des données très intéressantes. Plus de 85 % des employés d’OpenAI travaillent chaque semaine sur Codex. (Que se passe-t-il avec les 15 % restants ?)

Regardons d’abord les résultats de l’évaluation.

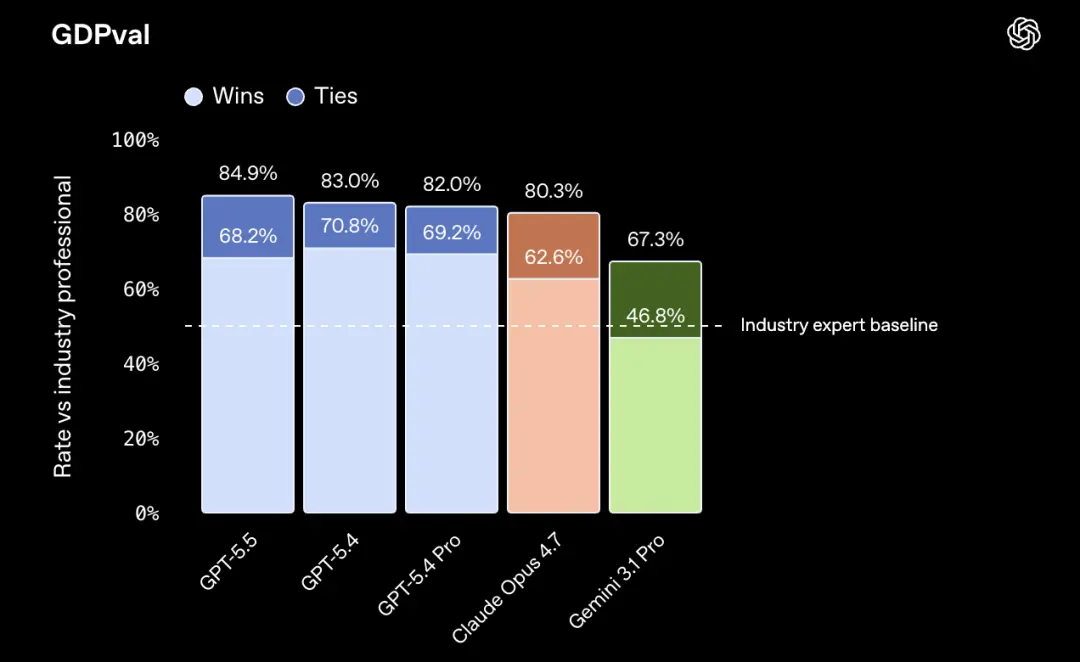

Sur le benchmark du travail de connaissances GDPval , GPT-5.5 a obtenu 84,9 %, soit 4,6 points de pourcentage de plus que Claude Opus 4.7.

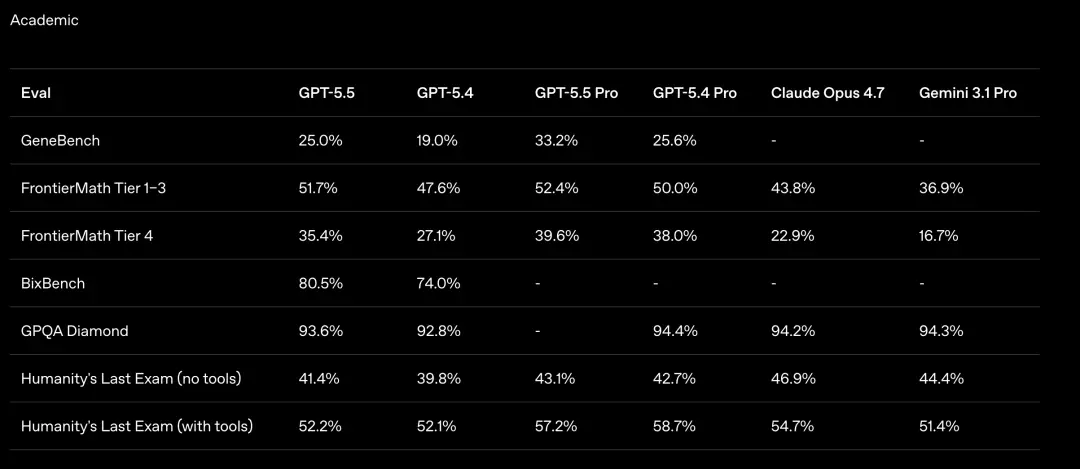

FrontierMath Tier 4, L'un des tests mathématiques les plus difficiles actuellement, les questions proviennent d'articles non publiés et de problèmes ouverts rédigés par des chercheurs de haut niveau.

GPT-5.5 Pro a obtenu un score de 39,6 % dans ce test. Claude Opus 4.7 est à 22,9%, l'écart est presque le double.

Ce qui est vraiment intéressant, c'est la manière dont les scientifiques l'utilisent.

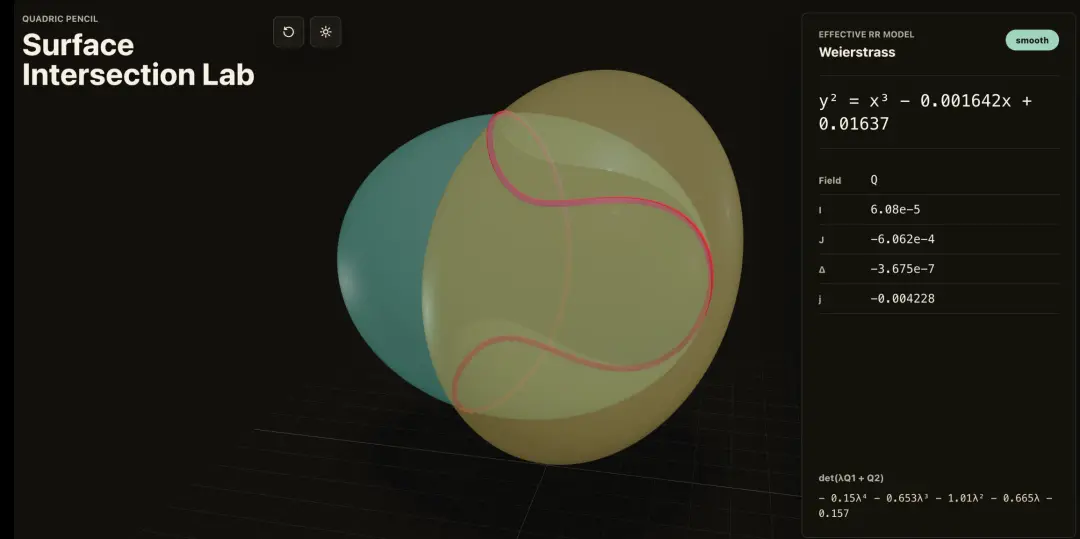

Bartosz Naskręcki est professeur adjoint de mathématiques à l'université Adam Mickiewicz en Pologne. Il a écrit une phrase au Codex et 11 minutes plus tard, une application de visualisation de géométrie algébrique était en cours d'exécution.

Cette application peut tracer la ligne d'intersection de deux surfaces quadratiques, marquées en rouge, et peut également utiliser le théorème de Riemann-Roch pour convertir la ligne d'intersection dans la forme standard de la courbe de Weierstrass. Plus tard, il l'a étendu avec des capacités de visualisation de singularité plus stables.

En une phrase, 11 minutes. Dans le passé, la simple mise en place du cadre du projet prenait une demi-journée.

Derya Unutmaz est professeur d'immunologie au Jackson Laboratory for Genomic Medicine. Il a utilisé GPT-5.5 Pro pour analyser un ensemble de données d'expression génique : 62 échantillons, près de 28 000 gènes. Enfin, un rapport de recherche complet a été produit.

Cela aurait pris plusieurs mois à l'équipe, a-t-il déclaré.

Le positionnement de GPT-5.5 par OpenAI dans la recherche scientifique peut être résumé avec précision en une phrase. Il ne s'agit plus d'un moteur de réponse unique, mais plutôt d'un « partenaire de recherche ».

Les premiers testeurs l’utilisent pour bien plus que simplement rechercher des informations. Plusieurs cycles de correction du document, identifiant une par une les failles de l'argumentation et proposant de nouveaux plans d'analyse. Il mémorise l’intégralité de votre contexte de recherche et chaque conversation s’appuie sur la précédente.

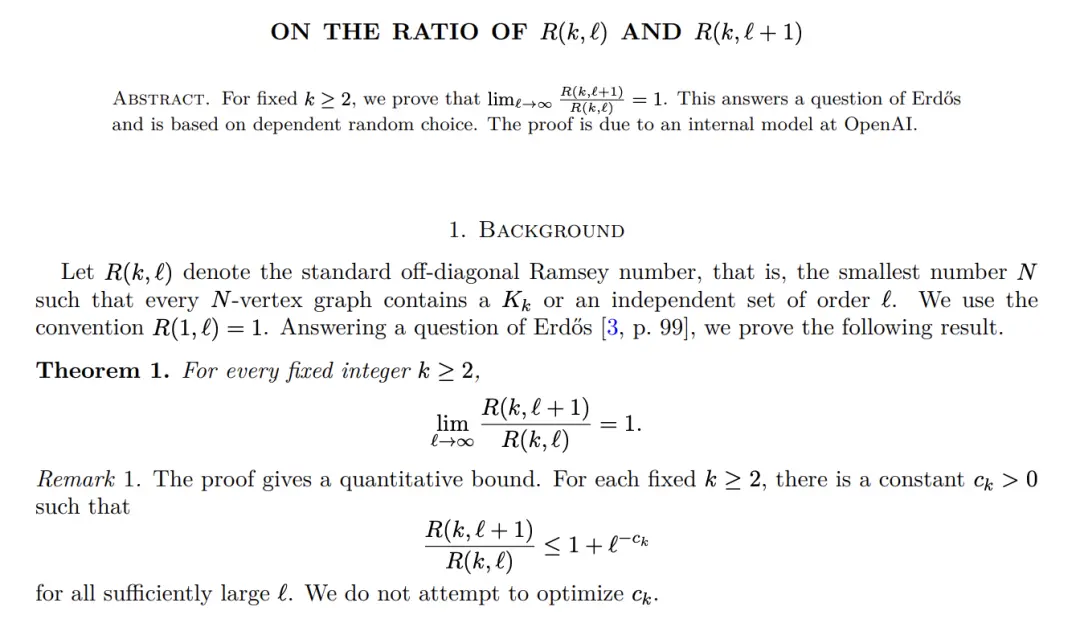

GPT-5.5 a fait une grande chose dans le domaine des mathématiques.

Nombre de Ramsey, l'un des problèmes centraux des mathématiques combinatoires.

En termes simples, il étudie : quelle doit être la taille d'un réseau pour garantir qu'un certain ordre apparaîtra inévitablement ?

Par exemple, trois personnes sur six doivent se connaître, ou trois personnes ne doivent pas se connaître. C'est le théorème de Ramsey le plus simple.

C'est un problème difficile dans le domaine des mathématiques depuis des décennies, et les propriétés asymptotiques des nombres de Ramsey hors diagonale sont restées longtemps non résolues.

GPT-5.5 trouve un nouveau chemin de preuve. Plutôt que de reproduire une méthode connue, nous avons découvert une nouvelle voie. Par la suite, cette preuve a été confirmée par Lean, l’un des outils de vérification formelle les plus rigoureux en mathématiques.

Une IA qui a apporté des contributions originales vérifiées par des outils formels dans le domaine central des mathématiques pures.

Il y a un an, cela aurait été impensable.

Le secret pour être plus fort mais pas plus rapide

Comment devenir « plus fort mais pas plus rapide » ?

La réponse n'est pas d'optimiser un certain lien. OpenAI a renversé tout le système de raisonnement et a recommencé.

Comme mentionné précédemment, les systèmes GPT-5.5 et NVIDIA GB200 et GB300 NVL72 sont conçus conjointement. En conséquence, dans le même délai, le niveau de renseignement a considérablement augmenté.

Mais il y a une autre histoire.

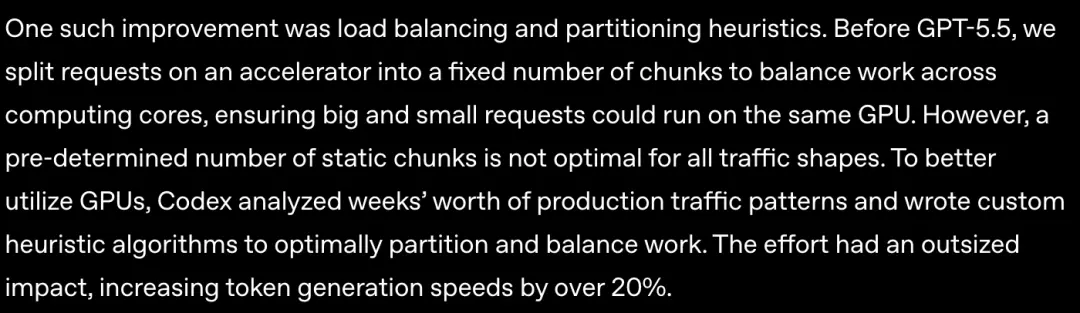

Le système Codex piloté par GPT-5.5 a analysé plusieurs semaines de données de trafic de production, puis a écrit un algorithme heuristique de partition d'équilibrage de charge.

Auparavant, les requêtes étaient divisées en un nombre fixe de morceaux et distribuées aux accélérateurs pour traitement. Cependant, une stratégie de segmentation fixe n’est pas toujours optimale selon différents modèles de trafic. Parfois, les blocs sont divisés de manière trop grossière, parfois trop finement, et le taux d'utilisation des ressources est élevé et faible.

Codex a examiné quelques semaines de données de trafic réelles et a écrit un ensemble d'algorithmes de partitionnement adaptatif. Ajustez dynamiquement la stratégie de blocage en fonction des modèles de trafic réels.

La vitesse de génération des jetons a été augmentée de plus de 20 %.

Le modèle optimise l'infrastructure pour fonctionner tout seul, et l'IA se fait fonctionner plus rapidement.

La reconstruction globale du système d'inférence, couplée à la participation du modèle à sa propre optimisation, deux choses se sont superposées pour aboutir à de tels résultats.

OpenAI affirme qu'il s'agit « d'un pas vers une nouvelle façon de faire avancer les choses avec les ordinateurs ».

Mais lorsque le modèle a commencé à optimiser l'infrastructure pour son propre fonctionnement -

Jusqu'où est-il allé ?

One More Thing

Avec GPT-5.5, OpenAI s'attend à ce que les données de publication des modèles s'accélèrent à l'avenir.

Nous constatons des progrès assez significatifs à court terme et des progrès extrêmement significatifs à moyen terme.

Je pense que les progrès ont été étonnamment lents ces dernières années.

C'est le scientifique en chef Jakub Pachocki qui a déclaré cela lors d'une conférence téléphonique avec les journalistes.