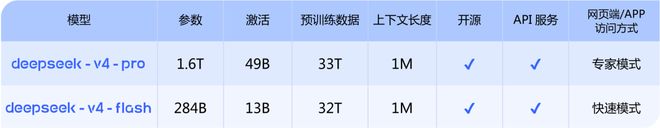

Le très attendu DeepSeek V4 est enfin disponible ! Tout à l'heure, la version préliminaire tant attendue de DeepSeek V4 a été officiellement lancée. Deux versions - V4-Pro et V4-Flash, toute la série est livrée en standard avec un contexte ultra-long de 1 million (millions de mots), des pondérations de modèles open source synchronisées et des rapports techniques .

Dans les deux jours précédant le 1er mai, les grands modèles sont entrés dans une nouvelle vague de sorties.

Le 23 avril à midi, "Genius Boy" Yao Shunyu a remis sa première feuille de réponses modèle après avoir rejoint Tencent. La version préliminaire de Tencent Hunyuan Hy3 a été dévoilée. Il possède une architecture MoE de 295 milliards de paramètres, des paramètres activés 21B, une efficacité d'inférence augmentée de 40 % et le prix d'entrée a été réduit à 1,2 yuans/million de jetons.

Tôt ce matin, OpenAI a lancé GPT-5.5 pour les utilisateurs payants et a officiellement annoncé le plan API, qui se concentre sur le flux de travail des agents et l'exécution de tâches en plusieurs étapes. La fenêtre contextuelle a été étendue à 1 million de jetons et le prix de l'API a également augmenté : entrée de 5 $, sortie de 30 $/million de jetons.

En apparence, les trois sociétés ont des voies différentes : OpenAI emprunte la voie des sources fermées haut de gamme et continue de relever le plafond des prix ; Tencent intègre le modèle à son propre écosystème et utilise la rentabilité pour tirer parti d'une commercialisation à grande échelle ; DeepSeek perpétue la tradition open source et pousse en même temps la longueur du contexte à un nouveau point critique inclusif.

À la fois, capacités de l'agent, contexte ultra long, appels de code et d'outils, ces trois mots-clés,Il apparaît à plusieurs reprises dans les nouveaux modèles lancés par les trois sociétés. Ils se concentrent tous dans la même direction : permettre au modèle de traiter des informations plus longues, de fonctionner de manière autonome dans des chaînes de tâches plus complexes et d'être véritablement intégré dans le flux de travail 「」.

01

Le "pragmatisme" de DeepSeek V4

DeepSeek Cette version a changé le contexte de Million Words de "haut de gamme facultatif" à "de base norme".

Avant cela, les longueurs de contexte de niveau 1M étaient plus courantes dans les versions haut de gamme des modèles phares à code source fermé. Le coût élevé des appels était suffisant pour interdire la plupart des développeurs et des petites et moyennes entreprises.

L'approche de DeepSeek est très claire : les versions V4-Pro et V4-Flash sont équipées en standard d'une longueur de contexte de 1 M. Le premier ancre la performance ultime, tandis que le second offre une option économique inclusive, couvrant entièrement les utilisateurs ayant des besoins différents. Cette stratégie de « décentralisation aveugle des capacités de base » abaisse complètement le seuil d’acquisition par l’industrie des capacités de traitement de textes longs.

Source de l'image : site officiel de DeepSeek

La version Flash se concentre sur une latence extrêmement faible et des performances à coût élevé, et constitue la solution principale de DeepSeek pour les scénarios légers à haute fréquence . Avec des paramètres d'activation 13B, un nouveau mécanisme d'attention de compression de jetons et une optimisation de l'architecture d'attention clairsemée DSA, il atteint une vitesse de réponse extrêmement rapide tout en garantissant des capacités de raisonnement proches des principales de la version Pro. Pour les interactions de dialogue en temps réel, les pipelines d'appels de fonctions et même tous les scénarios légers sensibles à la vitesse de réponse, cette fonctionnalité peut apporter une amélioration substantielle de l'expérience.

Ce qui est plus critique est la structure de coûts compétitive .

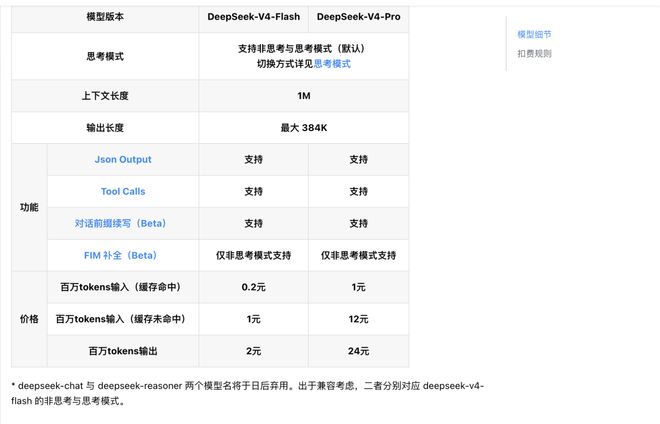

Selon le document officiel de tarification de l'API de DeepSeek, la version Flash adopte une règle de facturation à plusieurs niveaux : le jeton d'entrée pour un accès au cache est aussi bas que 0,2 yuan/million de jetons, le jeton d'entrée pour un échec de cache est de 1 yuan/million de jetons et le jeton de sortie est au prix de 2 yuans/million de jetons.

Différentes versions de DeepSeek V4 sont devenues | Source de l'image : document API DeepSeek

Une telle tarification conviviale, combinée à la capacité contextuelle 1M fournie en standard avec toute la série, fait que le « coût par appel » n'est plus une contrainte fondamentale dans la conception technique : les développeurs peuvent donner la priorité à l'expérience produit et à la conception architecturale sans faire de compromis répétés entre le nombre d'appels et les coûts.

Flash répond à la demande universelle de « abordable et rapide », tandis que V4-Pro répond à une autre question centrale : jusqu'où peut-on repousser les limites des capacités des grands modèles open source.

L'amélioration de capacité la plus intuitive tourne toujours autour du contexte long. DeepSeek augmente directement la longueur du contexte du modèle de 128 Ko dans la génération précédente V3.2 à 1 Mo (un million de jetons). En conjonction avec l'innovation de l'architecture sous-jacente, il réduit considérablement les besoins en calcul de contexte long et en mémoire vidéo tout en garantissant que les performances de la fenêtre de contexte complète sont intactes.

À cette échelle, les développeurs peuvent importer directement des bases de code complètes, des documents industriels ultra-longs, des fichiers de projet à plusieurs tours et même des livres complets contenant des millions de mots pour un traitement de bout en bout, sans avoir besoin de créer des systèmes complexes supplémentaires de génération d'augmentation de récupération (RAG), ce qui simplifie grandement le lien technique du traitement de texte long.

En termes d'architecture sous-jacente, la version Pro utilise une architecture MoE avec un paramètre total de 1,6T et un paramètre d'activation de 49B. La quantité de données de pré-entraînement atteint 33T, ce qui constitue un approfondissement complet de la voie experte hybride DeepSeek. Les données d'évaluation officielles montrent que dans les évaluations de raisonnement de base telles que les mathématiques, les STEM et le code de niveau compétition, il a surpassé tous les modèles open source actuellement évalués publiquement et atteint un niveau comparable aux meilleurs modèles fermés au monde.

En termes de capacités de l'agent, sa qualité de livraison est proche du mode sans réflexion de Claude Opus 4.6 , les retours d'utilisation internes sont meilleurs qu'Anthropic Sonnet 4.5 et sont devenus le principal outil de codage agent pour les employés internes de DeepSeek.

Au niveau fonctionnel, les deux versions de la série V4 prennent en charge à la fois le mode sans réflexion et le mode réflexion. Les développeurs peuvent personnaliser l'intensité de la réflexion via le paramètre Reasoning_effort. Dans le même temps, ils prennent entièrement en charge la sortie Json, les appels d’outils et les capacités de continuation des préfixes de conversation.

En termes de prix, la version Pro poursuit également la voie rentable . Le prix officiel est le suivant : jeton d'entrée 1 yuans/million de jetons pour les accès au cache, jeton d'entrée 12 yuans/million de jetons pour les échecs de cache et le prix du jeton de sortie 24 yuans/million de jetons, ce qui est nettement inférieur aux modèles phares étrangers à source fermée du même niveau. L'accès à l'API

a également atteint un seuil extrêmement bas. Les développeurs n'ont pas besoin de modifier la base_url d'origine. Il leur suffit de remplacer le paramètre model par le nom de version correspondant pour finaliser l'accès. Il est également compatible avec les formats d’interface OpenAI ChatCompletions et Anthropic.

Cette combinaison de « capacités accrues + coûts réduits » fait que les capacités de premier ordre des grands modèles ne sont plus la ressource exclusive de quelques fabricants. Alors que l’industrie tombe progressivement dans un cercle vicieux de course aux armements paramétriques, DeepSeek propose un nouveau modèle pour l’universalisation des grands modèles avec la configuration standard de millions de contextes et des options open source à lien complet.

Dans le même temps, DeepSeek V4 a apporté des adaptations et des optimisations spéciales pour les produits Agent grand public tels que Claude Code, OpenClaw, OpenCode et CodeBuddy, et ses performances ont été améliorées dans des scénarios réels tels que les tâches de codage et la génération de documents. La valeur du modèle doit en fin de compte être testée dans des processus de développement et de travail réels.

02

continue d'être open source et l'API est entièrement ouverte

DeepSeek poursuit la route open source et ouvre directement tous les appels d'API.

Actuellement, les poids des modèles de DeepSeek-V4 ont été simultanément ouverts au téléchargement sur les plates-formes Hugging Face et ModelScope, et les rapports techniques de support ont également été rendus publics, aidant les développeurs pour le déploiement local et le développement secondaire.

Différentes de la pratique industrielle de « version castrée open source, version complète source fermée » par certains fabricants, les deux versions open source conservent entièrement toutes les capacités compatibles avec l'API cloud officielle - y compris le double mode non-pensée/pensée, le traitement sans perte de contexte ultra-long 1M, l'optimisation spéciale de l'agent et les capacités d'appel d'outils complètes, sans aucune castration fonctionnelle.

Cela signifie que que vous soyez une startup de petite ou moyenne taille, un développeur individuel ou une institution de recherche scientifique, vous pouvez obtenir une large base de modèles avec des millions de contextes, un raisonnement de haut niveau et des capacités d'agent à seuil zéro. Vous n’avez plus besoin de payer des frais d’interface élevés pour les fonctionnalités de modèles haut de gamme.

Afin d'abaisser davantage le seuil de mise en œuvre, DeepSeek a simultanément rendu open source la chaîne d'outils complète du processus pour le réglage fin du modèle, la quantification et l'accélération de l'inférence, complété l'adaptation native du jour 0 des cadres d'inférence traditionnels tels que vLLM et TGI, et des cadres d'agents traditionnels tels que LangChain et LlamaIndex. Il a également ouvert une solution de déploiement complète pour les plates-formes informatiques nationales, permettant aux développeurs de mettre en œuvre rapidement des applications dans différents environnements matériels.

Dans le même temps, DeepSeek a également donné un plan de transition d'itération de modèle clair : les anciens noms de modèle d'interface API deepseek-chat et deepseek-reasoner cesseront d'être utilisés dans trois mois (24 juillet 2026). Au stade actuel, ces deux noms de modèles font respectivement référence au mode non-réflexion et au mode réflexion de deepseek-v4-flash, laissant suffisamment de temps aux développeurs pour migrer en douceur.

03

Déterminé à faire de l'IA un « modèle d'infrastructure »

En regardant les versions des deux derniers jours, une tendance est claire : chaque entreprise accélère les capacités des agents.

Au cours des deux dernières années, l'attention du public et des marchés financiers sur les grands modèles s'est largement concentrée sur « l'intelligence », mais elle s'est désormais tournée vers « qui peut faire avancer les choses de manière plus stable ». L'objectif de la version GPT-5.5 n'est pas l'amélioration de la compréhension multimodale, mais ses capacités d'exécution continue dans des scénarios tels que la programmation d'agents, l'utilisation de l'ordinateur et le travail de connaissances. Le principal argument de vente de Tencent Hunyuan Hy3 est également sa « capacité à agir » dans le monde réel. DeepSeek V4 se concentre directement sur les capacités de l'agent et le traitement de contextes longs, avec un objectif clair sur les charges de travail réelles.

Derrière ce changement se cache le fait que l'ensemble de l'industrie s'oriente vers la concurrence dans le « modèle d'utilité ». De nos jours, les utilisateurs et les entreprises clientes se soucient de moins en moins du classement de votre modèle dans une certaine évaluation. Ce qui les intéresse, c'est la quantité de travail que le modèle et le produit peuvent les aider à accomplir : si ce modèle peut m'aider à écrire du code, s'il peut gérer des documents complexes, s'il peut effectuer des tâches en plusieurs étapes sans erreurs et s'il peut s'exécuter à un coût raisonnable.

Source de l'image : site officiel de DeepSeek

À la fin de l'article publié aujourd'hui, DeepSeek citant une phrase de "Xunzi" : " Ne vous laissez pas tenter par les éloges, n'ayez pas peur des calomnies, suivez le chemin et soyez debout ", suite pour ancrer son propre parcours technique. Dans le contexte actuel de compétition de grands modèles, le sens de cette phrase est très clair : ne vous laissez pas déranger par les évaluations externes et le bruit, et concentrez-vous sur bien faire les choses.

Les actions de DeepSeek au cours de la dernière année ont en effet mis en œuvre cette logique : utiliser l'open source et l'ouverture pour établir une influence écologique mondiale des développeurs, utiliser la rentabilité ultime pour briser les barrières à l'utilisation de capacités d'IA haut de gamme, et utiliser une solide innovation d'architecture sous-jacente pour résoudre les problèmes les plus réels des développeurs et des utilisateurs d'entreprise.

Depuis l'émergence du modèle d'inférence R1 jusqu'à la V4 poussant pour la première fois les capacités de contexte long à la plage inclusive, DeepSeek a fait une chose plus difficile d'une manière relativement « lente » - Transformez les capacités des modèles haut de gamme d'un outil destiné à quelques personnes en une infrastructure que davantage de personnes peuvent appeler directement .