Le 24 avril, la version préliminaire de DeepSeek-V4 a été officiellement publiée et open source simultanément. prétend avoir atteint le premier niveau dans les domaines nationaux et open source dans les trois dimensions de la capacité des agents, de la connaissance du monde et des performances de raisonnement. DeepSeek-V4 est divisé en deux versions, Pro et Flash, toutes deux prenant en charge un contexte ultra long d'un million (1 million) de jetons. Les deux versions réduisent considérablement les besoins en mémoire informatique et graphique, en réduisant les FLOP d'inférence par balise de 73 % et en réduisant l'utilisation de la mémoire cache KV de 90 %.

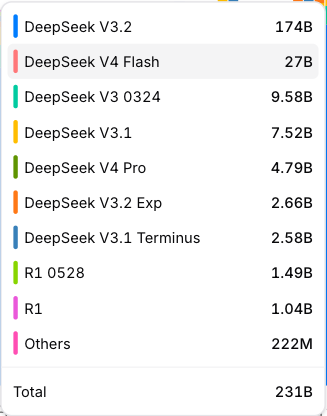

Le 24 avril, les données d'OpenRouter, la plus grande plateforme d'agrégation d'interfaces de programmation d'applications de modèles d'IA au monde, ont montré que le nombre d'appels vers V4-Flash atteignait 27 milliards de jetons, et celui de V4-Pro était de 4,79 milliards de jetons, mais ils n'apparaissaient pas dans le classement.

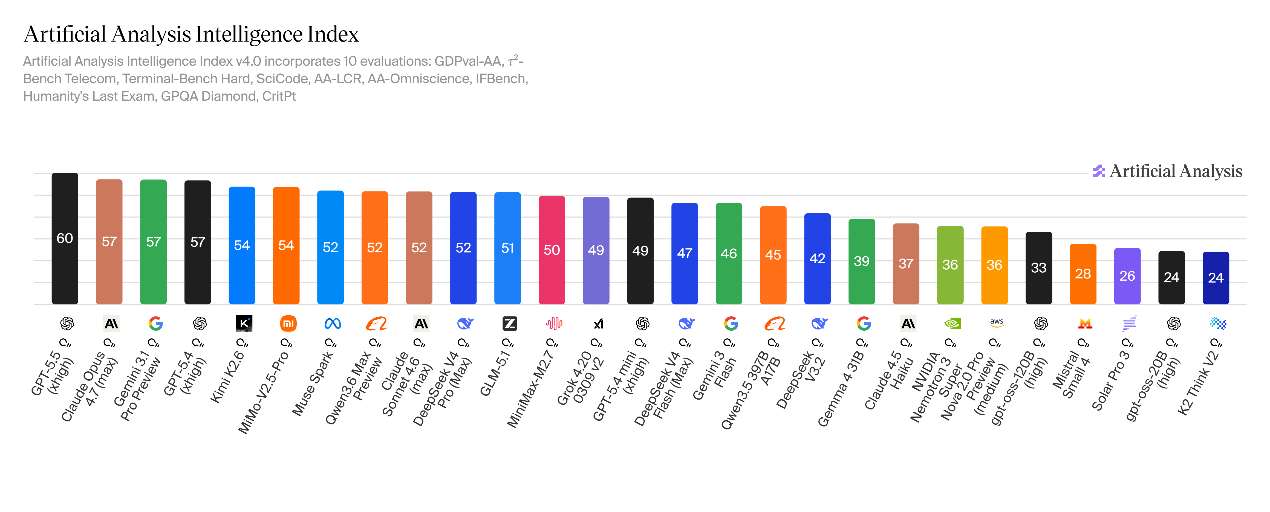

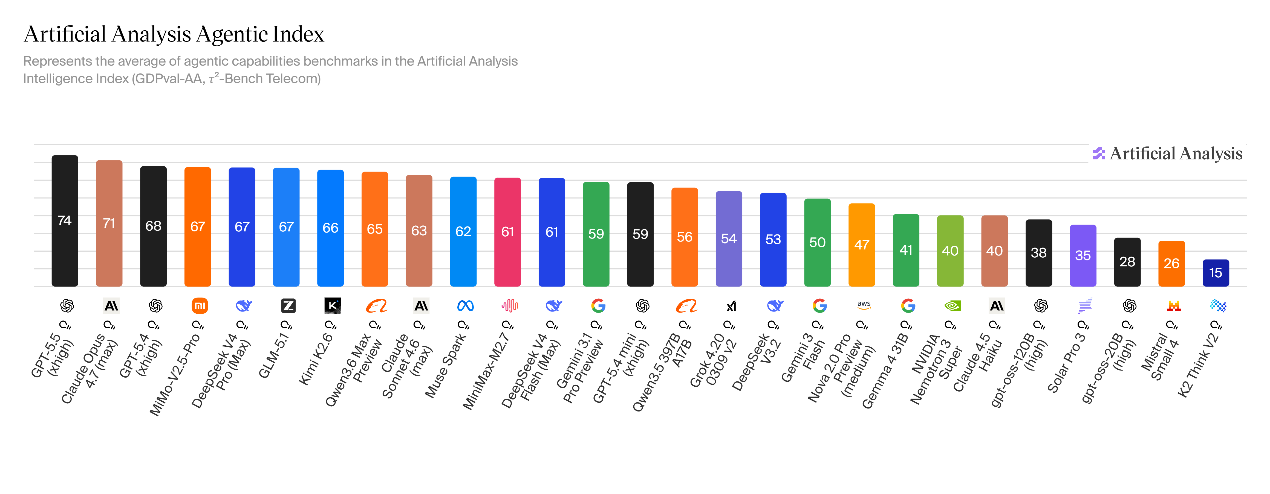

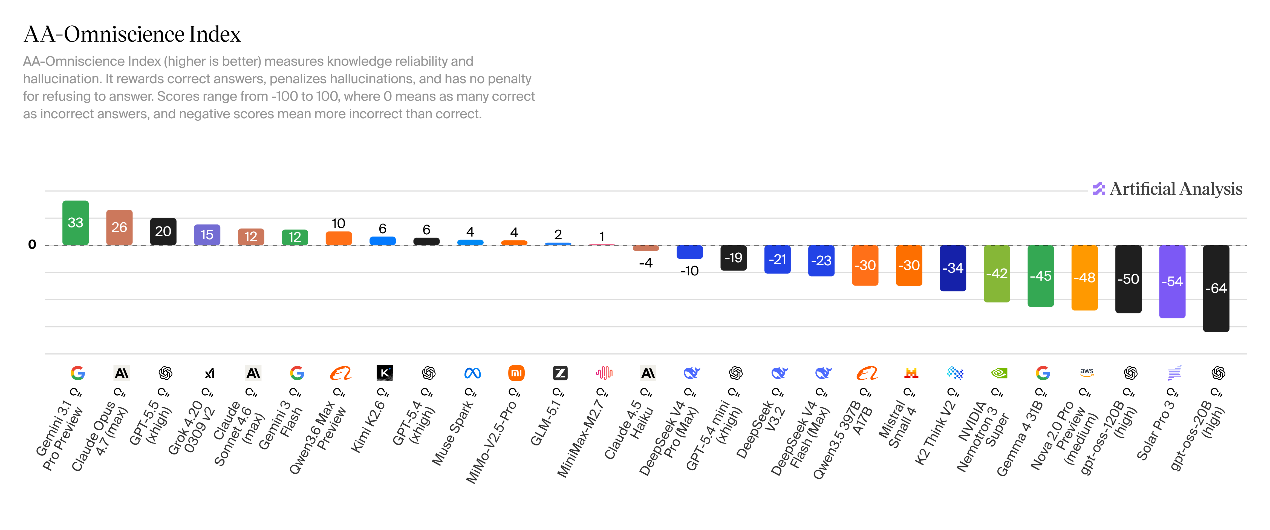

Après la sortie de DeepSeek-V4, les plateformes d'évaluation grand public ont effectué des tests de capacités et des classements.

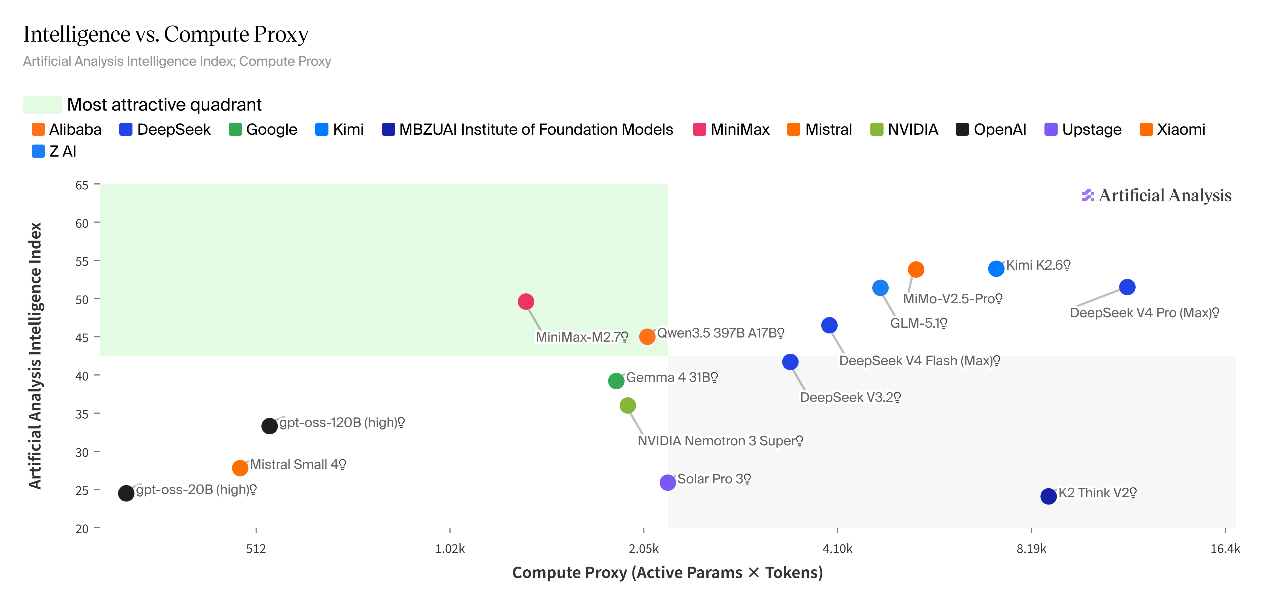

Artificial Analysis a mené une évaluation spéciale des capacités de raisonnement de DeepSeek-V4. Les résultats montrent que V4-Pro a obtenu 52 points dans l'indice d'intelligence d'analyse artificielle, a réalisé un bond de 10 points par rapport aux 42 points de la version V3.2 et est devenu le deuxième plus grand modèle d'inférence open source au monde après Kimi K2.6.

V4-Flash a marqué 47 points. Ses performances sont plus faibles que celles du V4-Pro, mais elles surpassent largement DeepSeek-V3.2. Son niveau d'intelligence complet est comparé à celui de Claude Sonnet 4.6 (version complète), qui se situe entre le modèle open source haut de gamme et le modèle milieu de gamme grand public.

En termes de performances des tâches d'agent, V4-Pro offre les performances les plus élevées parmi tous les modèles de pondération open source dans les tâches d'agent réelles. a obtenu un score de 1 554, surpassant Kimi K2.6 (1 484), GLM-5.1 (1 535), GLM-5 (1 402) et MiniMax-M2.7 (1 514).

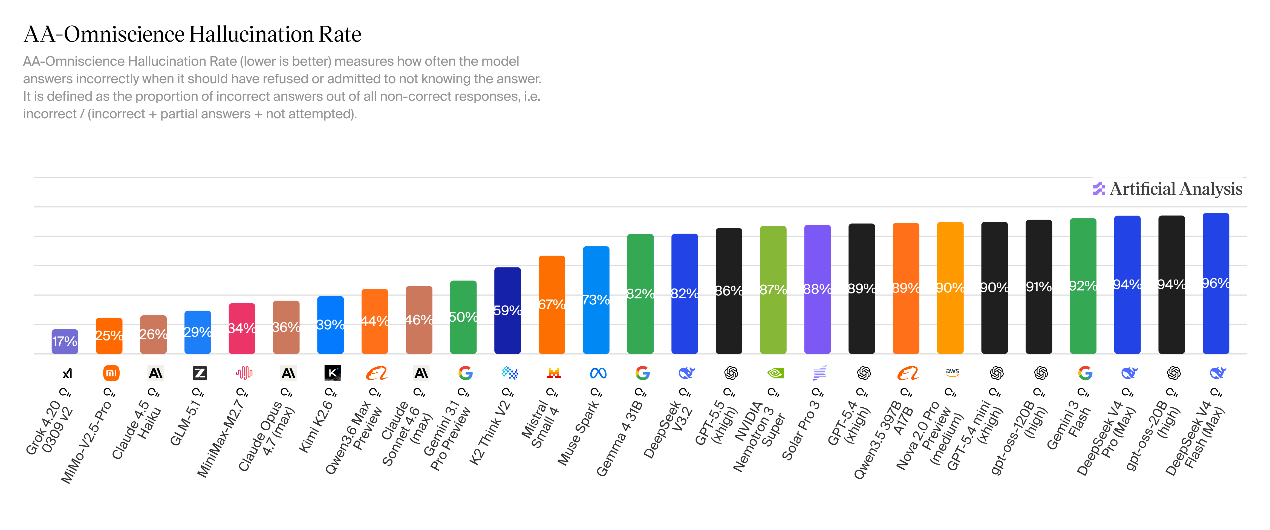

La réserve de connaissances de DeepSeek-V4 a été améliorée, mais l'incidence des hallucinations a augmenté. V4-Pro a obtenu un score de -10 dans l'indice d'évaluation complet de l'omniscience (AA-Omniscience), 11 points de plus que la version de raisonnement V3.2. Le noyau a bénéficié d’une optimisation significative de la précision des réponses aux connaissances. Le V4-Flash a obtenu un score de -23 et le niveau global était fondamentalement le même que celui de la V3.2.

Comparé au taux d'hallucinations du V3.2 (82%), le problème des hallucinations des deux modèles V4 est important : Le taux d'hallucinations du V4-Pro est de 94 % et le taux d'hallucinations du V4-Flash est de 96 %, ce qui signifie que le modèle générera presque toujours de force des réponses à un problème inconnu. scénarios.

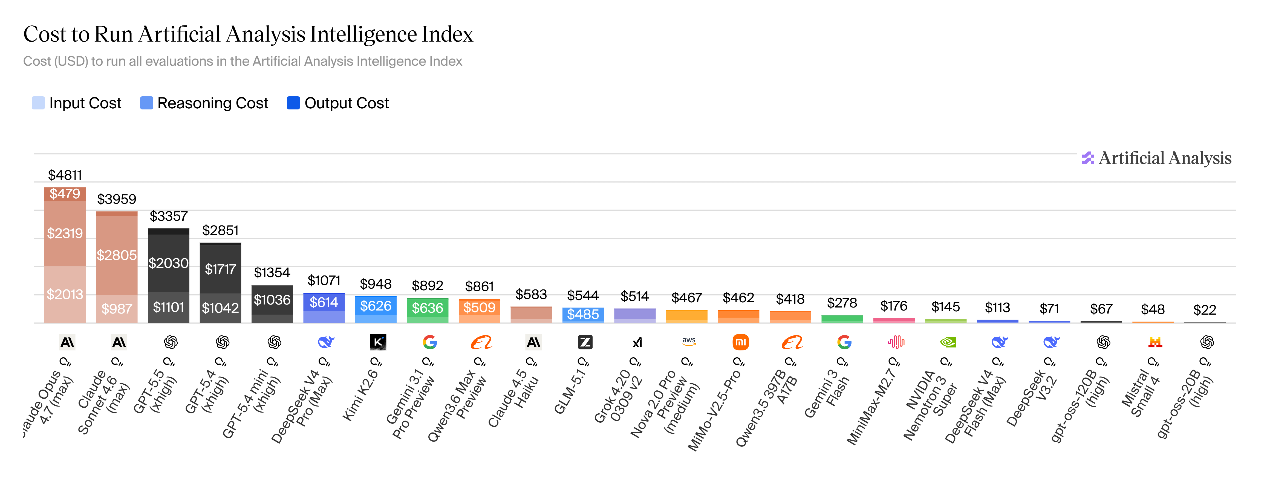

Le coût de fonctionnement de DeepSeek-V4 est inférieur à celui du modèle open source haut de gamme, supérieur à celui du modèle open source grand public, et a considérablement augmenté par rapport à la génération précédente. Après avoir effectué un ensemble complet d'évaluations manuelles de l'indice d'intelligence d'analyse, le coût de fonctionnement de V4-Pro est de 1 071 $ US, soit seulement moins d'un quart de celui de Claude Opus 4.7 (4 811 $ US) ; cependant, il reste élevé par rapport aux modèles open source similaires, supérieur à Kimi K2.6 (948 USD), GLM-5.1 (544 USD), DeepSeek-V3.2 (71 USD) et gpt-oss-120B (67 USD). Le coût de fonctionnement de DeepSeek-V4-Flash n'est que d'environ 113 $ US, ce qui présente un avantage de coût significatif.

Après avoir terminé le processus d'évaluation standard, la consommation de jetons de sortie du V4-Pro a atteint 190 millions, ce qui est l'un des modèles avec la consommation de jetons la plus élevée dans cette évaluation ; La consommation du V4-Flash a encore grimpé à 240 millions de jetons. Même si le prix est bas, la consommation élevée de jetons reste la principale raison pour laquelle le coût d'utilisation global du V4-Pro est plus élevé que celui des autres modèles open source.

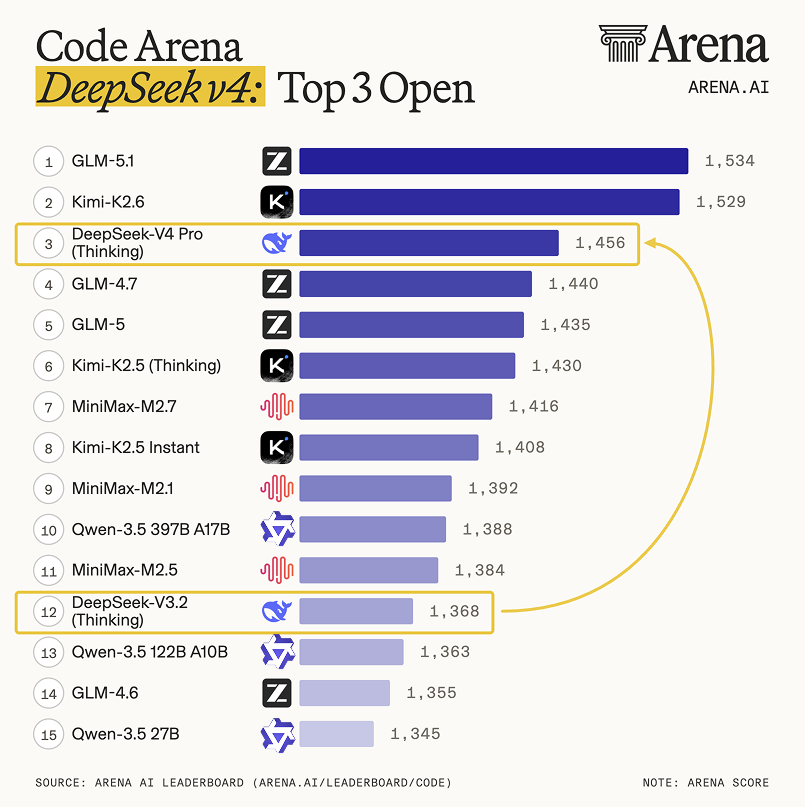

Dans d'autres revues, Large Model Arena Arena.ai décrit DeepSee k-V4-Pro comme "un bond majeur par rapport à DeepSeek-V3.2" , se classant 3ème parmi les modèles open source et 14ème au classement général dans son arène de code. DeepSeek-V4-Pro est au même niveau que GPT-5.4-high et Gemini-3.1-Pro dans les tâches de développement Web d'agent. Dans son arène textuelle, DeepSeek-V4-Pro s'est classé 2e parmi les modèles open source et 14e au classement général, tout comme Kimi-2.6. DeepSeek-V4-Flash se classe 10e parmi les modèles open source et 14e au classement général.

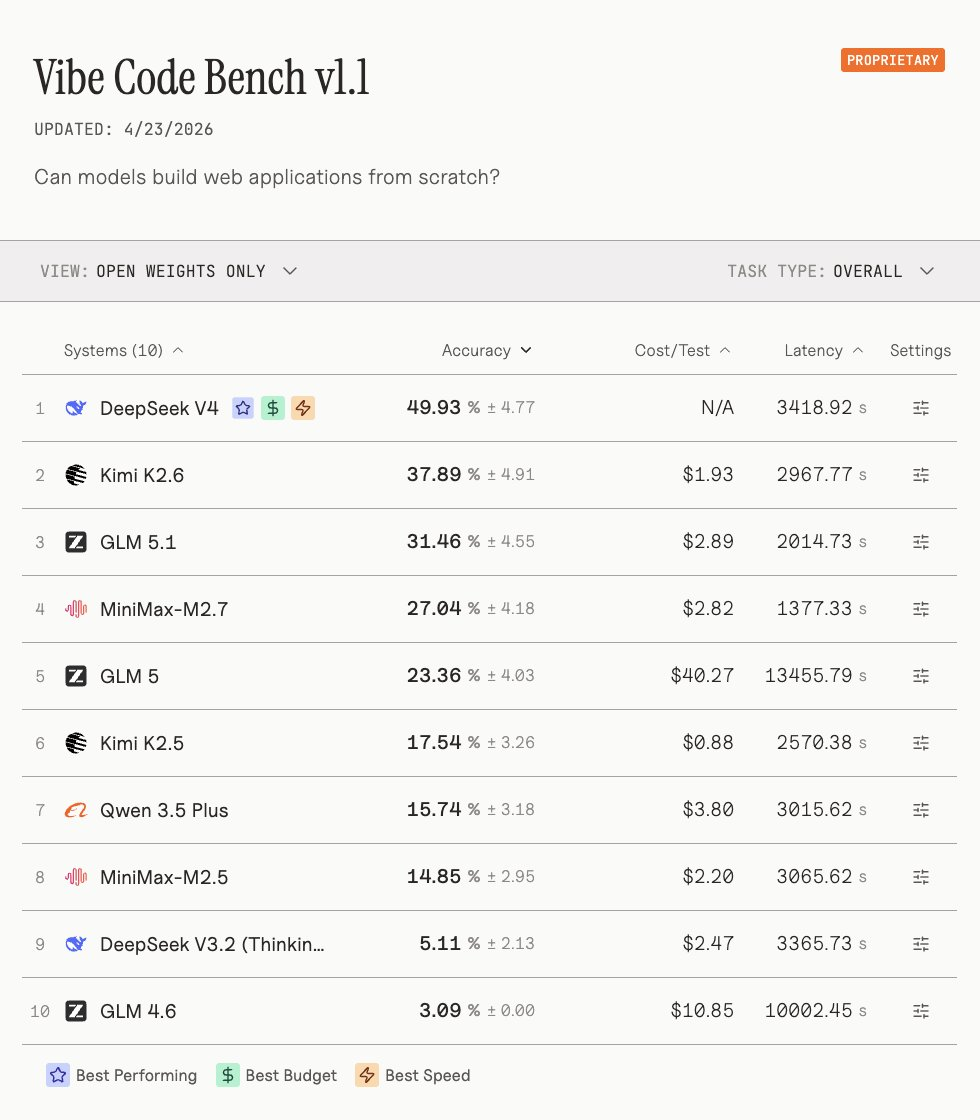

Vals AI, un autre groupe d'évaluation, a déclaré que DeepSeek-V4 avait remporté la première place du modèle de pondération open source avec un « avantage écrasant » dans son Vibe Code Benchmark (référence de code d'atmosphère). La a réalisé des performances multipliées par 10 par rapport à la génération précédente V3.2, battant même des modèles comme Gemini. Meilleurs modèles fermés comme 3.1 Pro. DeepSeek-V4 est également le seul modèle de pondération open source qui dépasse 40 % sur Vibe Code Benchmar.

Par rapport aux capacités de DeepSeek-V4, les pays d'outre-mer accordent plus d'attention à la coopération entre DeepSeek et Huawei.

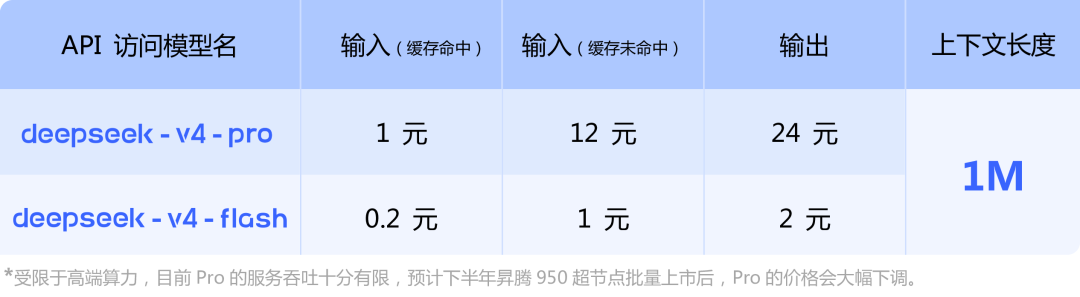

Au bas des informations sur le prix de l'API annoncées par DeepSeek-V4, l'avis officiel soulignait : « Limité par la puissance de calcul haut de gamme, le débit actuel du service Pro est très limité. On s'attend à ce qu'après le lancement massif des super-nœuds Ascend 950 au cours du second semestre, le prix du Pro soit considérablement réduit.

DeepSeek a déclaré dans le rapport technique que la V4 a été lancée sur NVIDIA. La solution EP à granularité fine (parallélisme expert) a été vérifiée sur les plates-formes GPU et Huawei Ascend NPU. Par rapport à la puissante base de référence sans fusion, il peut obtenir un effet d'accélération de 1,50 à 1,73 fois sur les tâches de raisonnement général, et peut atteindre un effet d'accélération de 1,96 fois dans des scénarios sensibles au retard (tels que la déduction RL et les services proxy à grande vitesse).

Après la sortie de la V4, Huawei Ascend a également annoncé simultanément que « toute la gamme de produits super nœuds prend en charge les modèles de la série DeepSeek-V4 ». Il est rapporté qu'Ascend 950 réduit la surcharge de calcul de l'attention et d'accès à la mémoire en intégrant la technologie parallèle du noyau et multi-flux, améliorant considérablement les performances d'inférence et combinant plusieurs algorithmes de quantification pour obtenir un déploiement d'inférence de modèle DeepSeek-V4 à haut débit et à faible latence.

Concernant la coopération de DeepSeek avec Huawei, He Hui, directeur de la recherche sur les semi-conducteurs chez Omdia, une organisation d'études de marché, a déclaré : « Cela revêt une grande importance pour l'industrie chinoise de l'intelligence artificielle. »

Il a ajouté : "La puce Ascend de Huawei est la puce auto-développée par la Chine. Le produit le plus élevé qui puisse remplacer Nvidia. Le grand modèle DeepSeek-V4 est adapté pour être équipé de puces Huawei, ce qui indique que le plus grand modèle chinois peut désormais implémenter du matériel localisé.

Christopher, analyste de Goldman Sachs. Moniz a commenté qu'après la sortie de la version préliminaire de DeepSeek-V4, les secteurs des GPU et des puces nationales ont été renforcés. L'une des principales préoccupations est l'architecture de puce sous-jacente qui prend en charge le modèle V4 : y compris les puces utilisées pour la formation du modèle et les dispositifs matériels utilisés dans la phase d'inférence. Le cluster informatique d'intelligence artificielle de nouvelle génération de Huawei équipé du processeur Ascend AI peut être adapté pour exécuter le modèle DeepSeek-V4. Cela signifie également que l'écosystème matériel d'IA développé par la Chine fournit une prise en charge continue de la puissance de calcul de DeepSeek. itération de grands modèles de pointe

Ce changement dans la voie technologique de DeepSeek confirme également les préoccupations précédentes du PDG de Nvidia, Jen-Hsun Huang : Nvidia risque de perdre l’écosystème des développeurs chinois.

Plus tôt ce mois-ci, le fondateur de NVIDIA, Huang Jensen, acceptait Dwarkesh. Dans une interview exclusive, Patel a déclaré un jour : « Si DeepSeek est d'abord publié sur la plate-forme Huawei, ce sera catastrophique pour les États-Unis. » Selon Huang Renxun, bien que DeepSeek soit un modèle open source et puisse également être utilisé sur les produits NVIDIA, si DeepSeek est spécifiquement optimisé pour la puissance de calcul de Huawei, NVIDIA sera désavantagé en raison de limitations telles que les restrictions sur l'achat de puissance de calcul haut de gamme.

Contrairement à DeepSeek-R1, DeepSeek-V4 n'a pas déclenché une forte baisse des valeurs technologiques américaines. Ivan Su, analyste principal des actions chez Morningstar, a déclaré que DeepSeek-V4 est difficile à reproduire l'influence originale sur le marché du modèle d'inférence R1 parce que le marché commercial a déjà pleinement digéré les attentes : la technologie d'intelligence artificielle chinoise est compétitive et a des coûts d'utilisation inférieurs.

Ivan Su a également déclaré que le nouveau positionnement du produit de DeepSeek a directement classé d'autres grands modèles open source nationaux dans les rangs des produits concurrents.

Kyle Chan, chercheur à la Brookings Institution, a déclaré que DeepSeek-V4 est impressionnant car il s'agit d'un modèle proche de l'état de l'art avec une longueur de contexte efficace d'un million de jetons et peut fonctionner sur les nouvelles puces de Huawei. DeepSeek-V4 n'a pas reproduit le « moment DeepSeek-R1 » car les attentes du monde extérieur à l'égard des capacités d'IA de la Chine sont beaucoup plus élevées qu'auparavant.