DeepSeek V4 vient d'être lancé. Certaines personnes dans les médias étrangers voient les performances, d’autres le prix et d’autres encore Huawei. Bloomberg l'a écrit comme un défi puissant pour OpenAI et Anthropic, et Fortune s'est concentré sur le fait qu'il atteigne une fois de plus le prix près du plancher ; La coupe de Reuters était plus sensible : il ne s'agit pas seulement d'un nouveau modèle moins cher et meilleur pour les textes longs, mais DeepSeek a clairement révélé pour la première fois que la série V4 a été adaptée à la puce Ascend de Huawei. Bien entendu, Reuters n'a pas oublié de rattraper ce retard, affirmant que le V4 est toujours à la traîne par rapport à certains des meilleurs modèles à code source fermé et ne prend pas en charge la multimodalité pour le moment.

Mais les deux mots « Huawei » ont amené toute la discussion à un autre niveau. V4 a déclenché non seulement la discussion sur « si le modèle est fort ou non », mais aussi sur « qui va-t-il mettre dans le pétrin ». Le PDG de Nvidia, Jen-Hsun Huang, a fait une déclaration sévère dans un podcast ce mois-ci : "Si DeepSeek est d'abord publié sur la plate-forme Huawei, ce sera catastrophique pour les États-Unis." Avec le recul, cette phrase semblait presque préparer le terrain pour l'opinion publique de V4.

Donc le plus intéressant à propos de DeepSeek V4 cette fois-ci n'est pas qu'il ait quelques points de fonctionnement supplémentaires, mais que dès sa mise en ligne, les médias américains ont montré deux émotions à la fois. Tout en admettant que les entreprises chinoises continuent d’adopter des prix plus bas et une ingénierie plus efficace, elles sont réticentes à admettre que le mur construit par la Silicon Valley, basé sur les puces, le capital et l’écologie fermée, a commencé à se desserrer.

1. Rentabilité ultime : briser le fossé concurrentiel dans la Silicon Valley

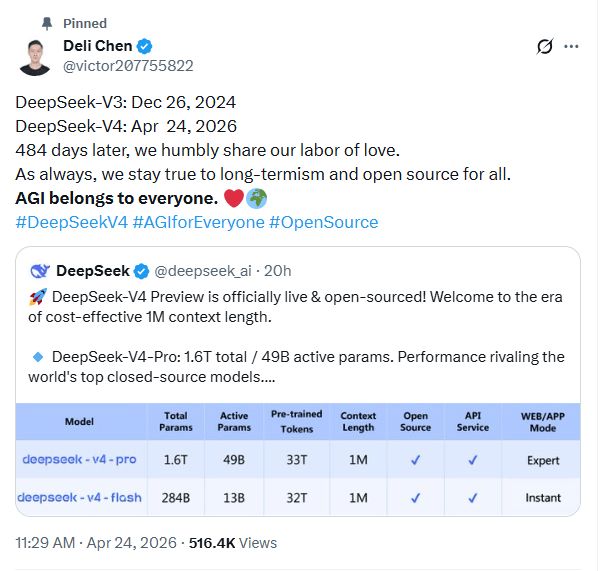

Le 24 avril, la version préliminaire de DeepSeek V4 a été officiellement publiée et open source simultanément, lançant deux gammes de produits : la version phare V4-Pro et la version légère V4-Flash. Les deux modèles prennent en charge nativement 1 million de contextes de jetons. V4-Pro se concentre sur le renforcement des capacités des agents et a atteint le niveau leader des modèles open source dans de nombreuses évaluations telles que le codage agent, les mathématiques, les STEM, la programmation de compétition et la connaissance du monde, et certaines capacités sont proches des meilleurs modèles fermés. V4-Flash accorde plus d'attention aux performances à faible coût et à coût élevé, et convient aux appels quotidiens à haute fréquence. En termes de prix, l'entrée du V4-Pro (accès au cache) est de 1 yuan par million de jetons et la sortie est de 24 yuans par million de jetons ; l'entrée V4-Flash (accès au cache) n'est que de 0,2 yuans par million de jetons et la sortie est de 2 yuans par million de jetons.

Par rapport à la génération précédente, la plus grande avancée de la V4 n'est pas simplement les paramètres de tas, mais l'innovation de mécanismes d'attention hybrides tels que CSA (Compressed Sparse Attention) et HCA (Heavy Compressed Attention), qui réduisent considérablement les coûts de calcul et de mémoire des contextes longs, transformant « 1 million de contextes » d'un paramètre d'affichage en une norme véritablement utilisable. Dans l'ensemble, la V4 poursuit le style de produit « bon marché et puissant » et constitue une mise à niveau au niveau de l'infrastructure pour les agents à longue portée et les applications à contexte long à grande échelle.

À cet égard, « Bloomberg » estime que DeepSeek V4 est actuellement la plate-forme open source la plus puissante et un puissant défi pour OpenAI et Anthropic. La sortie du nouveau modèle amène les entreprises technologiques mondiales et les investisseurs à réexaminer l’opportunité d’investir des milliards de dollars dans l’intelligence artificielle.

CNBC a décrit la sortie de la V4 comme une « démonstration complète de force ». Le rapport souligne que même si l'impact du V4 sur le marché n'est peut-être pas aussi perturbateur que celui du R1, car le marché a anticipé la concurrence à bas prix de l'IA chinoise, il met directement les concurrents américains sous une forte pression.

"Fortune" se concentre sur le "prix plancher" de la V4. L'article souligne que le prix de V4-Pro ne représente qu'un sixième à un dixième de celui des services similaires d'OpenAI ou d'Anthropic. Cet avantage extrêmement rentable pourrait briser complètement le fossé concurrentiel des principaux laboratoires américains.

La raison pour laquelle le prix peut baisser n’est pas seulement due à une stratégie commerciale radicale. Le secret principal réside dans la reconstruction perturbatrice par DeepSeek de l'architecture sous-jacente du modèle.

2. « L'élégance technique » : utiliser l'efficacité des algorithmes pour lutter contre la puissance de calcul violente

VentureBeat s'est émerveillé devant la « densité intelligente » du V4, le qualifiant de « baleine géante retournant sur le champ de bataille ». L'article analyse en détail le mécanisme d'attention hybride et l'hyperconnexion à contraintes multiples (mHC) qu'il introduit, et estime que ces innovations réduisent considérablement les besoins en mémoire et les coûts de calcul sans sacrifier les performances.

Cependant, VentureBeat a également souligné objectivement que la V4 présente encore des limites, telles que le fait de ne pas prendre en charge autant de fonctionnalités modales que les images et les vidéos.

Al Jazeera a mentionné que V4-Pro a vaincu tous les modèles open source en termes de mathématiques et de capacités de codage, et qu'il est actuellement en retard sur le modèle fermé de Google Gemini 3.1 Pro dans seulement quelques domaines tels que la « connaissance du monde ». La plateforme open source Hugging Face salue officiellement le retour de cette « baleine géante » et estime que « l'ère rentable des millions de longs textes » est officiellement arrivée.

Reuters a cité Lewis Tunstall, ingénieur en apprentissage automatique chez Hugging Face, confirmant que la V4 est le modèle le plus rapide de la plate-forme à atteindre le haut de la liste, avec des performances excellentes et bon marché lors du traitement de tâches de texte longues et complexes.

Mais l'efficacité ultime s'accompagne aussi d'une "partialité" évidente.

Tunstall et d'autres experts ont souligné que la V4 est toujours un pur modèle de texte et qu'elle est complètement absente des pistes traditionnelles telles que la compréhension d'images et la génération de vidéos. Cela limite son imagination dans l’industrie créative aujourd’hui où la multimodalité est devenue la norme. En outre, les responsables de DeepSeek ont également admis que la V4 est toujours en retard par rapport à Gemini 3.1 Pro en termes de réserves de « connaissances mondiales », ce qui signifie qu'il est encore difficile pour la V4 de se débarrasser complètement du problème des « illusions » lorsqu'il s'agit de dynamiques mondiales très sensibles au temps ou de contextes culturels complexes.

3. « IA souveraine » : percée matérielle sous le jeu des grandes puissances

Alors, quel type de puce DeepSeek a-t-il utilisé pour développer la V4 ?

Reuters et le New York Times ont mentionné que DeepSeek utilisait des puces Nvidia au début de la recherche et du développement, telles que le H800 ou la version conforme selon les rumeurs, H20, mais avec le cycle V4, la situation a radicalement changé. DeepSeek a clairement indiqué que la V4 effectuait une vérification parallèle du GPU Nvidia et du NPU Huawei Ascend pendant le processus de développement. Sur la base des analyses des médias sociaux et de l'industrie, la V4 a grandement bénéficié d'une collaboration approfondie avec les derniers clusters informatiques de Huawei tels que Ascend SuperPoD, en particulier la prise en charge native de technologies de pointe telles que l'inférence de basse précision FP4, qui a considérablement amélioré le rapport d'efficacité énergétique de la V4 sur les puces domestiques.

Cela signifie que le modèle d'IA a commencé à être optimisé nativement autour du matériel local chinois. Reuters est parfaitement conscient de l'importance stratégique du passage de DeepSeek aux puces Huawei et estime qu'il s'agit d'un travail représentatif de la promotion par la Chine de l'innovation indépendante. Cela ne fait que confirmer les inquiétudes de Huang Renxun. Il a récemment admis dans un podcast : "Nous devons admettre que la plupart des progrès en matière d'IA proviennent d'algorithmes plutôt que de matériel brut, et DeepSeek n'est en aucun cas un progrès insignifiant. Si DeepSeek est d'abord publié sur la plateforme Huawei, ce sera catastrophique pour notre pays."

Le New York Times estime que V4 étend encore davantage l'influence de la Chine dans le domaine de l'IA open source, affirmant que « l'open source est la puissance douce de la technologie future ». L’article mentionne que la technologie DeepSeek est adoptée par les développeurs du monde entier, de Kuala Lumpur à Lagos, aidant ainsi la technologie chinoise à contourner les blocus matériels américains.

Channel News Asia estime que l'arrivée de la V4 est un "point d'inflexion" en termes de matériel et de coût. Grâce à une collaboration approfondie avec les puces Ascend de Huawei, la Chine atteint « l’autosuffisance » des algorithmes au matériel, ce qui constitue une étape importante pour l’indépendance de l’industrie chinoise de l’IA.

4. « Expérience réelle » des développeurs mondiaux : il existe de vrais parfums, mais il y a aussi des doutes

Le jeu au niveau macro est en effet mouvementé, mais pour les développeurs qui écrivent du code et ajustent les API chaque jour, les seuls critères de jugement sont de savoir s'il est facile à utiliser et s'il est stable ou non. Sur les plateformes sociales telles que Reddit et X, « l’expérience réelle » des développeurs mondiaux a poussé cette discussion à un point d’ébullition.

Après la sortie de la V4, Reddit et X sont instantanément devenus à l'avant-garde du démantèlement technologique et de l'industrie du jeu.

Sur Reddit, les développeurs se sont concentrés sur la stabilité des textes longs.

L'utilisateur senior a9udn9u a déclaré sans ambages que la capacité de la V4 à gérer des textes longs est "absolument insensée", et qu'elle fournit une aide considérable pour comprendre de très grandes bases de code. L'utilisateur de

Comfort-Rock-498 ressent également la même chose. Il a délibérément poussé le test dans un contexte ultra-long et a constaté que V4-Flash atteignait en réalité « zéro erreur ».

SignalCompetitive582 a souligné que le plus grand changement apporté par la V4 est de changer le fonctionnement de LLM de « limité par la mémoire vidéo » à « limité par la puissance de calcul ». Cela signifie qu'à l'avenir, les outils de programmation d'IA pourront proposer des limites d'abonnement plus généreuses et des « prix tout compris » pour rendre l'automatisation commerciale à grande échelle tout à fait réalisable sur le plan économique.

InterstellarReddit a décrit DeepSeek comme « une odeur de sang dans l'eau et une frappe immédiate » (une odeur de sang dans l'eau et une frappe immédiate), estimant que son extrême rentabilité frappera à nouveau le marché américain de l'IA.

a également une voix calme. Des utilisateurs comme CallMePyro ont objectivement souligné qu'il existe encore un écart entre V4-Pro et Claude 4.7 en termes de qualité globale, mais il est recommandé à tout le monde d'essayer au moins V4-Flash et de le comparer avec Google Gemini 3 Flash.

Sur la plateforme X, les discussions ont atteint le niveau de l'innovation architecturale, de la puissance technologique et même de la vision.

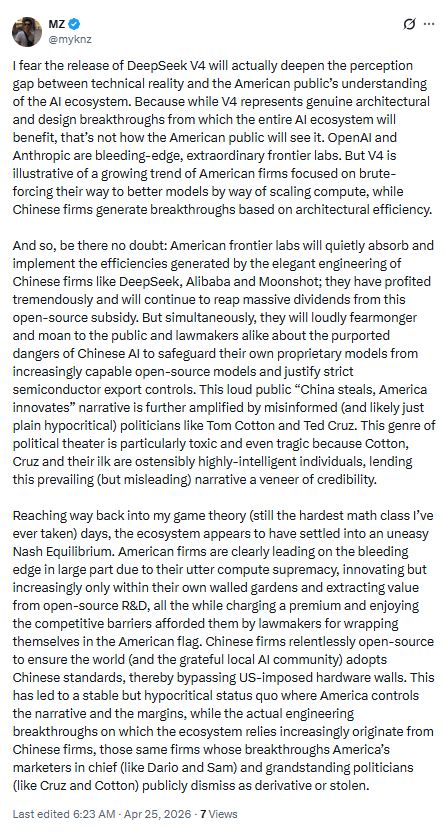

L'expert technique MZ (@myknz) a publié un long article soulignant que les laboratoires américains tels qu'OpenAI et Anthropic préfèrent actuellement améliorer les performances des modèles par le biais du "brute-forcing" (Brute-forcing), tandis que DeepSeek représente une voie pour réaliser des percées grâce à "l'efficacité architecturale" (Efficacité architecturale). Il a clairement souligné que les laboratoires américains « absorbent discrètement » les solutions d'ingénierie apportées par des sociétés chinoises telles que DeepSeek, Alibaba et Dark Side of the Moon, mais qu'ils diffusent en public le récit du « vol chinois » pour protéger leurs propres modèles fermés.

MZ a en outre analysé que l'écosystème mondial de l'IA se trouve dans un « équilibre de Nash » hypocrite, dans lequel les États-Unis contrôlent le récit et les marges bénéficiaires élevées, et utilisent les résultats de R&D open source ; tandis que les entreprises chinoises veillent à ce que les développeurs mondiaux adoptent les normes chinoises en continuant l’open source, contournant ainsi le blocus matériel américain.

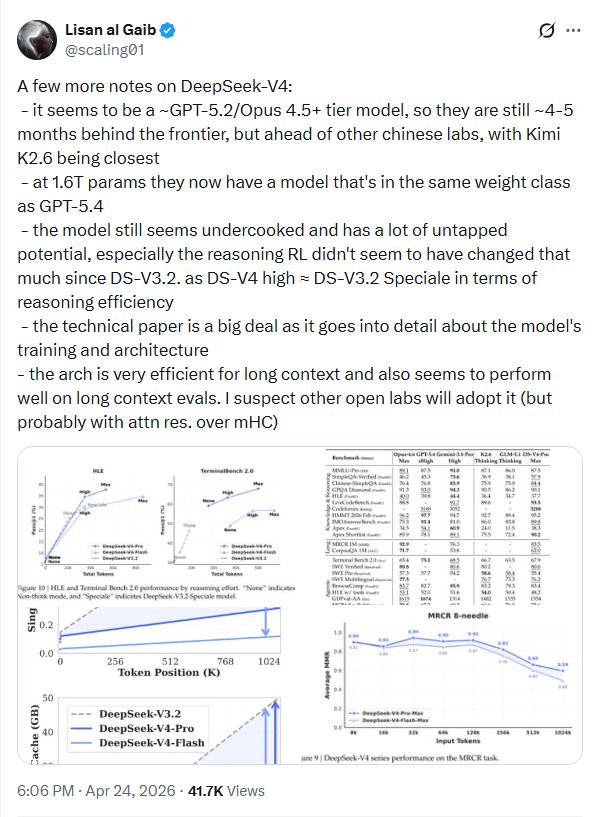

La blogueuse bien connue Lisan al Gaib estime que la V4 est actuellement au niveau de GPT-5.2 ou Opus 4.5+. Bien qu'il soit en retard d'environ 4 à 5 mois sur les principaux modèles à source fermée, il est en avance sur les autres modèles d'IA chinois, suivis par Kimi K2.6. À une échelle de 1 600 milliards de paramètres, le V4 est déjà aussi lourd que le GPT-5.4. Il a également mentionné que des documents techniques pertinents présentaient en détail la formation et l'architecture technique du modèle, et a émis l'hypothèse que d'autres laboratoires open source adopteraient cette architecture qui fonctionne bien dans des contextes longs.

Bien sûr, il existe également de nombreuses observations calmes.

L'ingénieur en IA Daniel Dewhurst rappelle à tout le monde d'être prudent à l'égard du benchmark officiel, estimant qu'en l'absence d'évaluation indépendante, ces superbes données peuvent être optimisées pour l'ensemble de tests. Lisan al Gaib a même déclaré sans détour que la V4 semble toujours "pas assez cuite" et qu'il n'y a pas de saut essentiel dans la logique de raisonnement par rapport à la V3.2.

Certains utilisateurs ont également mentionné que DeepSeek V4 fonctionne actuellement très mal dans les tâches juridiques.

Sage Aurélius rappelle de ne pas se laisser emporter par l'engouement pour le "pur open source". Il estime que l'adoption par DeepSeek du protocole MIT est une stratégie commerciale intelligente, qui consiste à s'emparer de l'esprit et des données des développeurs en publiant des modèles puissants, puis à réaliser des bénéfices élevés grâce aux services d'hébergement. Il s’agit du modèle classique « core open source » (Open-core).

Chen Deli, chercheur chez DeepSeek, a qualifié la V4 de « travail acharné » sur X et a réitéré la vision de l'entreprise : « AGI appartient à tout le monde. "

5. Conclusion : la véritable innovation n'a pas peur des murs

DeepSeek Les débuts du V4 soulignent directement la logique « d'hégémonie de la puissance de calcul » que la Silicon Valley a construite depuis plus de dix ans.

Il indique au monde que sur la route de l'avenir, l'empilement violent de la puissance de calcul n'est pas la seule réponse, et que l'efficacité architecturale peut également donner des résultats étonnants. Alors que les développeurs du monde entier applaudissent à la stabilité et au faible prix du V4, nous assistons non seulement à la montée en puissance d’une marque chinoise d’IA, mais également à un remaniement discret de la structure du pouvoir technologique mondial.

La « baleine géante des profondeurs » a fait surface. Si l'avenir d'AGI est destiné à appartenir à tout le monde, alors ce jeu consistant à briser les blocus, à briser les prix et à remodeler l'efficacité vient d'entrer dans la seconde moitié.