Les prix de la mémoire ont augmenté de 3 à 5 fois cette année, ce qui a sérieusement affecté la volonté de chacun de consommer des PC et des téléphones portables. La forte demande en IA est responsable de cette énorme augmentation des prix des mémoires. Tout le monde sait que l'IA a des exigences très élevées en matière de capacité et de bande passante de la mémoire (y compris la mémoire vidéo sur les GPU), mais jusqu'où peuvent-elles être ? Le TPU de huitième génération lancé par Google il y a quelques jours en est le meilleur exemple.

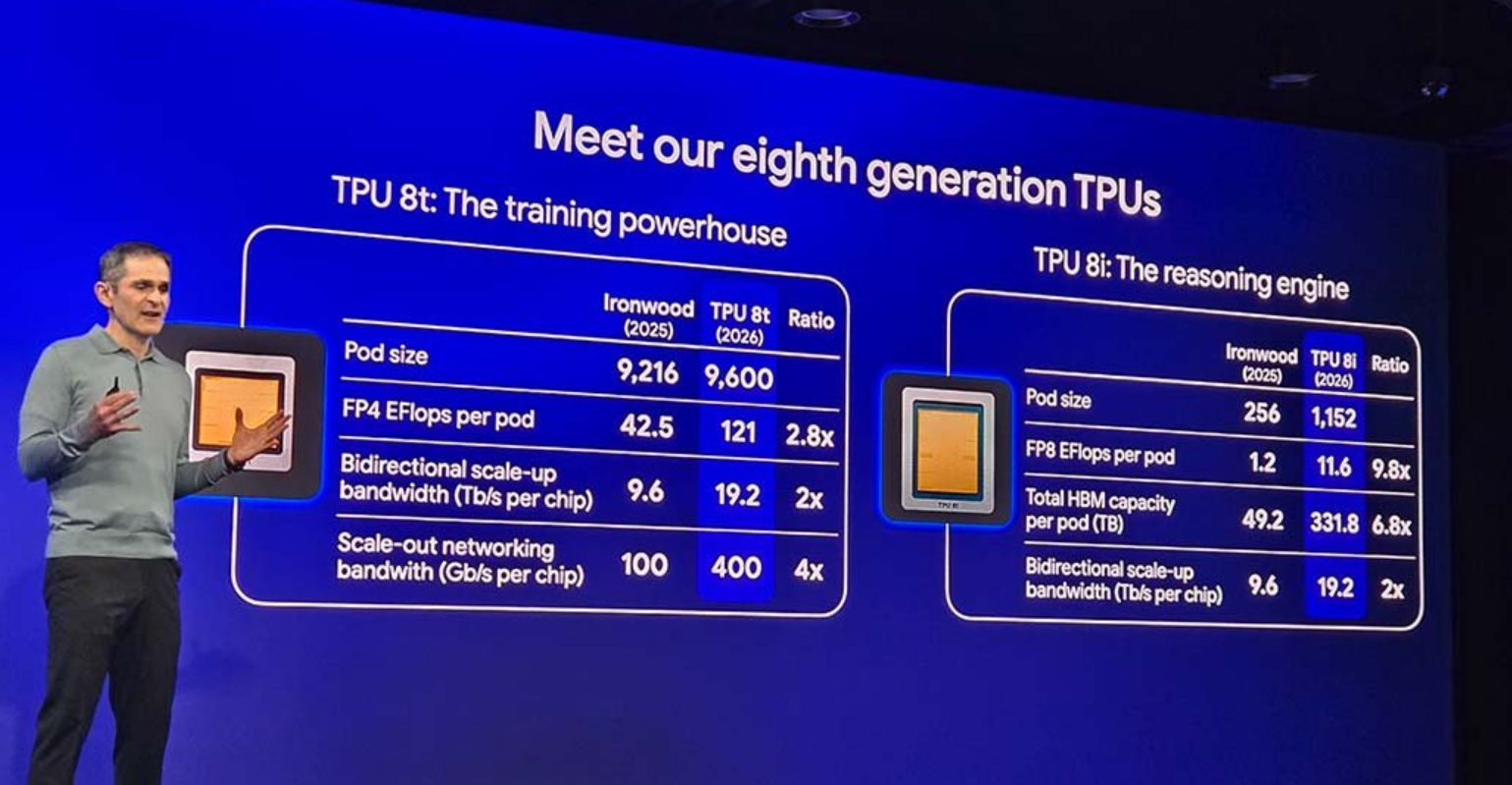

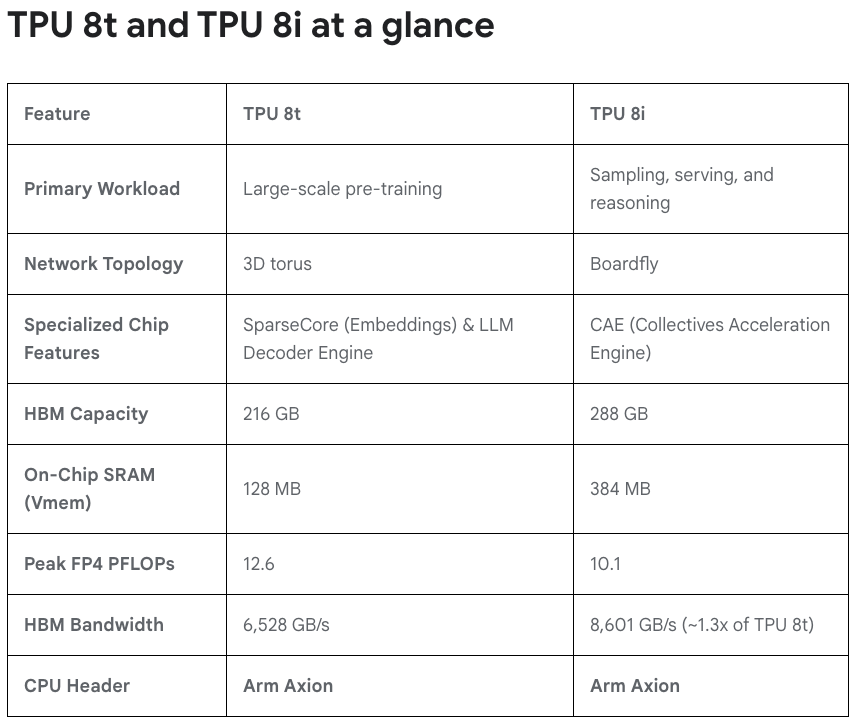

Le TPU v8 de cette année fait pour la première fois la différence entre l'entraînement et le raisonnement. V8T se concentre sur la formation en IA. Bien que Google affirme pouvoir également raisonner, il est principalement utilisé pour la formation.Chaque nœud Pod est empilé avec 9 600 puces V8T et les performances FP4 atteignent 121EFlops., la bande passante mémoire est de 19,2 To/s et la bande passante interne de la puce est de 400 Go/s, ce qui représente un changement presque de 2 à 4 fois.

Le V8i est principalement destiné aux charges d'inférence d'IA, et les spécifications doivent être considérablement réduites. Chaque nœud ne dispose que de 1 152 puces V8i, la puissance de calcul est réduite à 11,6EFlops et la bande passante mémoire reste inchangée à 19,2 To/s.

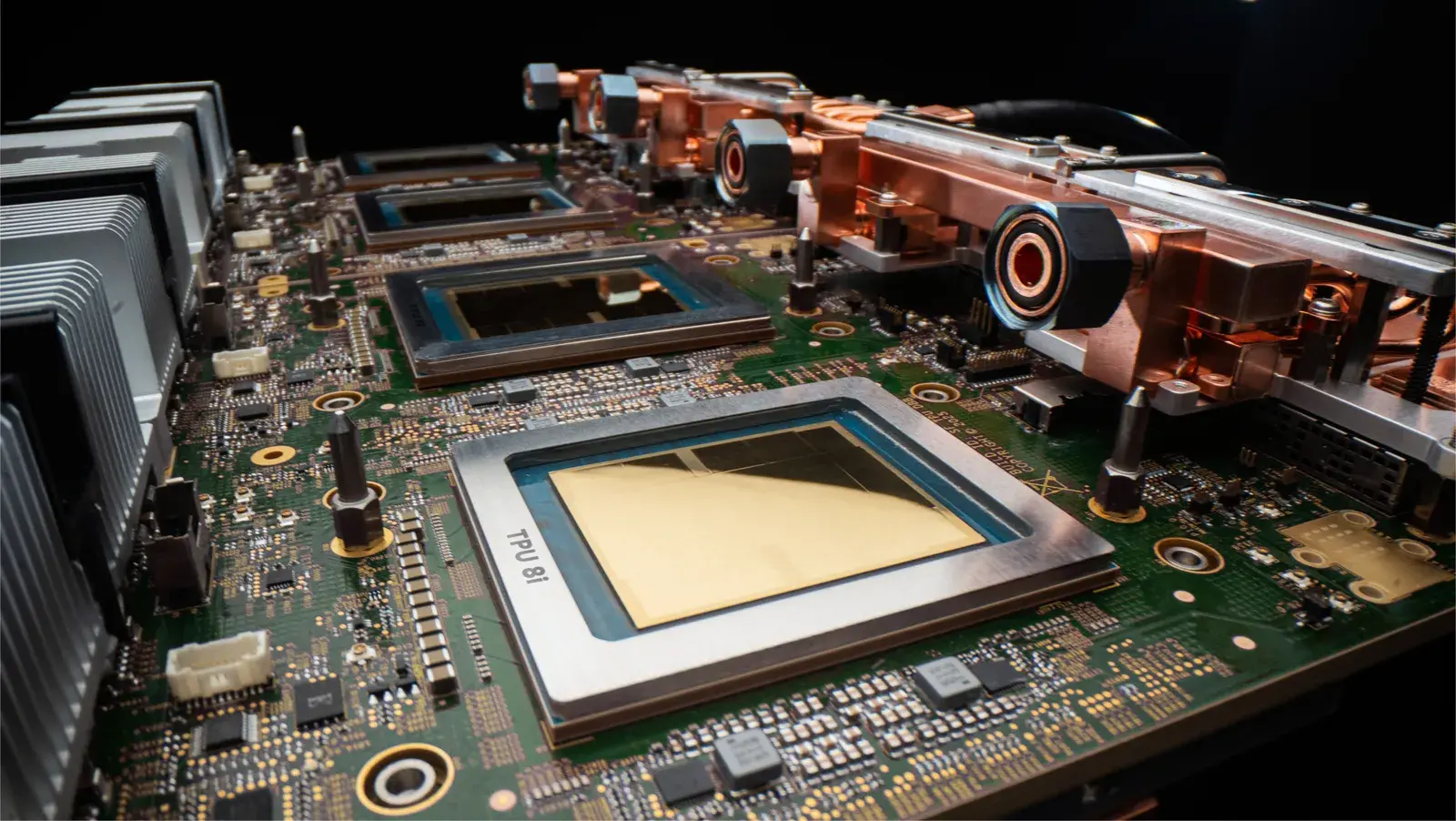

Il convient de noter que cette fois, la capacité de la mémoire a considérablement augmenté.Le V8i atteint également 331,8 To de mémoire HBM et le V8T dispose d'une mémoire HBM exagérée de 2 Po. Chaque puce V8T est équipée de 216 Go de mémoire HBM.

Le concept de conception de Google cette fois est de briser le mur de mémoire des goulots d'étranglement de l'IA. Le HBM 2PB n'est pas seulement une très grande capacité totale, mais est également utilisé comme adresse globale unique au sein d'un nœud. Bien que le GPU de NVIDIA ait déjà pu empiler de la mémoire HBM de niveau PB grâce à des technologies telles que NVLink, la connexion ne peut pas contourner le réseau traditionnel du centre de données, ce qui entraînera des goulots d'étranglement en termes de performances et de latence.

Larry Carvalho, consultant en chef chez RobustCloud, a déclaré que briser le « mur de la mémoire » marque un changement de compétitivité potentiellement majeur pour Google dans le domaine des puces IA.

Mais pour les gens ordinaires, le lancement par Google d’une mémoire HBM de 2 Po n’est pas un bon signe, car cela signifie que la demande de mémoire de l’IA continue d’augmenter.Vous devez savoir que la mémoire HBM consomme généralement 2 à 4 fois plus de capacité de production de puces DRAM que la mémoire DDR conventionnelle.Plus HBM est utilisé, plus la capacité mémoire DDR est occupée.

Même si la demande augmente, Samsung, SK Hynix, Micron et d'autres sociétés donneront la priorité à la demande de HBM, mais elles ont déjà clairement indiqué qu'elles n'augmenteraient pas de manière significative la capacité de production de puces. De toute évidence, la pénurie de puces mémoire va s’aggraver et on ne peut pas s’attendre à ce que les prix baissent rapidement.