Chen Boyuan, chercheur à OpenAI, a publié un article sur Zhihu, qui commence très directement :"Bonjour à tous, je suis Chen Boyuan, chercheur scientifique au sein de l'équipe GPT Image. Le modèle de génération d'images GPT publié la semaine dernière était ma formation principale !"Il a également mentionné que le rendu chinois du modèle avait finalement été corrigé cette fois-ci. Si les utilisateurs chinois ont des commentaires, vous pouvez y répondre directement.

Après la sortie de ChatGPT Images 2.0, la première réaction de nombreuses personnes a été :La capacité chinoise de ce modèle est un peu déraisonnable.

Dans le passé, les modèles d'images étaient quelque peu « incompréhensibles ». Ils peuvent dessiner des paysages et des personnages, mais une fois les caractères chinois impliqués, ils peuvent facilement se transformer en un fouillis indéchiffrable de symboles fantomatiques. Mais GPT-image-2 est différent. Il peut non seulement écrire les mots corrects, mais également composer, segmenter et générer des graphiques d'informations chinois avec une structure logique.

L'ancienne méthode consistant à « examiner le texte pour déterminer s'il a été généré par l'IA » ne fonctionne plus dans cette génération.

Chen Boyuan est l'une des personnes qui se sont vraiment tenues à la réception lors de la formation et de la démonstration de capacités GPT Image 2. Lors de la conférence de presse, lui et Ultraman ont démontré les capacités de rendu de texte. Après la publication, il a expliqué de nombreuses informations derrière les images du site officiel sur Zhihu : lors du test en double aveugle de LMArena, GPT Image 2 a utilisé « duct-tape » comme nom de code ; de nombreuses photos sur le blog du site officiel ont été réalisées par lui avec des modèles ; Bandes dessinées chinoises, gravures de grains de riz, textes multilingues, preuves visuelles et codes QR générés automatiquement. Ces images qui ressemblent à du matériel promotionnel sont en réalité conçues pour tester les capacités encore et encore.

Il a utilisé une explication très intéressante pour ce ruban adhésif :

"Quant à la raison pour laquelle on l'appelle du ruban adhésif... bien sûr, c'est parce que vous pouvez utiliser du ruban adhésif pour coller des bananes sur le mur !"

01

Il pose une question plus lente

Chen Boyuan n'est pas le genre de chercheur dont on se souvient d'un coup d'œil. Il n’y a pas de prise de parole en public fréquente ni de gestion délibérée de l’expression personnelle. Il écrit des blogs et publie du contenu léger, mais ceux-ci ressemblent plus à des records qu'à un renforcement de l'influence.

En revanche, sa présence vient davantage du modèle lui-même.

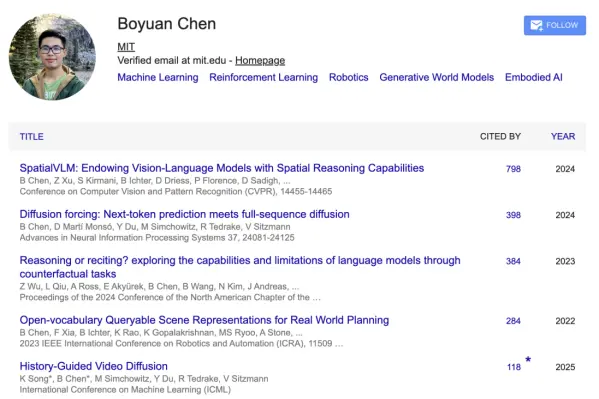

Il est maintenant chercheur à OpenAI, impliqué dans la formation de modèles d'images. Avant cela, il a obtenu un doctorat en génie électrique et en informatique au MIT avec une mineure en philosophie. Il a également participé à la recherche de modèles multimodaux chez Google DeepMind.

Ces expériences sont suffisamment accrocheuses, mais ce qui est plus important, ce sont ses préoccupations à long terme.

De DeepMind à OpenAI, l’orientation des recherches de Chen Boyuan n’a pratiquement pas changé. Alors que la plupart des gens se demandent encore si le modèle peut être mieux écrit et dessiné de plus près, ils s'inquiètent d'un niveau plus fondamental : ce que le modèle « comprend ».

Plus précisément, cela peut être vu comme trois questions : Comment le modèle comprend-il l’image ? Quelle est la relation entre l’image et le langage ? Lorsqu’un modèle fait face au monde réel, génère-t-il des résultats ou simule-t-il le monde ?

Ces questions semblent abstraites, mais elles définissent assez bien les limites de la génération actuelle de modèles.

Sur sa page d'accueil personnelle, il écrit très directement sur son orientation de recherche :Modèles du monde, intelligence incarnée et apprentissage par renforcement.

Le soi-disant modèle mondial peut être compris comme une seule chose : permettre à l’IA de former un jugement sur le monde en interne.

Il doit non seulement savoir ce qui se passe devant vous, mais aussi être capable de prédire ce qui va se passer ensuite.

C'est un peu différent du LLM (grand modèle de langage) courant d'aujourd'hui. Le LLM s'apparente davantage à un langage de traitement, tandis que le modèle du monde est plus proche d'une structure : il doit comprendre l'espace, le temps, les causes et les effets, ainsi que les résultats du comportement.

Pour prendre un exemple très simple, si l’IA « comprend » vraiment le monde, elle devrait savoir qu’un gobelet en plastique rebondira lorsqu’il tombera sur le sol, tandis qu’un gobelet en verre se brisera.

L'intelligence incarnée et l'apprentissage par renforcement peuvent être compris comme une extension de ce problème : si un modèle comprend réellement le monde, il ne doit pas seulement répondre aux questions, mais doit également être capable d'agir et de réviser constamment son jugement au cours de l'action.

Le travail dans lequel il participe n'est souvent pas une optimisation de tâche unique, mais une tentative de relier les modèles génératifs, la compréhension visuelle et les systèmes de prise de décision.

L’un de ses travaux les plus représentatifs est une étude intitulée Diffusion Forcing.

Cette recherche tente de résoudre une question très fondamentale : le modèle est-il généré étape par étape, ou est-il généré d’un seul coup ?

LLM est le premier, qui est bon en génération flexible, mais sujet aux erreurs dans les contenus longs ; le modèle de diffusion est plus proche de ce dernier, plus stable mais peu structuré.

L'approche de Chen Boyuan consiste à mettre ces deux méthodes dans le même modèle, afin que le modèle puisse être généré progressivement et contraindre l'ensemble.

Si le Diffusion Forcing vise à unifier dans la dimension temporelle, alors SpatialVLM, un autre travail auquel il a participé, vise à compléter les capacités dans la dimension spatiale.

Ce travail aborde un problème de longue date : bien que le modèle puisse regarder des images et parler, il ne comprend pas vraiment les relations spatiales. Il ne connaît pas la distance, la taille ou la position relative des objets.

Afin de résoudre ce problème, son équipe a construit un système de raisonnement spatial tridimensionnel afin que le modèle puisse non seulement « voir » mais aussi « raisonner ».

Des idées similaires sont également apparues dans d’autres travaux, comme la méthode History-Guided qui utilise des informations historiques pour guider la génération, ou des recherches sur une modélisation unifiée de la vision, de l’action et du langage. Ces efforts peuvent sembler dispersés, mais ils vont tous dans la même direction : faire en sorte que le modèle ne se contente pas de produire des résultats, mais forme une représentation stable en interne.

En plus de son orientation sérieuse en matière de recherche, Chen Boyuan révèle aussi occasionnellement un intérêt personnel très vif.

Par exemple, cette fois, il a publié un article sur Zhihu, et par exemple, il a spécifiquement introduit sur sa page d'accueil personnelle que son intérêt était la fabrication du boba, et même son nom sur Zhihu est « MIT Milk Tea Store Manager ».

Il a également écrit un blog pour classer les meilleures écoles d'informatique aux États-Unis. Le critère n’était pas la force de la recherche scientifique mais le thé au lait bulle.

Il a classé Berkeley au premier rang parce que le campus est « presque entouré de magasins de thé au lait de haute qualité », tandis que le MIT a reçu une note faible car « il y a trop peu de magasins de thé au lait à proximité et la qualité est instable ».

Ce type d'expression est très détendu, mais on voit que ses habitudes de recherche sont les suivantes : démonter des problèmes complexes, trouver des dimensions comparables, puis porter des jugements.

Son travail lui-même fait quelque chose de similaire, mais l'objet est remplacé par un modèle.

02

Il a évité la direction la plus facile

Si l’on regarde uniquement le chemin de développement des modèles d’images, la logique du passé est en fait très claire : des données plus volumineuses, une résolution plus élevée et un processus de génération plus stable. La plupart des améliorations se concentrent sur « dessiner plus comme ».

Mais à mesure que le modèle commence à traiter des contenus plus complexes, ce chemin atteint également un goulot d'étranglement : lorsque l'image contient non seulement des éléments visuels, mais aussi du texte, une structure et même des relations logiques, la question n'est plus seulement de similitude ou de dissemblance, mais en même temps de savoir comment ces informations sont établies.

La problématique se déplace de la qualité de la production à la cohérence structurelle.

Tous les chercheurs ne s’attaqueront pas à ce type de problème. Il ne correspond pas directement à un certain indicateur d’évaluation, et il est difficile de le traduire en effets produits à court terme. En revanche, il est souvent plus facile de constater des améliorations lorsque l’on travaille sur la résolution, le style et les détails.

Le cheminement de Chen Boyuan s'est avéré éviter ces directions « plus faciles » : dès le début de ses recherches au stade universitaire, il ne s'est pas concentré sur les capacités monomodales, mais sur la manière dont les différentes capacités sont connectées entre elles.

Depuis longtemps, les modèles visuels, les modèles linguistiques et les systèmes de prise de décision se sont développés indépendamment. Ils peuvent être connectés via des interfaces, mais sont souvent séparés en interne. Par conséquent, même si le modèle peut « faire appel à des capacités », il est difficile d’en démontrer une compréhension cohérente.

Le travail de Chen Boyuan consiste à tenter de changer cette situation.

De nombreuses capacités du modèle ont cette fois été démontrées à l'intersection « d'images, de textes, de mèmes, d'objets réels et de contexte culturel ».

Chen Boyuan a déclaré que de nombreuses photos sur le blog officiel avaient été prises par lui. L'ensemble du blog est généré à partir d'images, sans aucun texte ordinaire. En d’autres termes, la plupart des exemples que les utilisateurs voient sur le site officiel ne sont pas seulement du matériel promotionnel, mais font partie des capacités du modèle lui-même.

Par exemple, cette bande dessinée chinoise sur les œufs de Pâques.

Il voulait faire un dessin animé très drôle, alors il a utilisé "catch stalk" et "banana stalk". Afin de démontrer sa capacité d'écriture, il a spécialement demandé au modèle d'ajouter du texte dans plusieurs langues à l'image, et a également généré de très petits caractères chinois dans le coin inférieur droit de l'affiche de la ville natale pour tester la précision des détails que le modèle pouvait gérer.

Plus important encore, cette image n'est pas collée - selon lui, l'image entière, y compris l'image dans l'image et l'image dans l'image, est générée en même temps. Il craignait que les gens pensent qu'il s'agissait d'une image collée, alors il a délibérément ajouté une note au bas de l'image.

Cela illustre simplement la difficulté de GPT Image 2. Si le modèle d'image du passé pouvait écrire quelques gros caractères sans commettre d'erreurs, il serait considéré comme très bon. Mais GPT Image 2 doit gérer tout un ensemble de niveaux : il doit savoir qu'il s'agit d'une photo de bande dessinée, qu'il y a des images dans la bande dessinée, et qu'il y a des images dans les images ; il doit mettre du texte dans différentes languesà différents niveaux ; il doit également établir la relation entre ces mots et l'image, plutôt que d'être dispersés au hasard dans l'image.

Un autre exemple est la gravure de grains de riz.

Chen Boyuan a déclaré qu'au début, il avait estimé que le rendu du texte ordinaire n'était pas assez époustouflant, il a donc pris une photo 4K après avoir été invité par ses coéquipiers : la photo montrait un tas de grains de riz, sur l'un desquels étaient gravés des mots.

Cela teste la capacité du modèle à contrôler le texte à des échelles extrêmement petites.

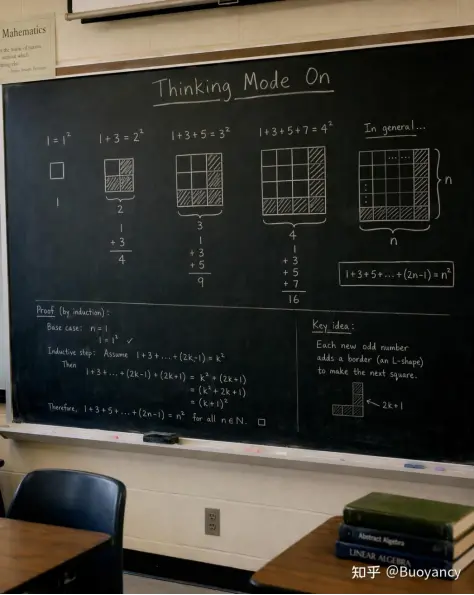

Et cette preuve visuelle au tableau.

Chen Boyuan a déclaré: "Cela semble trop simple si vous lui demandez de résoudre des équations mathématiques ordinaires et autres. Nano Banana semble être capable de le faire grâce au mode réflexion + rendu de texte. J'ai donc pensé à une preuve visuelle que j'aime beaucoup pour vraiment tester l'image GPT 2. Effet de raisonnement visuel unique. L'invite dans l'image est d'utiliser la vision (plutôt que l'algèbre) sur le tableau noir pour prouver que la somme des nombres impairs à partir de 1 est un carré. Il est en fait facile de raisonner sur l'algébrique. solution, mais la solution graphique ne peut se faire qu'avec le modèle visuel ".

C'est également l'un des changements les plus remarquables de la sortie de GPT Image 2 : il peut commencer à transformer une relation abstraite en une structure d'image, puis exprimer cette structure visuellement.

Par conséquent, plutôt que de dire que GPT Image 2 « génère des images », il vaut mieux dire qu’il génère une expression visuelle structurée.

Bandes dessinées, affiches, preuves visuelles... rien de tout cela n'est purement image. Ils contiennent également du texte, de la typographie, de la hiérarchie, des relations d'objet, des objectifs de tâche et des jugements esthétiques.

Les modèles d'images antérieurs ont tendance à s'effondrer ici car ils traitent les images comme des résultats en pixels. Cette génération de modèles d’images plus forts doit traiter les images comme une expression structurée.

03

il n'est pas seul

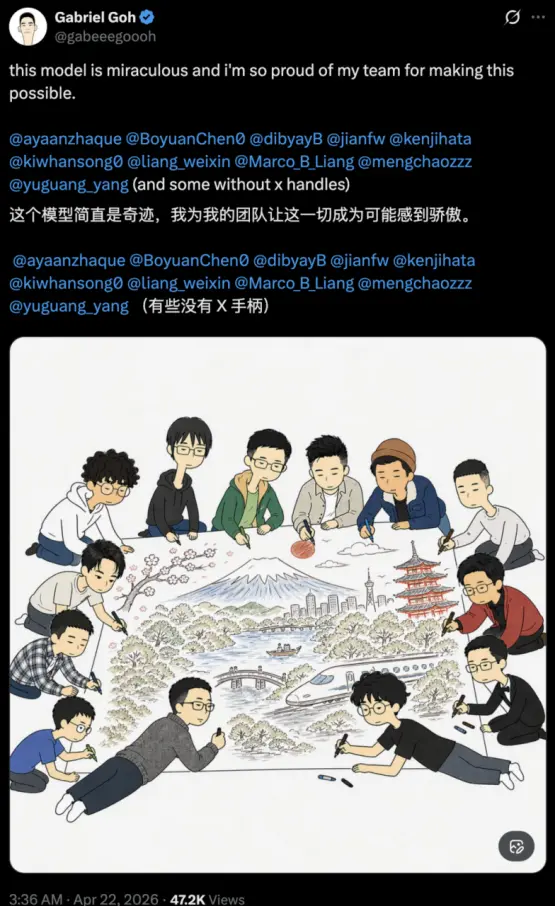

Au sein d’OpenAI, peu de personnes sont réellement impliquées dans la formation des modèles. Après la publication de GPT-image-2, le responsable de la recherche Gabriel Goh a publiquement remercié les membres de son équipe sur les réseaux sociaux.

La liste n’est pas longue, seulement une douzaine de personnes.

Il s’agit plus d’une petite équipe que d’un grand système d’ingénierie.

Les membres de l'équipe sont dispersés dans des directions différentes, certains s'occupent de la vision, d'autres des mécanismes de génération et certains s'occupent de la structure du système, mais ils pointent finalement vers la même chose : donner au modèle un ensemble de capacités capables de gérer les images, le langage et la structure en même temps.

L'illustration dans le tweet est aussi dans une certaine mesure comme une métaphore : un groupe de personnes se rassemble, chacun est responsable d'une partie, et finalement ils forment la même image.

La structure du modèle, les limites des capacités et même « ce que devrait être l'image » sont tous définis petit à petit dans une telle équipe.

Une chose à noter est que parmi l'équipe de base de plus d'une douzaine de personnes, on peut voir un nombre considérable de noms chinois.

Outre Chen Boyuan, il comprend également Jianfeng Wang qui s'occupe de la modélisation du langage visuel, Weixin Liang qui s'occupe de l'évaluation des modèles et des problèmes de données, Yuguang Yang qui s'occupe de la génération d'images depuis longtemps et de nombreux chercheurs impliqués dans la génération d'images et la formation de systèmes.

Chen Boyuan n'a pas décrit cet incident comme une victoire personnelle. A la fin de l'article de Zhihu, il a spécialement remercié toute l'équipe. Il a dit que tout le monde a fait beaucoup, beaucoup de choses. À la fin de la période de pré-lancement, en plus de régler quelques petites choses, il a travaillé avec des collègues du département marketing et des collègues artistiques pour préparer la conférence de presse et le site Web.

En d’autres termes, GPT Image 2 est une réalisation conjointe de recherche, de produits, d’esthétique et de communication. L'équipe modèle doit créer les capacités, l'équipe artistique doit savoir quels types d'images peuvent afficher les capacités, et l'équipe marketing doit traduire ces capacités en images que les utilisateurs ordinaires peuvent comprendre, être prêts à tester et à diffuser.

C'est pourquoi de nombreux exemples de cette version sont spéciaux. Ils ne finissent pas seulement par générer une belle image, mais créent activement des problèmes : plusieurs langues, un texte très petit, une image dans l'image, des objets réels, une preuve visuelle, des affiches générées par la recherche et l'intégration de codes QR.

Chaque image indique à l'utilisateur : ce que vous pensiez que le modèle d'image ne pouvait pas faire auparavant, vous pouvez réessayer maintenant.

De ce point de vue, la position de Chen Boyuan est très particulière.

Il est à la fois du côté de la formation des modèles et du côté narratif de l'édition ; il a non seulement participé à la réalisation du modèle, mais a également conçu personnellement de nombreuses images pour permettre au monde extérieur de comprendre les capacités du modèle.

L'image GPT 2 n'est certainement pas l'œuvre de Chen Boyuan seul, mais à en juger par les informations publiques, Chen Boyuan est en effet l'un des noms les plus dignes d'attention de la communauté chinoise dans cette version de modèle d'image.

D'une part, le modèle de génération de graphiques GPT publié cette fois était sa principale formation ; d'un autre côté, il s'est avéré être à l'origine d'une percée qui est la plus facilement perçue par les utilisateurs chinois : le rendu chinois.

Lorsque l’IA a finalement été capable d’écrire le chinois dans des images complexes, le chercheur derrière elle, qui avait longtemps étudié les modèles du monde, la compréhension spatiale et la cohérence générative, est apparu au premier plan.

"J'espère que cette fois nous avons réussi à attraper tout le monde en toute sécurité", a-t-il déclaré.