Lors d'un événement spécial Android à la veille de la conférence des développeurs I/O de cette année, Google s'est une fois de plus concentré sur son propre grand modèle à usage général Gemini et a annoncé une série de nouvelles fonctionnalités visant à "vous aider à contrôler votre téléphone". Ces fonctionnalités apparaîtront dans le navigateur Chrome, le remplissage automatique des formulaires du système et davantage de scénarios d'application.

Google a également lancé un nouveau nom de concept : « Gemini Intelligence ». Selon Ben Greenwood, directeur de l'expérience Google Android, ce nom représente "la libération des meilleures capacités de Gemini sur les appareils Android les plus avancés". Il s'agit essentiellement d'une intégration packagée de fonctionnalités existantes et nouvelles, et s'adresse principalement aux modèles phares haut de gamme tels que le Galaxy S26, formant un ensemble de fonctionnalités similaire à une « expérience Android avancée ».

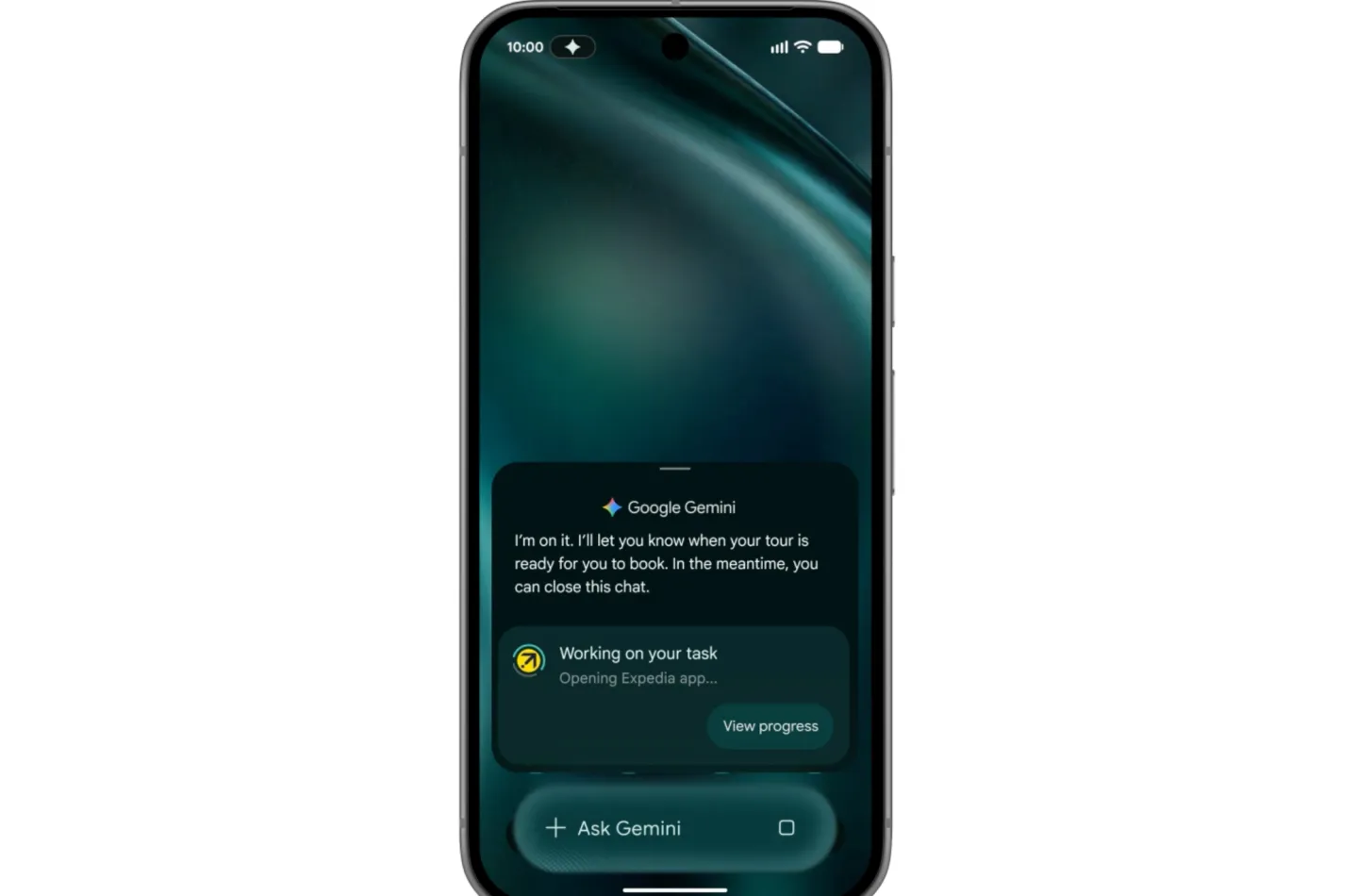

Au cœur de cette collection se trouvent des fonctionnalités d’automatisation des tâches qui ont déjà été testées sur certains nouveaux téléphones Pixel et Samsung Galaxy. Cette fonctionnalité permet à Gemini d'exploiter des applications spécifiques directement sur le téléphone. Auparavant, il prenait principalement en charge quelques applications telles que le covoiturage et la livraison de nourriture. Google a annoncé qu'il s'ouvrirait "bientôt" à un écosystème d'applications plus large. En outre, l'automatisation des tâches sera également mise à niveau, passant de la prise en charge uniquement des commandes vocales et textuelles à la saisie multimodale. Les utilisateurs peuvent déclencher des actions via des captures d'écran ou des photos. Par exemple, donnez à Gemini une capture d'écran d'une liste de courses dans l'application Note, et il ajoutera automatiquement un panier à la plateforme de commerce électronique ou d'épicerie - à condition que l'appareil lui-même prenne en charge Gemini Intelligence.

Dans le cadre de Gemini Intelligence, Google a également annoncé pour la première fois une nouvelle fonctionnalité appelée « Créer mon widget », qui est officiellement considérée comme la première étape vers une « interface utilisateur générative ». Les utilisateurs n'ont qu'à décrire les fonctions du widget qu'ils souhaitent en langage naturel, et Gemini générera automatiquement les composants de bureau correspondants. Les exemples donnés par Google incluent : la personnalisation d'un composant météo qui met en évidence la vitesse du vent et la probabilité de précipitations pour les amateurs de cyclisme, ou un composant de recette qui recommande automatiquement "trois recettes de préparation de repas riches en protéines" chaque semaine. Après génération, ces composants apparaîtront non seulement sur le bureau du téléphone mobile, mais seront également étendus simultanément aux montres intelligentes Wear OS, formant ainsi une expérience unifiée sur tous les appareils.

Du point de vue du concept d'interaction, Google espère que les utilisateurs considéreront les composants comme des « mini-applications qui peuvent être facilement écrites sur le bureau à l'aide de l'IA », favorisant ainsi l'évolution des formes d'interface vers une génération instantanée et des changements à la demande. L'industrie se demande également si Google expliquera davantage la voie à long terme de « l'interface utilisateur générative » lors de la conférence I/O : si cela permettra à l'interface d'être véritablement reconstruite instantanément en fonction de la scène, ou s'il s'agira davantage d'une tentative personnalisée au niveau des composants.

En plus des fonctions au niveau du système, Google a également déplacé certaines fonctionnalités de bureau de Gemini vers la version Android du navigateur Chrome. À l'avenir, les utilisateurs verront un bouton Gemini indépendant dans Chrome, qui pourra partager directement le contenu de la page Web actuelle avec Gemini, poser des questions ou générer un résumé des informations de la page dans le navigateur. Pour les utilisateurs qui s'abonnent au forfait Google AI Pro ou Ultra, Chrome fournira également une « navigation automatique » pour les aider à effectuer des tâches, telles que passer automatiquement d'un site Web à l'autre, remplir des informations et prendre des rendez-vous. Cette fonctionnalité devrait être déployée progressivement fin juin.

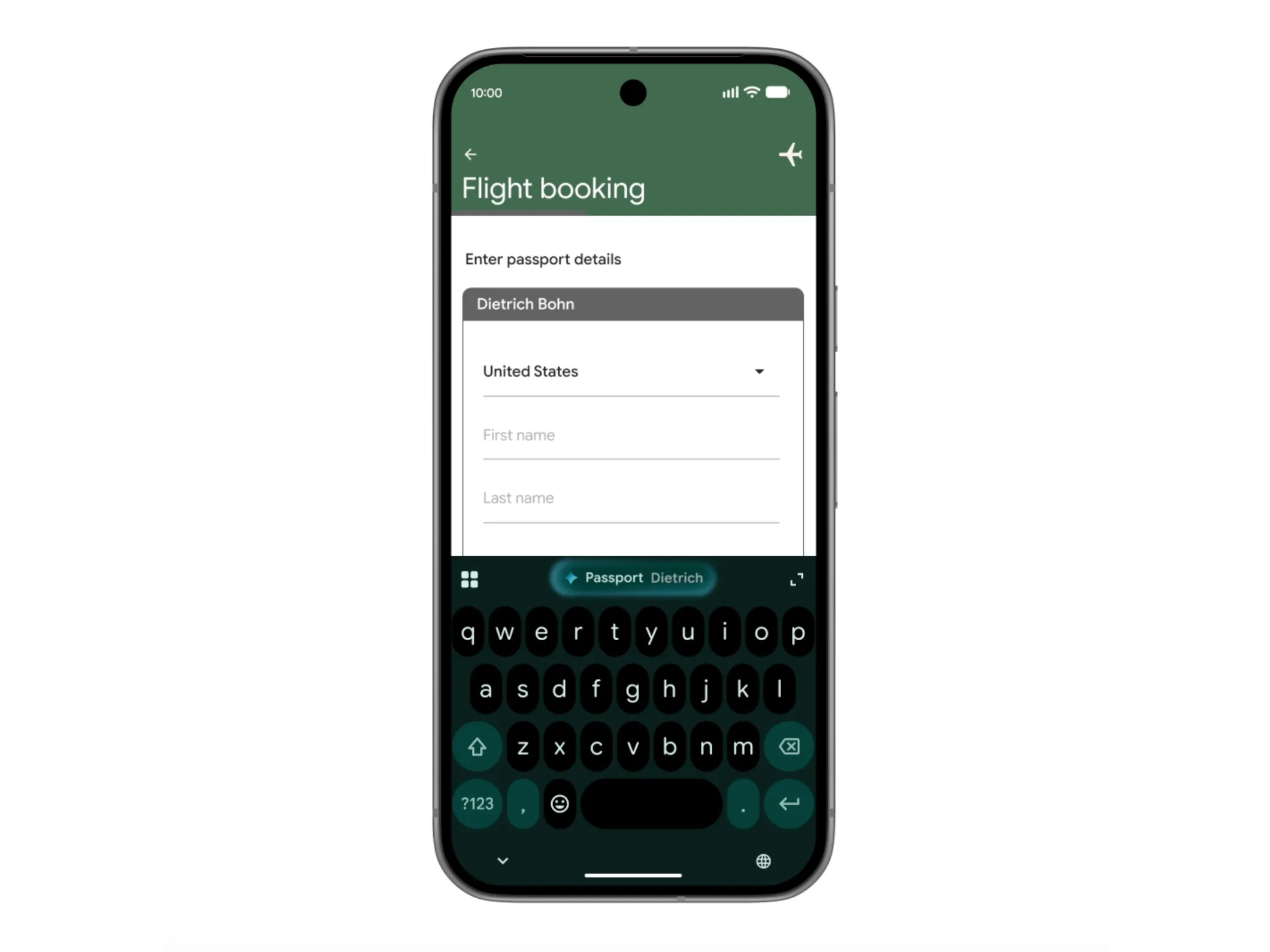

En ce qui concerne une autre entrée importante dans la couche système - le remplissage automatique des formulaires, Gemini interviendra également « sous condition » plus profondément. Google a déclaré que les utilisateurs peuvent choisir de connecter Gemini à la fonction de remplissage automatique d'Android pour faciliter le remplissage de divers formulaires. Pour ce faire, Gemini utilisera son interface dite « Personal Intelligence » pour récupérer des informations pertinentes à partir de sources de données personnelles telles que Google Photos et Gmail avec autorisation, comme l'identification automatique des numéros de plaque d'immatriculation sur les photos et le remplissage de formulaires. D'une part, cette approche a considérablement amélioré l'efficacité du remplissage. D'autre part, elle a également déclenché un nouveau débat sur la frontière entre confidentialité et commodité - c'est à l'utilisateur de juger si c'est "extrêmement prévenant" ou "un peu bizarre".

Selon le plan de Google, diverses fonctions de Gemini Intelligence seront lancées cette année "par lots et selon leur maturité". Le premier lot d'objets push sera toujours constitué de modèles Android haut de gamme tels que le Samsung Galaxy et le Google Pixel, et il devrait recevoir des mises à jour à partir de cet été.