Après que le PDG de Tesla, Elon Musk, ait publiquement salué les derniers résultats de recherche de la société chinoise d'IA Kimi, le compte officiel de Kimi a répondu aujourd'hui sur un ton humoristique : "Votre fusée n'est pas mauvaise non plus !"Récemment, l'équipe Kimi a publié un rapport technique proposant un nouveau mécanisme de résidus d'attention pour réaliser une reconstruction perturbatrice de la connexion résiduelle traditionnelle utilisée dans le domaine de l'apprentissage profond depuis près de dix ans et qui a rapidement attiré l'attention du monde entier.

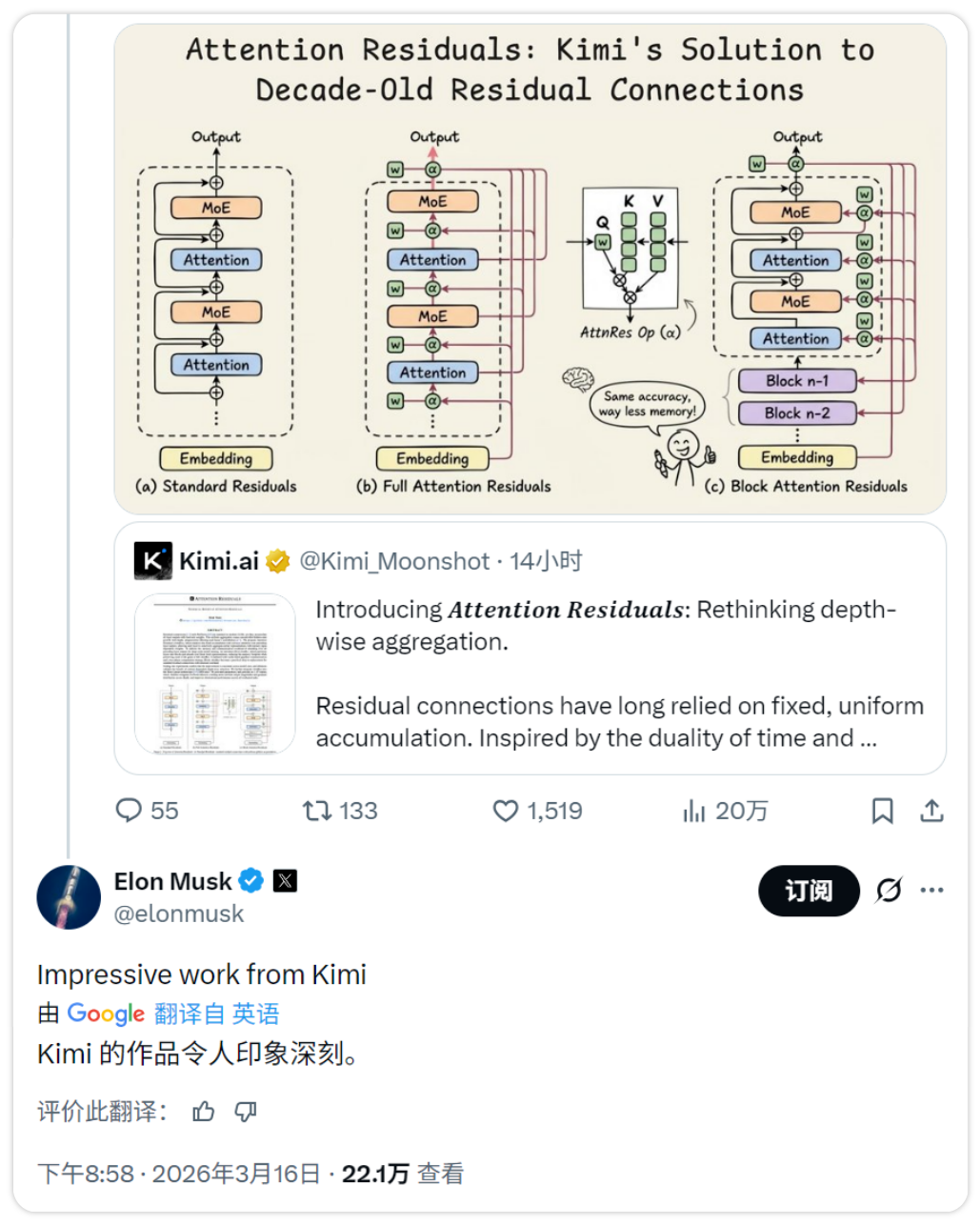

Les connexions résiduelles traditionnelles utilisent « une accumulation de poids égal fixe » pour transmettre des informations. L'augmentation du nombre de couches peut facilement conduire à une dilution des informations superficielles, à une faible efficacité de la formation et à une mauvaise stabilité.

L'innovation de Kimi équivaut à installer un « filtre intelligent » sur l'IA, migrant le mécanisme d'attention du transformateur vers la dimension de profondeur du modèle, permettant à chaque couche de filtrer dynamiquement les informations précédemment utiles, de réduire la redondance et d'améliorer l'efficacité de la transmission.

Afin d'éviter la surcharge de mémoire, l'équipe a conçu la stratégie du « blocage de l'attention résiduelle ». Une fois le modèle divisé en blocs, l'accumulation traditionnelle est conservée dans les blocs pour assurer la stabilité.La pondération dynamique est utilisée entre les blocs et le délai d'inférence n'augmente que de moins de 2 %, atteignant ainsi un équilibre entre performances et efficacité.

Les mesures réelles montrent que l'efficacité de la formation du modèle de paramètres 48B est augmentée de 1,25 fois, et que les scores de raisonnement scientifique et de réponse aux questions mathématiques sont augmentés de 7,5 % et 3,6 % respectivement, résolvant efficacement le problème de déséquilibre de la formation sur modèle traditionnel.

Musk, connu pour être pointilleux, a transmis la recherche et a déclaré que "le travail de Kimi est impressionnant". Son xAI est en pleine restructuration, et cette reconnaissance montre son poids technique.

En outre, Jerry Tworek, ancien vice-président de la recherche chez OpenAI, connu comme le « père des modèles d'inférence », a également écrit : « Le Deep Learning 2.0 arrive ».