DeepSeek a publié un modèle de raisonnement multimodal et un rapport technique sur GitHub, intitulé « Penser avec des primitives visuelles (Penser avec des primitives visuelles) ». Ce modèle est construit sur la base de DeepSeek V4-Flash (284 milliards de paramètres au total, 13 milliards d'architecture MoE activée lors de l'inférence) et propose un nouveau paradigme de raisonnement multimodal.

L'article souligne qu'il existe un goulot d'étranglement fondamental dans les grands modèles multimodaux existants qui a été ignoré : le « écart de référence » (Reference Gap), c'est-à-dire que le modèle peut « voir » le contenu de l'image, mais lorsqu'il utilise le langage naturel pour construire une chaîne de pensée Au cours du processus de raisonnement, des descriptions vagues telles que le grand objet rouge à gauche près du centre ne peuvent pas localiser avec précision l'objet visuel dans une scène dense, ce qui fait dériver l'attention et tire de fausses conclusions.

Auparavant, la réponse dominante dans la communauté universitaire était d'améliorer la résolution perceptuelle, mais l'article estime que voir et être capable de dire clairement ce qui est dit sont deux choses différentes.

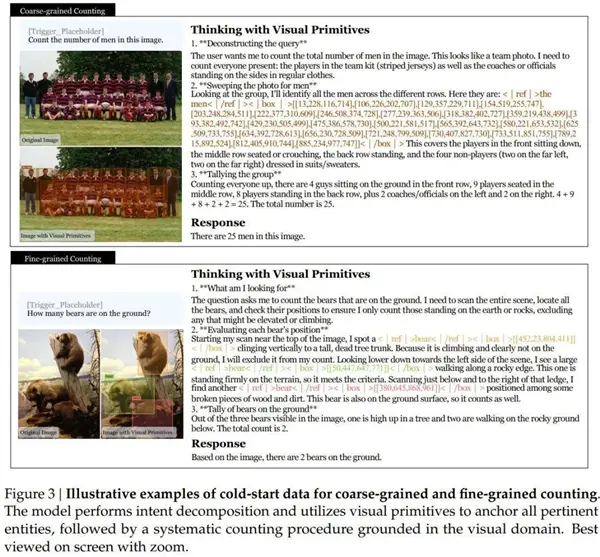

La principale innovation de ce modèle est d'intégrer les coordonnées des points et les cadres de délimitation dans le processus de raisonnement lui-même, ce qui en fait l'unité de base de la chaîne de réflexion. Chaque fois que le modèle mentionne un objet visuel lors de l'inférence, ses coordonnées sont sorties de manière synchrone.

Par exemple, "Trouvez un ours [452, 23, 804, 411], grimpant à un arbre, excluez-le, puis regardez en bas à gauche et trouvez-en un autre [50, 447, 647, 771], debout au bord du rocher, remplissant les conditions." Les coordonnées ne sont plus des réponses marquées après coup, mais des ancrages spatiaux pour éliminer toute ambiguïté lors du processus de raisonnement.

Au niveau architectural, le modèle atteint une compression visuelle de 7056 fois, une image de 756 × 756. Après le traitement ViT, 2916 jetons de bloc d'image ont été générés, qui ont été fusionnés en 324 jetons. grâce à une compression spatiale 3 × 3. Le cache KV a ensuite été compressé 4 fois via le mécanisme Compressed Sparse Attention (CSA), et finalement, il ne restait que 81 entrées visuelles KV.

À titre de référence, l'image de même taille Claude Sonnet 4.6 nécessite environ 870 pièces, et Gemini-3-Flash nécessite environ 1100 pièces.

En termes de données d'entraînement, l'équipe a sélectionné environ 31 700 sources de données de haute qualité parmi près de 100 000 ensembles de données de détection de cibles et généré plus de 40 millions d'échantillons d'entraînement, couvrant quatre types de tâches : comptage, raisonnement spatial, navigation dans un labyrinthe et suivi de chemin.

La post-formation adopte d'abord la stratégie d'expertise puis d'unification. Deux modèles experts, le cadre de délimitation et les coordonnées de points, sont formés séparément. Après optimisation de l'apprentissage par renforcement, ils sont fusionnés dans un modèle unifié grâce à une distillation de politiques en ligne.

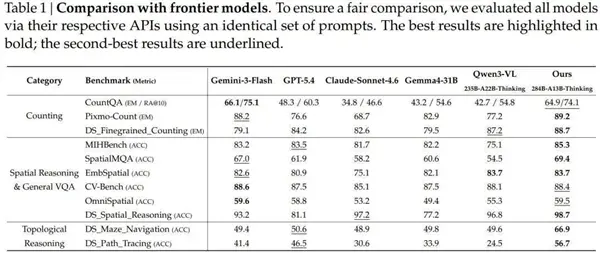

Les résultats expérimentaux ont été comparés à des modèles grand public tels que Gemini-3-Flash, GPT-5.4 et Claude Sonnet 4.6 sur 11 tests de référence.

Sur la tâche de comptage, le score de correspondance exacte de Pixmo-Count est de 89,2 %, dépassant les 88,2 % de Gemini-3-Flash, et nettement devant GPT-5.4 est 76,6% et Claude 68,7% de Sonnet 4.6.

L'écart le plus représentatif apparaît dans le raisonnement topologique : le score de navigation dans le labyrinthe est de 66,9 %, GPT-5,4 est de 50,6 %, Gemini-3-Flash est de 49,4 %, Claude Sonnet 4,6 est de 48,9 %, soit une augmentation d'environ 17 points de pourcentage ; le score de suivi de chemin est de 56,7 %, GPT-5,4 est de 46,5 %.

Cependant, l'article souligne également les limites actuelles : le modèle doit déclencher explicitement des mots pour activer le mécanisme primitif visuel, la précision des coordonnées dans les scènes extrêmement fines est limitée et il reste encore place à l'amélioration des capacités de généralisation entre scènes.