Google a révélé pour la première fois que son équipe de sécurité avait découvert et bloqué avec succès un exploit zero-day soupçonné d'être développé par l'intelligence artificielle lors d'une cyberattaque en cours. Selon un rapport publié par le Google Threat Intelligence Group (GTIG), l'attaque a été orchestrée par un « acteur cybercriminel bien connu » dans le but de lancer un « événement d'exploitation à grande échelle » et de cibler un « outil de gestion de système open source basé sur le Web » sans nom et de l'utiliser pour contourner le mécanisme d'authentification à deux facteurs (2FA) de la plateforme.

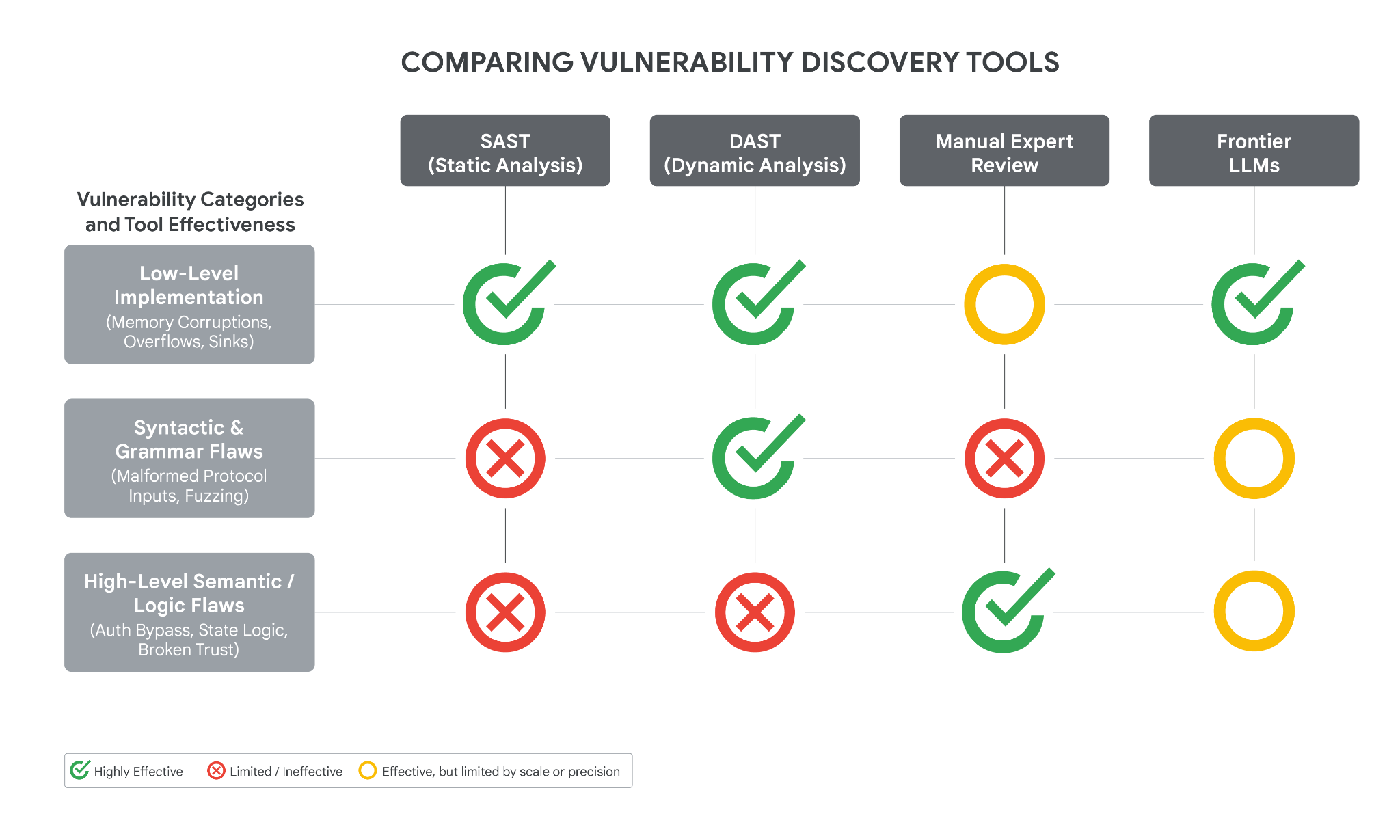

Les chercheurs de Google ont trouvé plusieurs indices dans le script d'exploitation Python utilisé pour mener l'attaque, soupçonnés d'être générés par l'IA, notamment un « score CVSS illusoire » et un style de mise en page structuré semblable à celui d'un manuel. Ces fonctionnalités sont très similaires aux formats de données de formation courants des grands modèles de langage. Le rapport indique que la vulnérabilité est essentiellement une « faille de logique sémantique de haut niveau » provoquée par « le codage en dur d'une hypothèse de confiance » dans la conception 2FA de la plateforme, offrant aux attaquants un point d'entrée qui peut être amplifié par des outils automatisés.

L'incident s'est produit à un moment où l'industrie débat âprement sur les capacités des modèles d'IA axés sur des scénarios de cybersécurité, tels que le modèle Mythos lancé par Anthropic, et la récente découverte d'une vulnérabilité du noyau Linux, assistée par l'IA, qui ont tous suscité une attention continue sur le rôle de l'IA en attaque et en défense. Google a déclaré que c'était la première fois qu'il trouvait des preuves claires que l'IA est directement impliquée dans le processus d'exploitation des vulnérabilités dans une attaque réelle, mais l'équipe de recherche a également souligné qu'elle "ne croit pas actuellement que le modèle Gemini de Google ait été utilisé dans cette attaque".

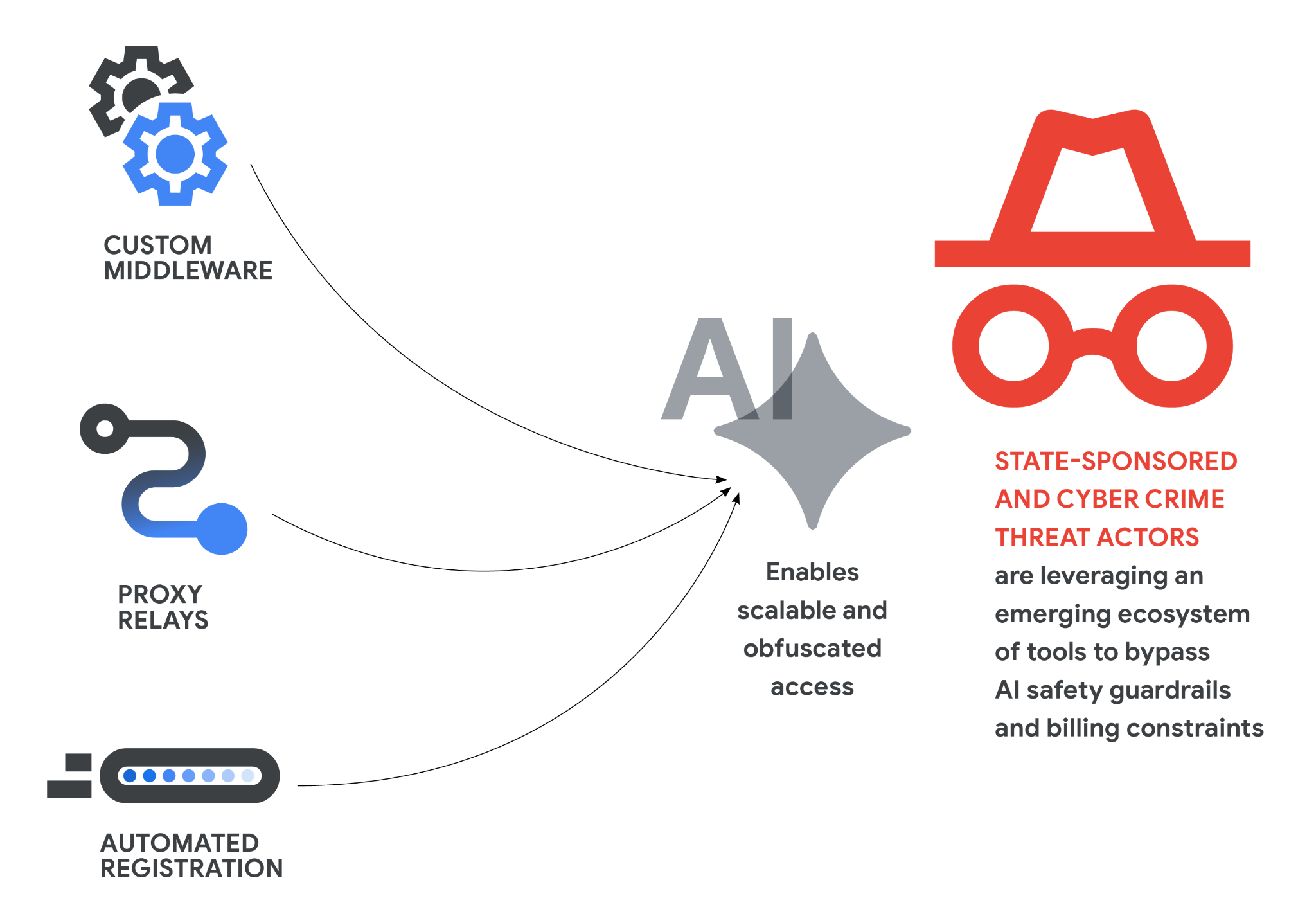

Google a déclaré avoir réussi à « perturber et bloquer » cette attaque spécifique, mais il a également averti que les pirates informatiques utilisent de plus en plus systématiquement l'IA pour découvrir et exploiter les vulnérabilités de sécurité, et que l'automatisation s'accélère depuis la collecte précoce de renseignements jusqu'à l'exploration des vulnérabilités et l'exploitation de l'écriture de code. Le rapport rappelle également que le système d'IA lui-même et son écosystème deviennent également une nouvelle surface d'attaque : les attaquants commencent à cibler des composants plus intégrés qui offrent des capacités pour l'IA, tels que des interfaces d'outils externes et des connecteurs de données tiers qui effectuent des tâches de manière autonome, afin de trouver de nouvelles voies d'intrusion.

En plus d'utiliser l'IA pour écrire du code d'attaque, Google a également nommé un type de technique de propagation dans le rapport : « jailbreak basé sur la personnalité ». L'attaquant construira soigneusement des mots d'invite pour permettre au modèle « d'agir » en tant que chercheur principal en sécurité ou expert en tests d'intrusion, l'incitant ainsi à produire du contenu qui devrait être intercepté par les politiques de sécurité, notamment en aidant à localiser des vulnérabilités de sécurité potentielles dans le système ou en générant des idées d'exploitation. Google a souligné que ce type de modèle d'attaque montre que le rôle de l'IA dans le domaine de la sécurité des réseaux évolue rapidement d'un simple outil défensif à un nouveau « multiplicateur » à la fois offensif et défensif. À l’avenir, de telles attaques zero-day impliquant une forte implication de l’IA ne constitueront peut-être plus une exception.