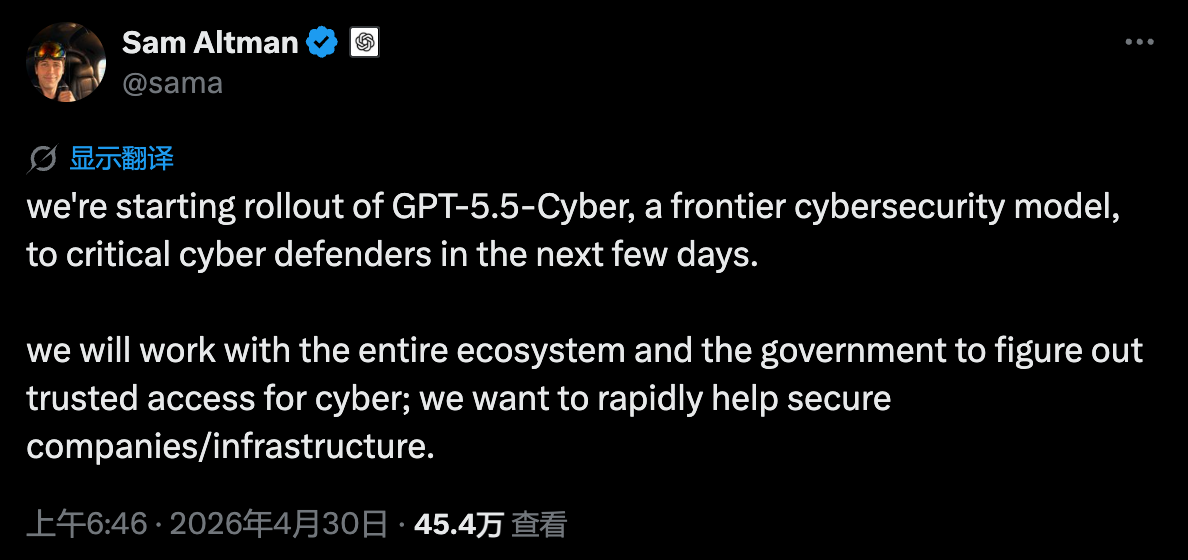

OpenAI se prépare à lancer un nouveau modèle de sécurité réseau de pointe, GPT-5.5-Cyber. Le PDG de la société, Sam Altman, a déclaré que ce modèle ne serait pas ouvert au public, mais qu'il serait d'abord fourni à un groupe de « cyberdéfenseurs » sélectionnés et dignes de confiance pour aider les institutions concernées à renforcer leurs propres capacités de protection de la sécurité des réseaux.

Selon Altman sur Platform Dans le même temps, OpenAI coopérera également avec l'ensemble de l'écosystème industriel et le gouvernement américain pour étudier comment établir un mécanisme « d'accès de confiance » pour le domaine de la sécurité des réseaux.

À l'heure actuelle, OpenAI n'a pas encore spécifié le premier lot d'objets spécifiques pour obtenir les droits d'utilisation. Cependant, à en juger par le programme « Trusted Access » précédemment lancé par l’entreprise, les dispositions pertinentes sont généralement destinées aux professionnels et aux institutions approuvés. Concernant les détails techniques, les limites des capacités et les spécifications spécifiques de GPT-5.5-Cyber lui-même, OpenAI n'a pas divulgué plus d'informations pour le moment.

À en juger par son nom, GPT-5.5-Cyber est probablement une version spécialisée du GPT-5.5 récemment publié. OpenAI a précédemment décrit GPT-5.5 comme son modèle « le plus intelligent, le plus intuitif et le plus facile à utiliser » à ce jour. Par conséquent, on pense généralement que GPT-5.5-Cyber sera un produit dérivé basé sur cette base qui sera ciblé sur des scénarios de sécurité des réseaux pour un renforcement ciblé.

La sortie de modèles à haute capacité par étapes et à petite échelle devient une tendance de plus en plus évidente dans l'industrie de l'IA. De nombreuses entreprises ont commencé à souligner que leurs modèles les plus avancés ne sont pas adaptés à une ouverture totale au public en raison du risque d'abus. OpenAI a déjà adopté une stratégie de publication par lots pour ses modèles axés sur la sécurité des réseaux ; Outre la sécurité des réseaux, le nouveau modèle GPT-Rosalind, spécifique aux sciences de la vie, récemment lancé par la société, est également un produit adapté à des domaines spécifiques très sensibles, servant principalement à la recherche biologique et à la découverte de médicaments.

Ce mois-ci, Anthropic a emprunté un chemin similaire en lançant Claude Mythos et en promouvant vigoureusement sa méthode de libération à haute barrière, sécurisée et contrôlée. Cependant, Anthropic a commis des erreurs assez embarrassantes lors du processus de libération de sécurité du modèle, ce qui a autrefois suscité la controverse sur les dispositions pertinentes.

Le rapport mentionne également que malgré les tensions antérieures entre la Maison Blanche et Anthropic sur les questions liées au Pentagone, le gouvernement américain continue de prêter une attention particulière au processus de lancement de Mythos. Selon le « Wall Street Journal », la Maison Blanche s'est même récemment opposée à l'élargissement de l'accès à Mythos. Cela reflète également le fait que le gouvernement américain fait preuve d'une attitude d'intervention de plus en plus directe et prudente à l'égard de la publication de modèles d'IA de grande capacité pouvant impliquer des risques pour la sécurité.