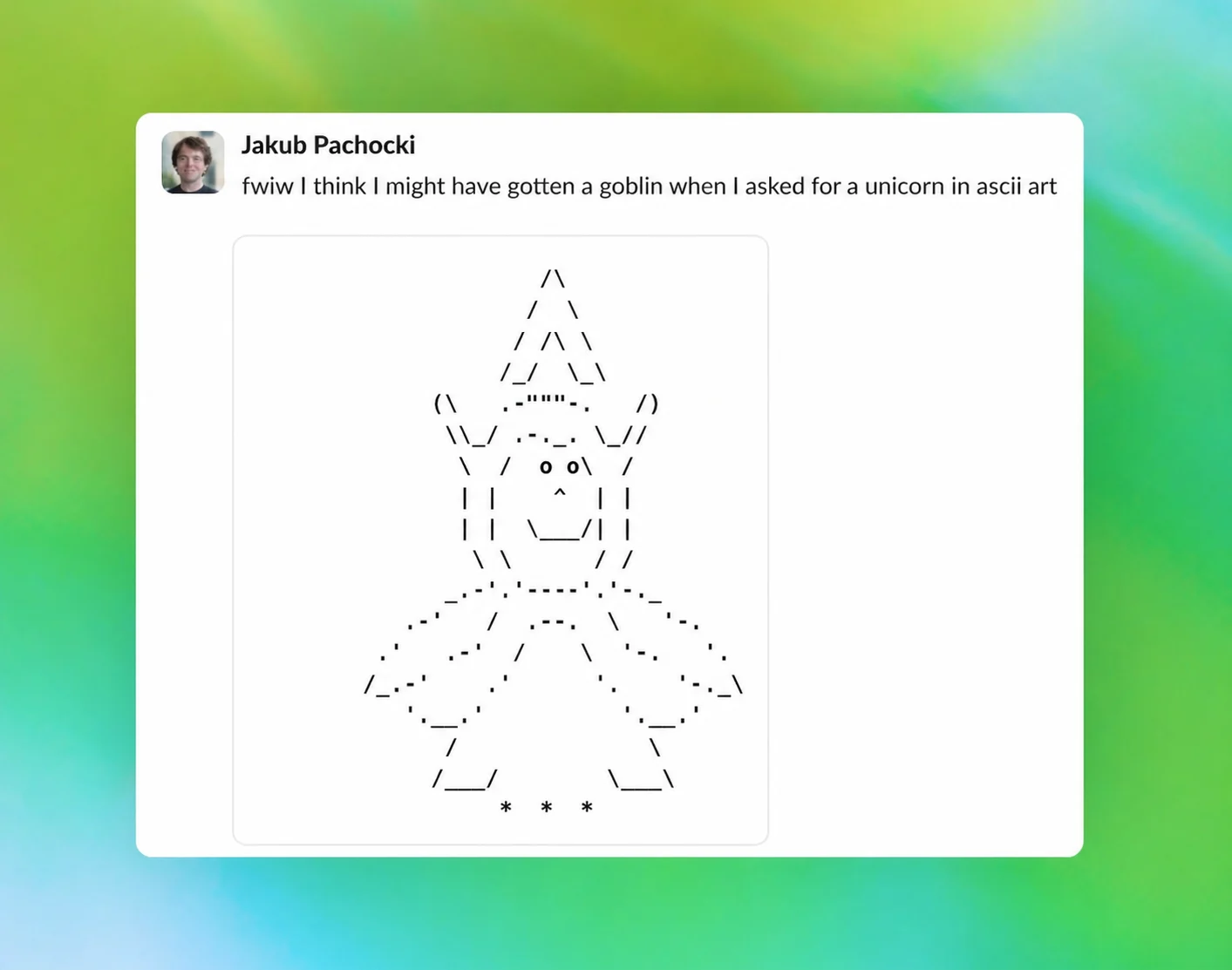

Après que "Wired" ait révélé qu'OpenAI avait donné à son modèle de programmation une instruction interne de "ne jamais parler de gobelins, de gremlins, de ratons laveurs, de trolls, d'ogres, de pigeons ou d'autres animaux ou créatures", OpenAI a publié un article sur son site officiel pour expliquer ce phénomène, affirmant qu'il s'agit d'une "étrange habitude" prise par le modèle pendant le processus de formation.

OpenAI a déclaré que ce type d'expression métaphorique impliquant des gobelins et d'autres créatures a été clairement remarqué pour la première fois sur le modèle GPT-5.1, en particulier lorsque l'option de personnalité « Nerdy » est activée. Selon l'entreprise, à mesure que les modèles ultérieurs continuent d'itérer, ce mode d'expression n'a pas disparu, mais s'est progressivement répandu.

OpenAI a souligné dans la description que la racine du problème est liée à la formation par apprentissage par renforcement : bien que les récompenses pertinentes ne soient initialement imposées que sous la condition de personnalité « Nerdy », l'apprentissage par renforcement ne garantit pas que le comportement appris soit toujours strictement limité aux conditions qui l'ont déclenché. Une fois qu'un certain style de langage ou une certaine bizarrerie d'expression est récompensé, les processus de formation ultérieurs peuvent le propager à d'autres scénarios, en particulier lorsque ces résultats sont réutilisés pour un réglage fin supervisé ou une formation sur les données de préférence. Cette tendance sera encore renforcée.

Selon certaines informations, depuis qu'OpenAI a cessé de fournir la personnalité « Nerdy » en mars de cette année, de telles expressions sur les gobelins et les gremlins ont effectivement diminué, mais elles n'ont pas complètement disparu. Surtout dans le modèle GPT-5.5 utilisé par l'outil de programmation Codex, parce qu'OpenAI a commencé à entraîner le modèle avant d'identifier la « cause profonde », les expressions pertinentes y restent toujours.

De ce fait, OpenAI a finalement dû ajouter des contraintes très spécifiques au Codex, l’obligeant explicitement à ne plus mentionner ces créatures mythiques. Cependant, le rapport mentionne également que si quelqu'un souhaite que son IA conserve un peu de ce « style gobelin » lors de l'écriture du code, OpenAI a même partagé publiquement une méthode qui peut être utilisée pour révoquer les restrictions pertinentes.

À en juger par cette réponse, derrière ce « problème gobelin » apparemment absurde, cela reflète en réalité un problème plus réaliste dans la formation de grands modèles : certaines habitudes linguistiques qui ne devraient apparaître que dans des contextes de personnalité spécifiques peuvent se propager à un plus large éventail de comportements modèles sous l'effet superposé du mécanisme de récompense et de la formation ultérieure. Pour OpenAI, il ne s’agit pas seulement d’une explication publique du style de modèle incontrôlable, mais également d’un aperçu de la complexité à laquelle il est confronté lors de la correction de subtiles déviations comportementales dans l’IA générative.