Le prix de transaction des serveurs NVIDIA B300 AI sur le marché chinois continental a grimpé à environ 7 millions de yuans par unité, soit environ 1 million de dollars américains, soit près du double du prix d'environ 4 millions de yuans à la fin de l'année dernière.À titre de référence, le même serveur équipé de huit GPU B300 coûte environ 550 000 dollars sur le marché américain, ce qui ne représente qu'une légère augmentation par rapport aux 500 000 dollars de la fin de l'année dernière. La différence de prix sur le marché chinois est presque le double.

La flambée des prix a incité certaines entreprises d’IA, à court de liquidités, à passer de l’achat à la location. On rapporte que,Le prix d'un contrat de location d'un an pour le serveur B300 est passé à 190 000 yuans par mois, et il y a encore une file d'attente pour attendre la libération des ressources.

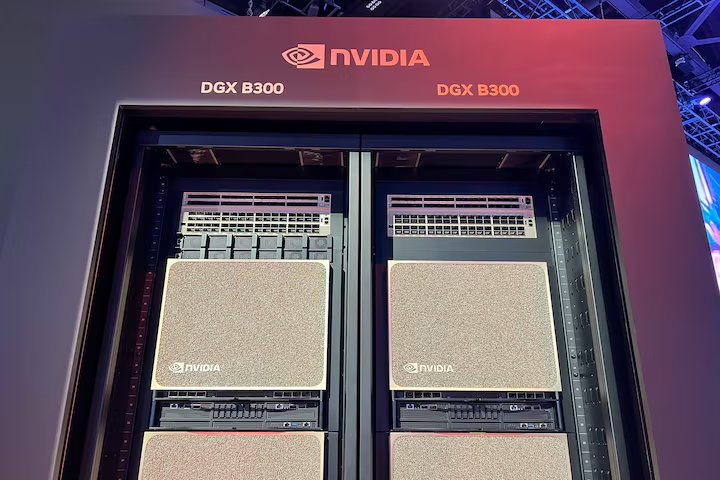

Les spécifications matérielles du B300 soutiennent les prix du marché. Le B300 est équipé de 288 Go de mémoire HBM3e à large bande passante et peut fournir une puissance de calcul de 14 pétaFLOPS avec une précision FP4. Il s'agit actuellement de l'une des puces les plus puissantes de Nvidia pouvant être utilisée pour les tâches d'inférence d'IA.

L’incertitude concernant les exportations de H200 vers la Chine fait également grimper les prix du B300. Bien que le gouvernement américain ait approuvé la licence d'exportation du H200 vers la Chine, les deux parties ont encore des divergences sur les conditions spécifiques et n'ont pas encore été en mesure de l'expédier. Cette impasse a rendu le B300 encore plus rare sur le marché.

Les fabricants locaux de puces d’IA en Chine augmentent progressivement leur compétitivité. Huawei a formulé une feuille de route claire pour les itérations de produits et prévoit de lancer quatre puces de la série Ascend par phases de 2026 à 2028, dont l'Ascend 950PR au premier trimestre 2026.

Actuellement, des fabricants tels que Haiguang, Cambrian et Alibaba Pingtouge promeuvent également simultanément l’itération de puces de formation et d’inférence en IA.