Les générateurs d’images d’IA modernes évoluent rapidement et les défauts visibles d’un seul coup d’œil au début, tels que les mains et les pieds déformés, les textes désordonnés et le bruit d’image étrange, sont progressivement atténués par des moyens techniques. De nos jours, de nombreuses images de synthèse suffisent à tromper l’œil nu du commun des mortels et à se propager de manière incontrôlable sur les réseaux sociaux. Cependant, une étude publiée dans la revue Science souligne que ces modèles « ne comprennent toujours pas » comment la lumière et la géométrie fonctionnent dans le monde réel, et que les lois physiques sont en train de devenir l'un des outils les plus fiables pour identifier les images authentiques et fausses.

Les chercheurs ont souligné que tant que le reflet, l’ombre, la ligne de perspective et d’autres éléments apparemment insignifiants sont mesurés, il est toujours possible de révéler une photo IA apparemment parfaite. Cette méthode de vérification basée sur la cohérence du monde physique est considérée par les experts en criminalistique numérique comme une ligne de défense importante pour distinguer les vraies photos des contrefaçons de l’IA à l’ère des « deep fakes ». L'identification précoce reposait souvent sur l'œil nu pour capturer les défauts techniques grossiers, mais à mesure que la qualité de la production s'améliorait, les images commençaient à se conformer de plus en plus aux attentes subjectives de l'homme en matière de « réalité » : des couleurs vives, des compositions dramatiques et une sensation cinématographique. Ce « drame fabriqué » a permis aux gens de relâcher plus facilement leur vigilance.

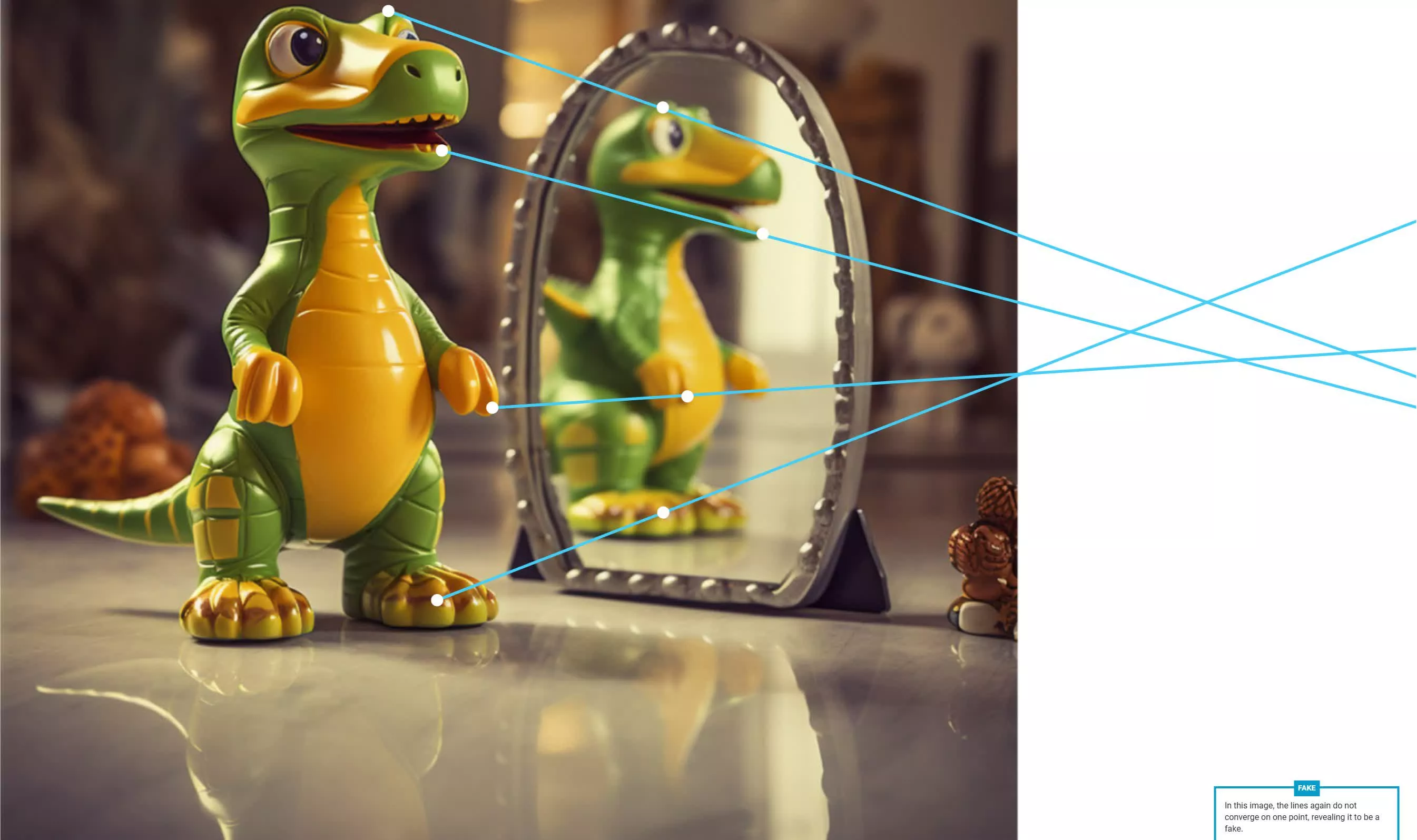

Hany Farid, professeur à l’Université de Californie à Berkeley et largement considéré comme l’un des fondateurs du domaine de la criminalistique numérique, exploite une autre « faiblesse cachée » des images de l’IA. Son approche ne consiste pas à rechercher des erreurs visuelles évidentes, mais à comparer les images générées avec les relations géométriques qui devraient apparaître dans le monde réel. Selon lui, les modèles de génération d'images existants n'ont pas encore véritablement appris le concept de base des cours d'art : le point de fuite.

Prenons comme exemple une image générée par l'IA de « soldats marchant dans un couloir ». Vous pouvez voir des défauts évidents dans l'image, comme un texte flou et difficile à lire sur le mur, des chaînes inexplicables, etc. Mais l'indice le plus critique est caché dans les carreaux au sol : selon le principe de perspective, les lignes parallèles dans la réalité (comme les joints des carreaux de sol et des parquets) devraient s'étendre et converger vers le même point de fuite dans l'image. Si vous tracez des lignes le long de ces structures avec l'outil Ligne, vous pouvez vérifier si elles se rejoignent au loin comme sur une vraie photo, vous donnant ainsi une première idée de la fiabilité de l'image.

Des relations géométriques similaires s'appliquent aux réflexions. Les recherches soulignent que même si les modèles génératifs actuels peuvent déjà synthétiser des réflexions d'eau ou spéculaires suffisantes pour tromper l'œil humain, les problèmes seront révélés tant que vous prendrez une règle pour les mesurer. Dans le monde réel, les lignes reliant un certain point d'un objet et son point correspondant en réflexion doivent être parallèles les unes aux autres et pointer vers le même point de fuite après avoir été étendues ; une fois que ces lignes semblent présenter des écarts indus, cela signifie probablement qu'il s'agit d'une image composite.

Les ombres projetées par le soleil offrent également une adhérence supplémentaire pour ce type de test. Puisque le soleil est extrêmement éloigné de la terre, on peut approximativement considérer que la lumière solaire frappant le sol est une lumière parallèle. Selon ce principe, la ligne entre un certain point de l'objet et son point correspondant dans l'ombre devrait également pouvoir s'étendre et converger vers un point de fuite. Si les lignes d’ombre de différents objets sur une photo ne peuvent pas indiquer une relation géométrique cohérente, cela viole probablement les lois fondamentales de l’optique.

Il est actuellement difficile de prédire quand et si les modèles génératifs surmonteront fondamentalement ces erreurs au niveau physique. Par rapport aux défauts facilement perceptibles à l'œil nu au début, la « vérification géométrique » basée sur la perspective et la lumière nécessite que les observateurs consacrent plus de temps et d'énergie, ce qui dépasse de loin le seuil de vigilance quotidien de l'utilisateur moyen des médias sociaux. Certains chercheurs pensent même qu’une compréhension approfondie de ces règles physiques pourrait dépasser les capacités de conception des modèles génératifs traditionnels actuels.

Au-delà de ce travail, les experts avertissent également les utilisateurs d’être prudents quant à la « reconnaissance de l’IA avec l’IA ». Certains outils de détection automatique peuvent en effet être plus fiables que l’œil humain non entraîné dans certaines conditions, mais une fois que la distribution de l’image d’entrée et de ses données d’entraînement est trop différente, l’algorithme souffrira d’erreurs, voire de biais systématiques. En d’autres termes, confier entièrement la tâche de filtrage à un autre modèle de boîte noire n’est pas une solution infaillible.

Une étude connexe a également abouti à une découverte intrigante : il peut être plus difficile de confirmer qu'une photo est « réelle » que d'identifier une « fausse ». L’étude a révélé que plus un spectateur regardait une image longtemps sans trouver de défaut, plus il y avait de chances qu’il s’agisse d’une vraie photo. De ce point de vue, « aucune erreur trouvée » peut elle-même devenir l’une des preuves d’authenticité.