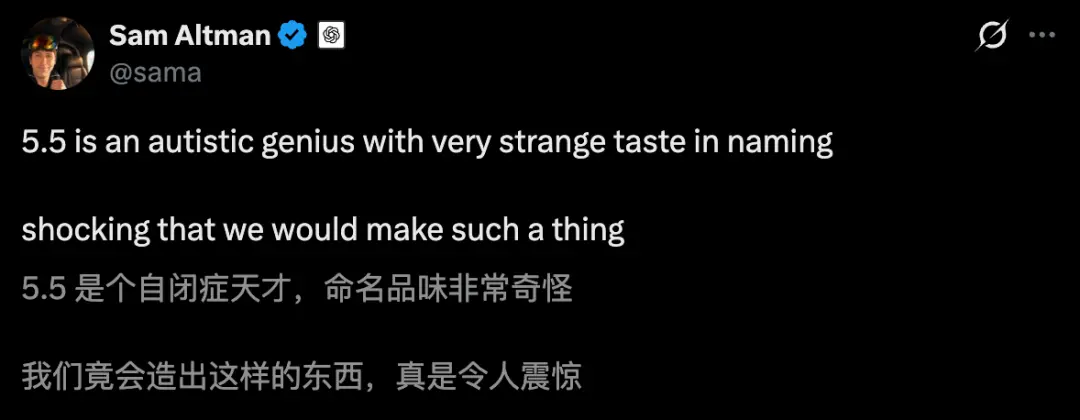

Tout à l'heure, Ultraman a personnellement donné à GPT-5.5 un surnom qui a choqué tout Internet : « Génie autiste ». Un demi-mois après la mise en ligne de GPT-5.5, Ultraman a exprimé à plusieurs reprises sans vergogne son enthousiasme sur les plateformes sociales. Il n'a pas pu s'empêcher de soupirer, je n'arrive pas à croire que nous ayons réellement créé une telle IA !

Selon les propres mots d'Ultraman, « l'intelligence originale » de GPT-5.5 a ouvert une brèche au niveau de la faille :

Les scores sont écrasants, les économies symboliques montent en flèche et l’esthétique de la performance et de la violence est parfaite.

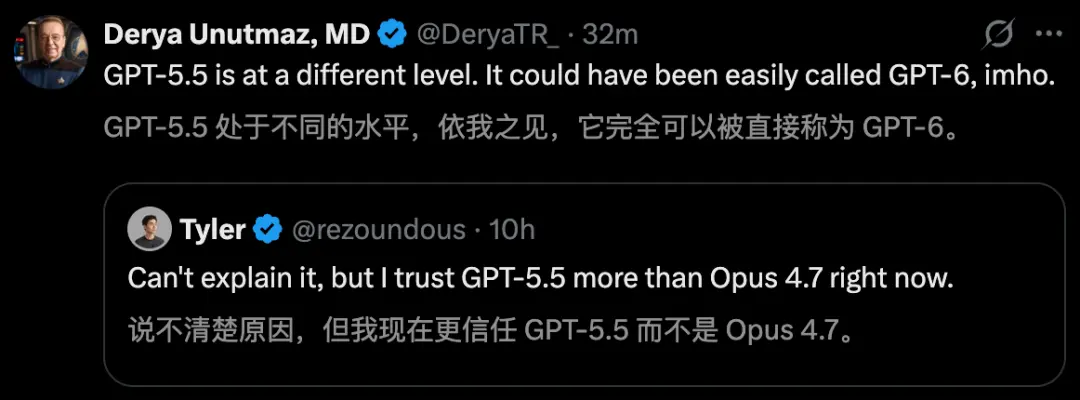

De grands noms du cercle de l'IA ont voté pour GPT-5.5 avec leurs pieds. Même le professeur d'IA Derya Unutmaz a dit sans ambages que cela pouvait s'appeler GPT-6 !

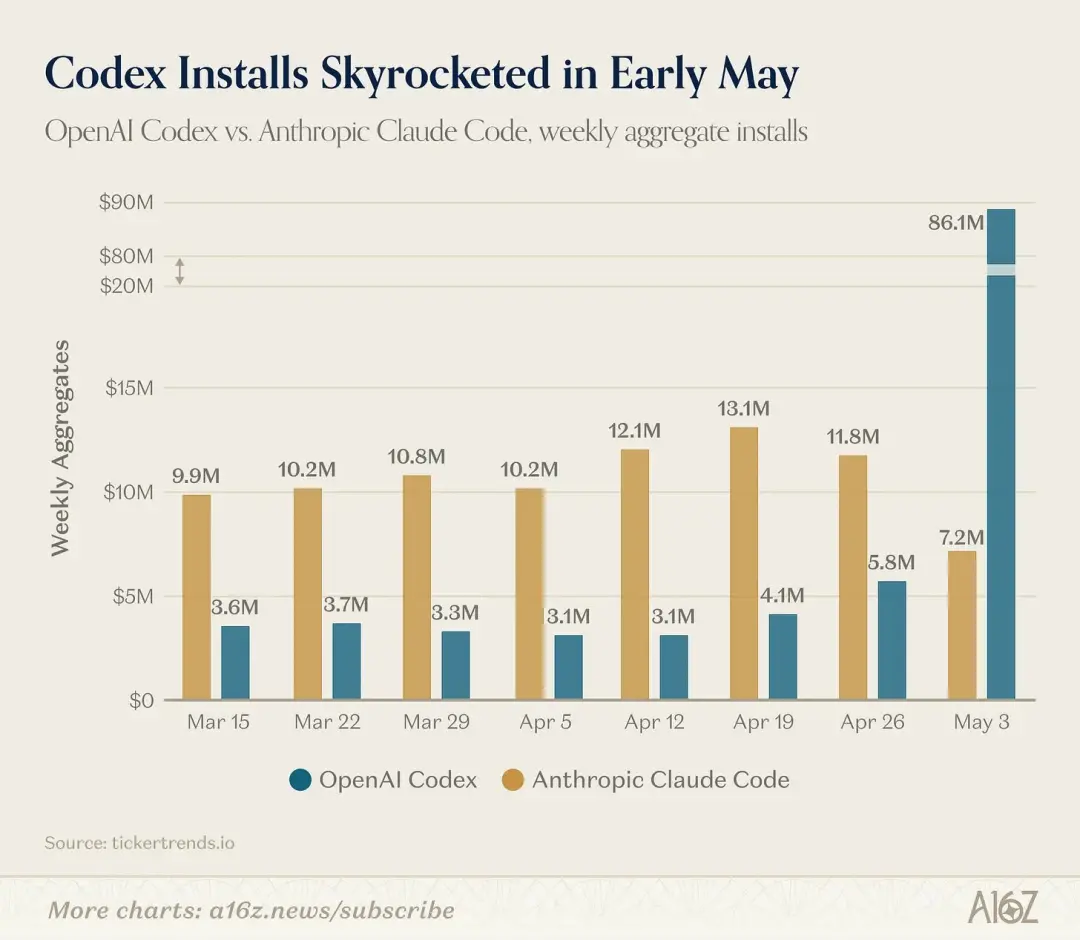

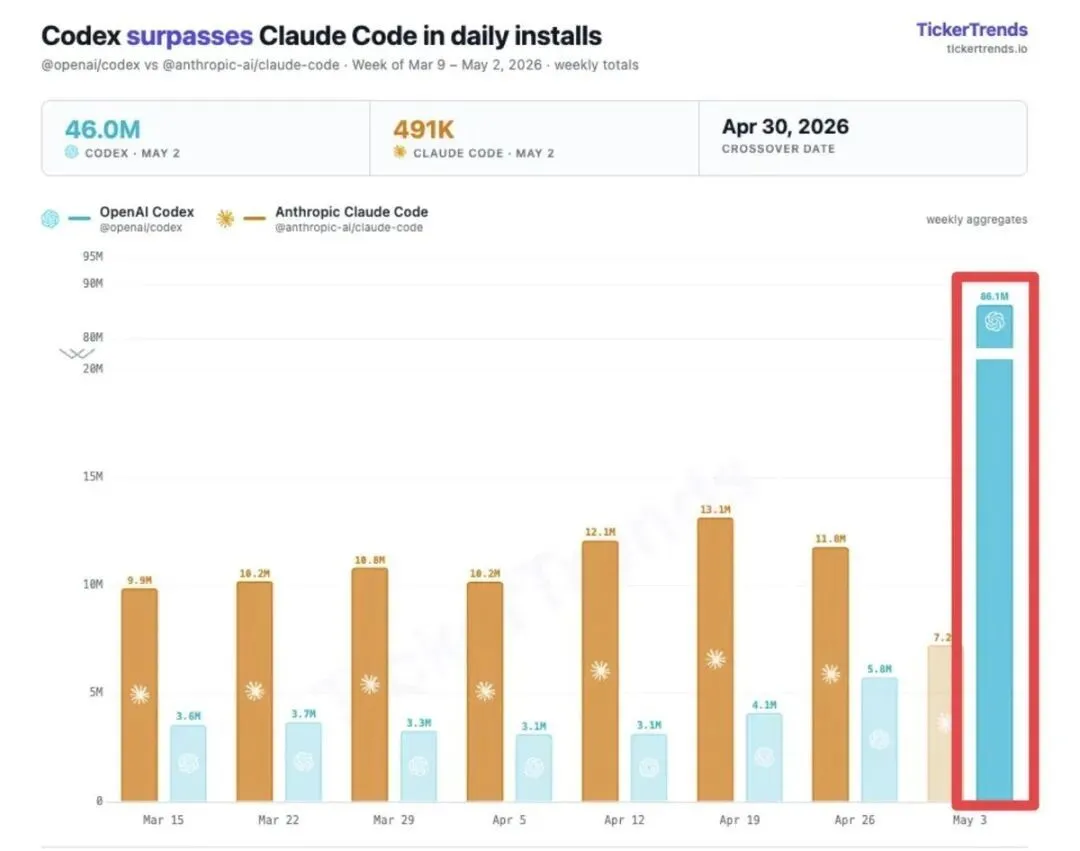

Aujourd’hui également, un graphique est devenu viral sur tout Internet. Les téléchargements de Codex pris en charge par GPT-5.5 ont grimpé en flèche en mai, atteignant 86,1 millions, dépassant largement Claude Code.

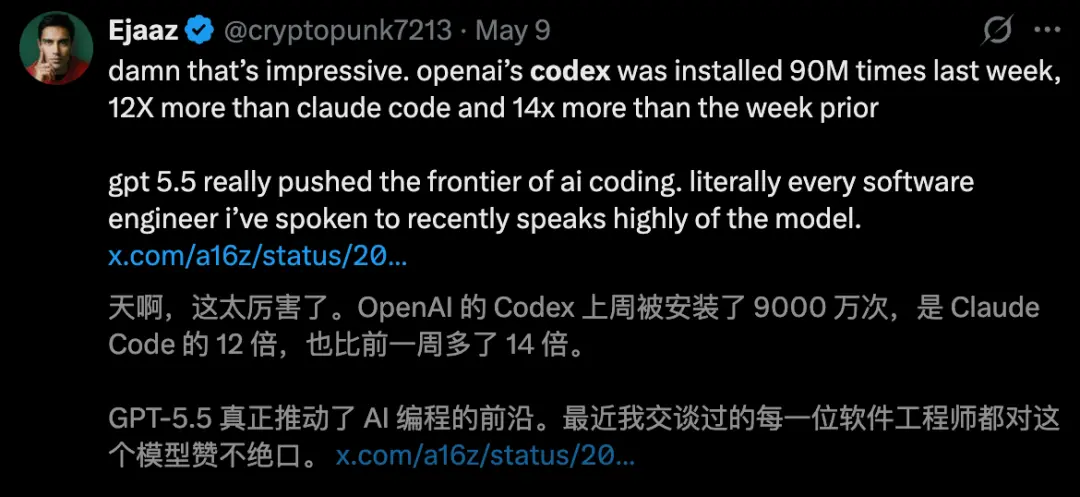

Rien que la semaine dernière, le nombre de téléchargements a dépassé les 90 millions, soit 12 fois celui de Claude Code.

Dans le même temps, les retours des développeurs le prouvent également.

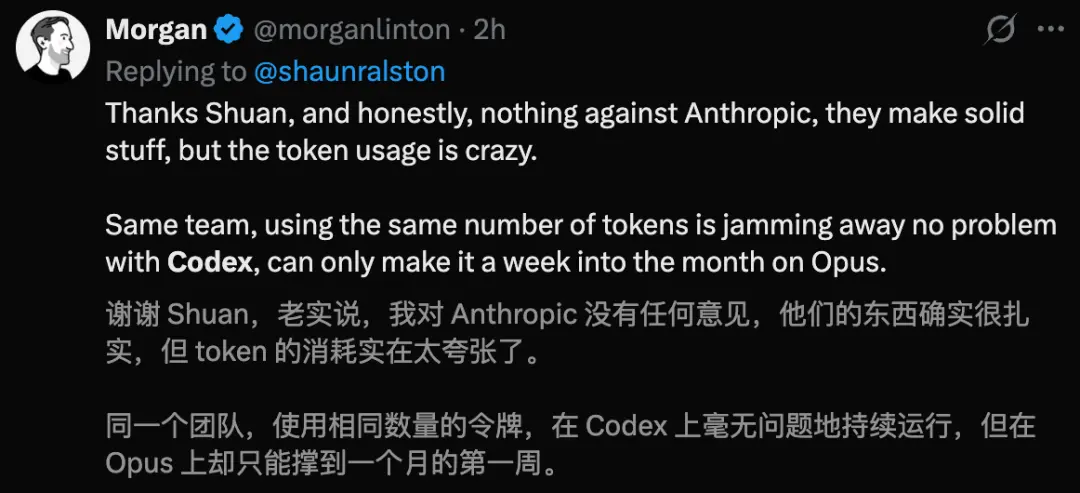

De nombreuses personnes ont déclaré publiquement que les performances de GPT-5.5 avaient dépassé celles de Claude Opus 4.7 dans les tâches d'encodage réelles, en particulier la consommation de jetons.

Pour la même tâche, GPT-5.5 utilise près de 40 % de jetons en moins que Claude.

Je dois dire que la métaphore du « génie autiste » est si précise qu'elle angoisse un peu les gens.

Une équipe de 16 personnes peut économiser 32 000 $ par mois en se désinscrivant de Claude

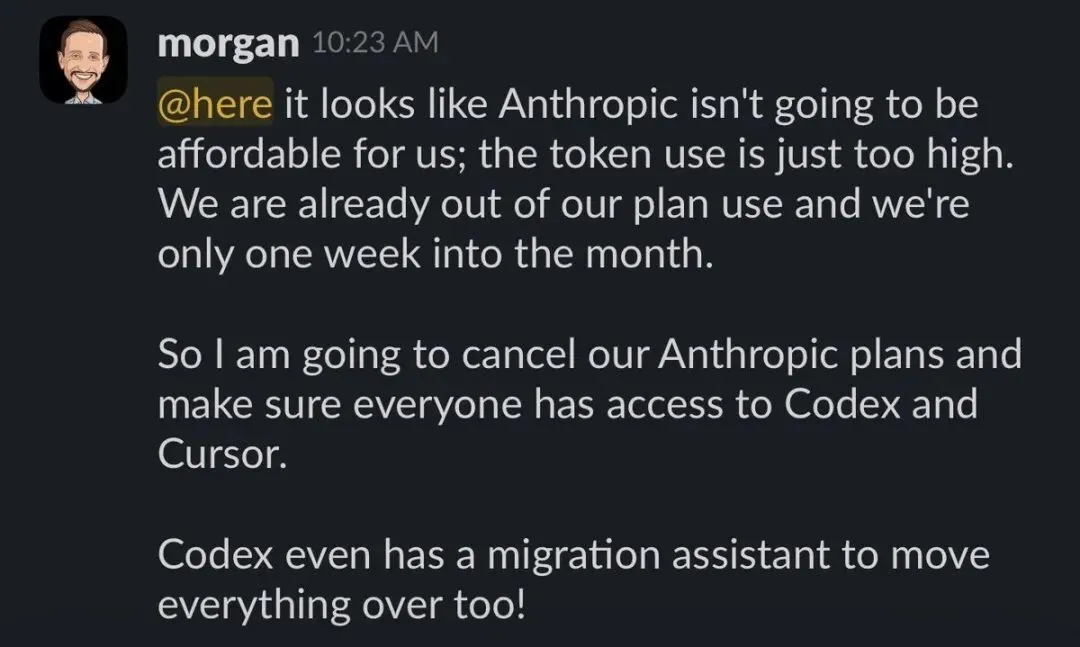

Morgan Linton, fondateur de la startup Bold Metrics, a publié un article au ton calme mais au contenu explosif :

Dites officiellement au revoir à Anthropic !

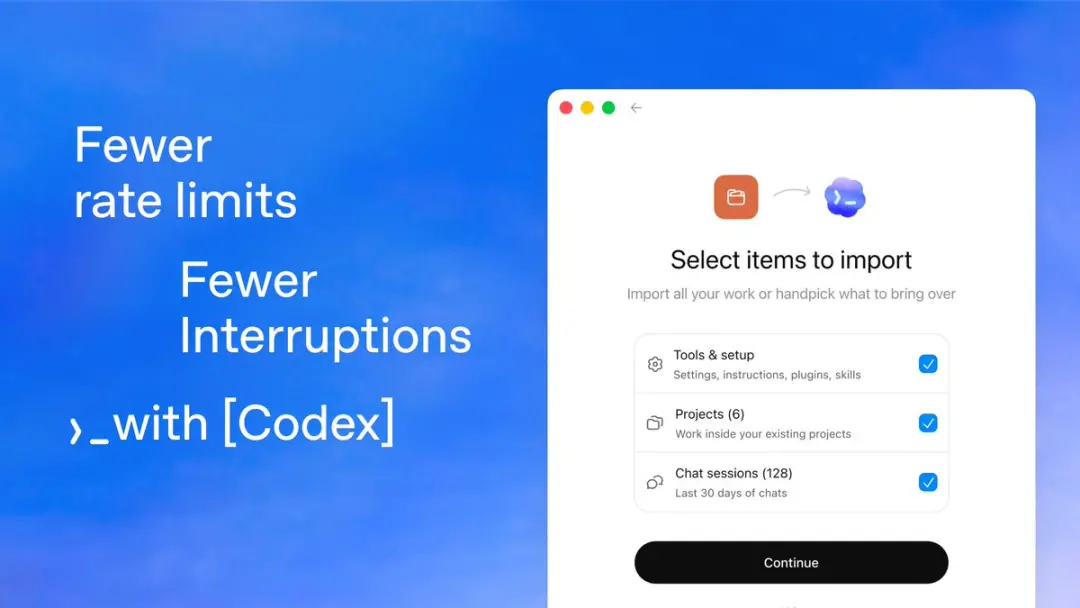

Pour ma petite équipe d’ingénieurs de 16 personnes, la combinaison Codex + Curseur a complètement remplacé la solution originale.

La raison est simple et grossière : Claude Code est trop cher !

En revanche, avec la prise en charge de GPT-5.5, les performances récentes du Codex ont été étonnantes et son taux d'utilisation des jetons est extrêmement élevé, ce qui permet de réaliser des économies considérables.

Dans le travail réel, Bold Metrics utilise encore fréquemment le curseur pour la révision du code.

Le plus important est que l'utilisation de Cursor par l'équipe n'a jamais déclenché de restrictions de table jusqu'à présent, et sa fonctionnalité intégrée de Composer 2 est suffisante pour gérer la grande majorité des scénarios de développement.

Concernant la consommation de Claude Token, Linton a fait un calcul——

Chaque ingénieur coûte plus de 2 000 dollars par mois et 16 personnes dépensent plus de 32 000 dollars par mois.

Après le passage à Codex + Cursor, l'efficacité des jetons de GPT-5.5 a considérablement réduit le coût sans compromettre les performances.

Plus inquiétant encore est sa prédiction selon laquelle de plus en plus de leaders en ingénierie prendront des décisions similaires.

Il faut dire que ce post était comme une bombe en profondeur qui a directement touché la bouée de sauvetage d'Anthropic——Le produit est bon, mais la consommation de jetons n'est qu'une simple ponction d'argent..

Et le Codex ? Les données fournissent déjà la réponse.

Avec 90 millions de téléchargements par semaine, le Codex est devenu un mythe

Les données de TickerTrends montrent qu'au 3 mai, le Codex avait été téléchargé 86,1 millions de fois, soit une augmentation de 1 397 % d'une semaine à l'autre.

Le 8 mai, ce nombre avait encore grimpé jusqu'à atteindre 90 millions en une seule semaine.

Dans le même temps, Claude Code d'Anthropic a été téléchargé 7,2 millions de fois au cours de la même période, soit une baisse de 38 % d'une semaine sur l'autre.

L’un court et l’autre perd du sang. La vitesse d'un flux et reflux est suffocante.

Le point de basculement de cette vague de croissance est clair——

Le 30 avril, le Codex a publié la version v0.128.0, qui a introduit un flux de travail persistant/objectif et pris en charge la planification des tâches en plusieurs étapes entre sessions.

Couplé aux millions de jetons apportés par GPT-5.5 et à l'amélioration de 40 % de l'efficacité des jetons, les développeurs votent avec leurs pieds plus honnêtement que n'importe quelle évaluation.

Altman lui-même a également utilisé un mot pour décrire la croissance du Codex dans une lettre interne : fou !

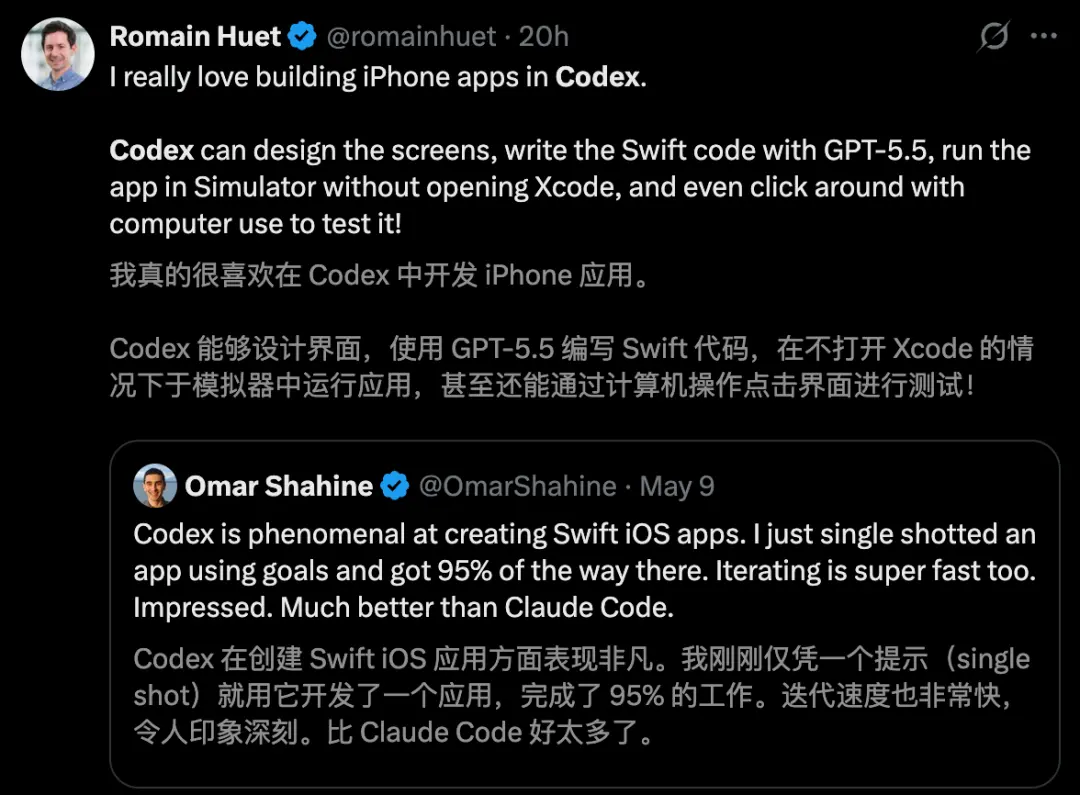

Le vice-président de Microsoft, Omar Shahine, n'a pas pu s'empêcher de féliciter : « Le Codex a réalisé des performances exceptionnelles dans la création d'applications Swift iOS. »

Il n'a utilisé qu'une seule invite et le Codex est sorti directement de l'application et a résolu 95 % du travail. C'était beaucoup plus simple à utiliser que Claude Code.

Immédiatement après, Romain Huet, responsable de l'expérience développeur chez OpenAI, a déclaré :

Codex peut concevoir l'interface, utiliser GPT-5.5 pour écrire du code Swift et vous pouvez exécuter l'application directement dans le simulateur sans même ouvrir Xcode. Vous pouvez même utiliser le « contrôle par ordinateur » pour le tester partout !

Le développeur Dimitris Papailiopoulos a également déclaré qu'il faisait davantage confiance au Codex.

Désormais, avec le Codex, Ultraman a déclaré que son temps était plus libre.

La "vérité" d'Ultraman tard dans la nuit et la section des commentaires est devenue incontrôlable

Aujourd'hui également, Allman a commencé à solliciter des opinions en ligne : « Que souhaitez-vous le plus améliorer par rapport au modèle de nouvelle génération d'OpenAI ? »

Pendant un certain temps, la zone de commentaires a explosé de suggestions.

Un commentaire élogieux a cloué OpenAI au mur

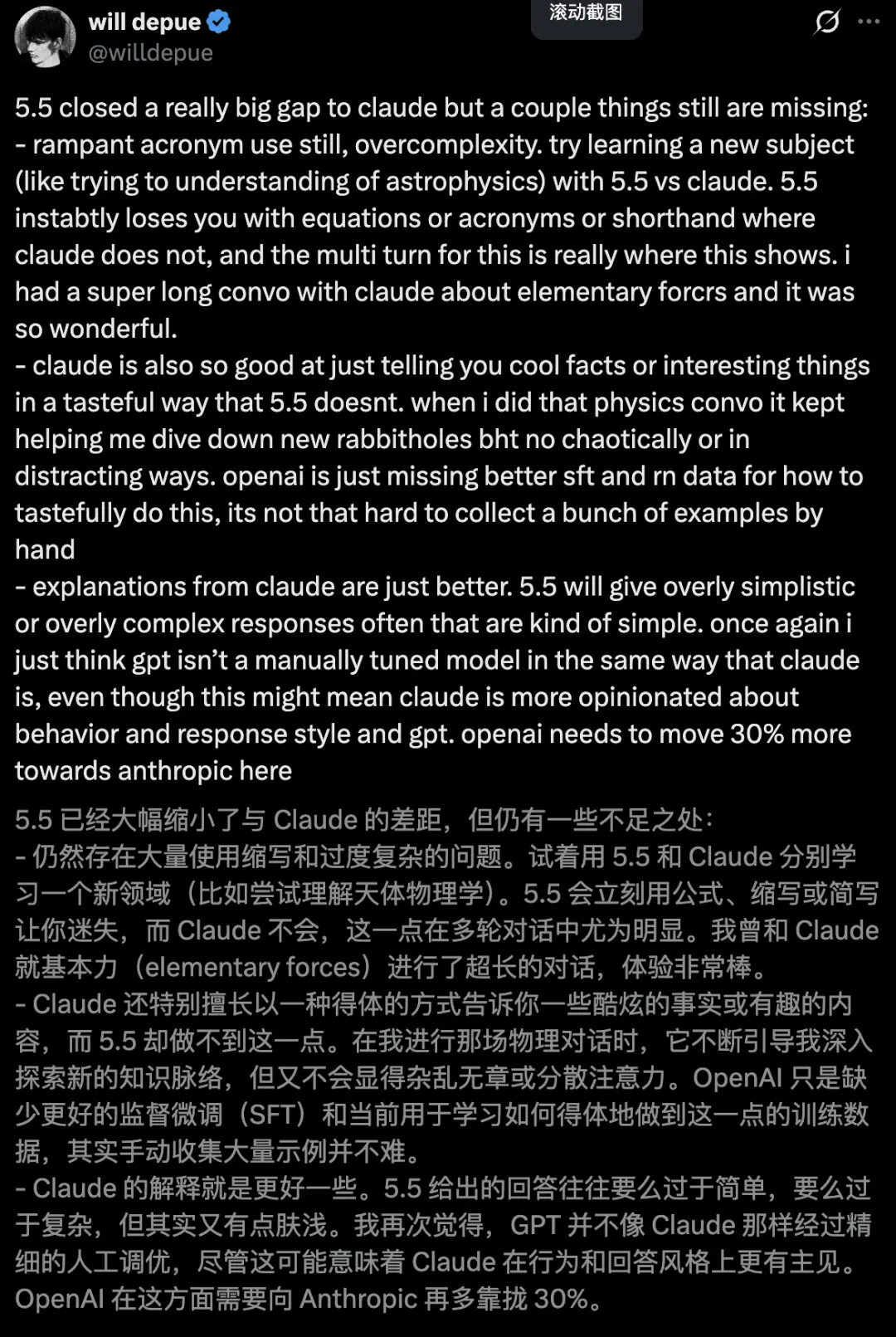

La réponse de Will Depue, ancien chercheur d’OpenAI, est devenue le centre d’intérêt du public.

GPT-5.5 a réduit l'écart avec Claude, mais a complètement perdu dans le « contact humain ».

Il a donné un exemple. Lorsque vous souhaitez apprendre l'astrophysique, GPT-5.5 lancera immédiatement un tas d'abréviations et de formules froides, vous déroutant ;

Et Claude est comme un tuteur compétent et élégant, qui peut vous conduire dans le terrier de diverses connaissances, ce qui est à la fois intéressant et pas compliqué.

Non seulement cela, il a crié que le réglage des données d'OpenAI est trop mécanique, alors il a rapidement appris d'Anthropic et a réduit la « personnalité » et le « pouvoir explicatif » du modèle de 30 %.

Le modèle le plus puissant d’Internet est en réalité détesté parce qu’il « ressemble à un être humain ».

D'autres espèrent que ChatGPT pourra améliorer la capacité à suivre des instructions et à écrire.

De plus, le front-end est ce que les internautes ont le plus mentionné, et ils espèrent voir des améliorations significatives.